Kubernetes s'est imposé comme une technologie clé du cloud computing, capable de transformer la façon dont votre organisation déploie, fait évoluer et gère ses applications conteneurisées. Ce système open source d'orchestration de conteneurs simplifie la gestion des systèmes distribués et garantit l'exécution fiable des applications dans des environnements variés. Comment Kubernetes peut-il servir votre entreprise ? En automatisant le déploiement, la mise à l'échelle et la reprise après incident, Kubernetes aide votre organisation à fluidifier ses opérations pour mieux se consacrer à l'innovation.

Si votre organisation vise efficacité et fiabilité, Kubernetes met à votre disposition les outils pour y parvenir. Ces outils permettent aux équipes de piloter leurs systèmes en toute confiance et d'améliorer leurs workflows. Avec des fonctionnalités comme l'équilibrage de charge, les déploiements automatisés et la mise à l'échelle, Kubernetes est devenu quasi incontournable pour le DevOps. Il optimise les ressources tout en préservant la résilience de vos applications.

Qu'est-ce que l'architecture Kubernetes ?

Avant d'aborder l'architecture Kubernetes, il est essentiel de comprendre la conteneurisation et son impact sur le déploiement applicatif. La conteneurisation s'apparente à une version allégée de la virtualisation. Elle regroupe une application et l'ensemble de ses dépendances (bibliothèques, binaires, fichiers de configuration) dans un package portable unique appelé conteneur. Contrairement aux machines virtuelles traditionnelles, qui nécessitent un système d'exploitation complet pour chaque instance, les conteneurs partagent le noyau du système d'exploitation hôte, ce qui les rend plus efficaces et plus rapides à démarrer.

La conteneurisation est une alternative légère à la virtualisation classique : en partageant le noyau du système d'exploitation hôte, elle réduit la surcharge, accélère le démarrage et consomme moins de ressources. Les conteneurs offrent des environnements cohérents et permettent une approche build once, run anywhere.

Kubernetes simplifie la gestion des déploiements de conteneurs à grande échelle grâce à sa scalabilité, son automatisation, son auto-réparation et son écosystème robuste, ce qui en fait une plateforme d'orchestration de conteneurs de référence. Il offre un cadre fiable pour gérer la complexité des environnements de calcul distribués avec efficacité et précision. Dans un environnement traditionnel, par exemple, votre équipe doit gérer manuellement le déploiement et la mise à l'échelle des applications. Ce processus est chronophage, source d'erreurs et difficile à maintenir à mesure que l'infrastructure se développe.

En automatisant les tâches via une API unique, Kubernetes facilite la gestion des conteneurs sur différents environnements. Il intègre également des fonctionnalités d'auto-réparation qui lui permettent de se remettre seul des défaillances, sans intervention. Avec Kubernetes, votre équipe déploie en douceur les nouvelles versions d'applications tout en maintenant la disponibilité et la réactivité, même en cas de forte charge.

Voici les principes fondamentaux sur lesquels Kubernetes s'appuie pour relever certains des plus grands défis du déploiement logiciel :

- Mise à l'échelle automatique : Kubernetes ajuste les ressources en temps réel selon la demande applicative, afin que votre système absorbe les variations sans intervention manuelle.

- Auto-réparation : en cas de défaillance d'un conteneur, Kubernetes détecte le problème et le remplace automatiquement, garantissant la continuité de vos applications.

- Mises à jour sans interruption : grâce à des déploiements et rollbacks fluides, les mises à jour s'appliquent sans perturber les utilisateurs et réduisent les temps d'arrêt.

- Mise en réseau avancée : Kubernetes prend en charge des besoins réseau complexes pour assurer une communication fluide entre plusieurs conteneurs au sein de systèmes distribués.

- Utilisation intelligente des ressources : la planification des workloads est optimisée pour tirer le meilleur parti de l'infrastructure et maîtriser les coûts sans sacrifier les performances.

Kubernetes lève les obstacles liés à la gestion des applications conteneurisées et vous permet de vous concentrer sur la création et l'exploitation de logiciels, sans le poids de la gestion d'infrastructure. Voici les principaux atouts de Kubernetes :

- Flexibilité : déployez vos applications sans difficulté dans une grande variété d'environnements.

- Cohérence : conservez des performances fiables, que ce soit on-premises, chez des fournisseurs cloud ou en environnement hybride.

- Efficacité : réduisez la charge opérationnelle en automatisant les tâches de gestion courantes.

- Scalabilité : gérez efficacement des systèmes complexes et distribués sans complexité supplémentaire.

- Optimisation des coûts : améliorez l'utilisation des ressources pour maîtriser vos coûts plus efficacement. Pour les équipes qui souhaitent optimiser en continu les requêtes de ressources et l'efficacité des nœuds, PerfectScale for Kubernetes by DoiT fournit une analyse automatisée et des recommandations concrètes, fondées sur le comportement réel des workloads.

Au moment de mettre en œuvre Kubernetes, vous disposez d'excellentes options de services managés chez les principaux fournisseurs cloud. Amazon Elastic Kubernetes Service (EKS), Google Kubernetes Engine (GKE) et Azure Kubernetes Service (AKS) prennent en charge le plus gros du travail. Ces services s'occupent des tâches complexes : gestion du control plane, automatisation des mises à jour et maintien de la haute disponibilité.

Chacun a ses points forts : EKS s'intègre parfaitement avec les services AWS, GKE propose des fonctionnalités d'autoscaling avancées et AKS offre une intégration solide avec Azure DevOps. En optant pour un service managé, vous vous consacrez à vos applications pendant que le fournisseur gère la complexité de l'infrastructure.

En définitive, Kubernetes simplifie la gestion applicative en proposant des solutions concrètes pour fluidifier votre workflow et s'adapter à vos besoins spécifiques.

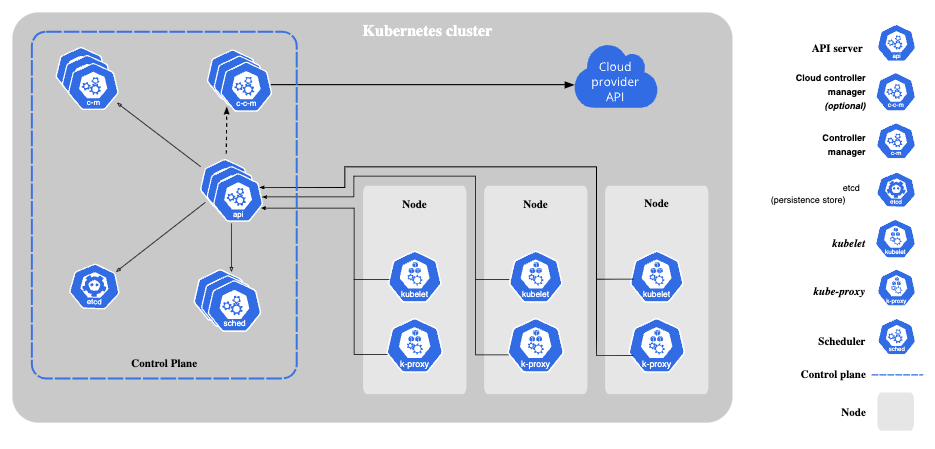

Les composants clés de l'architecture Kubernetes

( Source)

L'architecture Kubernetes repose sur deux composants essentiels : le control plane et les worker nodes. Cette structure offre une plateforme fiable, scalable et flexible pour la gestion des applications conteneurisées. En séparant les responsabilités entre ces composants, Kubernetes assure une orchestration efficace et simplifie la mise à l'échelle ainsi que la gestion des workloads.

Architecture du control plane Kubernetes

Le control plane supervise un cluster Kubernetes — un ensemble de machines de travail (appelées nodes) qui exécutent les applications conteneurisées. Dans Kubernetes, le cluster constitue l'épine dorsale de votre déploiement : il rassemble toutes les machines et ressources nécessaires à l'exécution de vos applications en une unité cohérente et pilotable.

Les composants du control plane sont les suivants :

kube-apiserver

kube-apiserver est le composant central de gestion d'un cluster Kubernetes. Son rôle :

- Donner accès à l'API Kubernetes, point d'entrée principal pour interagir avec le cluster.

- Gérer les tâches administratives et superviser l'état du cluster pour assurer son bon fonctionnement.

- Servir d'interface principale aux interactions avec le cluster, ce qui vous permet d'en piloter efficacement les opérations.

etcd

etcd est un magasin clé-valeur distribué et cohérent qui joue un rôle critique dans l'architecture Kubernetes. Ses principaux atouts :

- Servir de mécanisme principal de stockage de données du cluster, en conservant son état complet.

- Sécuriser les données du cluster et les rendre récupérables grâce à des sauvegardes de configuration fiables.

- Garantir stabilité et fiabilité avec une gestion d'état cohérente sur l'ensemble du cluster.

- Réduire les temps d'arrêt grâce à une haute disponibilité rendue possible par son architecture distribuée.

kube-scheduler

Le kube-scheduler détermine le meilleur emplacement pour les pods au sein d'un cluster Kubernetes. Lors de la planification des pods, il prend en compte plusieurs critères :

- Besoins en ressources : il s'assure que le pod dispose du CPU, de la mémoire et des autres ressources nécessaires.

- Contraintes matérielles ou logicielles : il associe le pod aux nodes répondant à des exigences précises de matériel ou de logiciel.

- Règles d'affinité et d'anti-affinité : il respecte les règles définissant quels pods doivent être placés ensemble (ou séparés).

- Localité des données : il place les pods au plus près des données dont ils ont besoin pour minimiser la latence.

- Optimisation des performances : il équilibre les workloads entre les nodes pour améliorer les performances du cluster.

kube-controller-manager

Le kube-controller-manager supervise plusieurs processus de contrôle pour maintenir l'état souhaité du cluster. Les principaux contrôleurs sont :

- Node controller : surveille la santé et le statut des nodes pour s'assurer qu'ils fonctionnent correctement.

- Replication controller : maintient le nombre exact de réplicas de pods en cours d'exécution.

- Endpoints controller : gère le peuplement des endpoints de service pour une communication efficace.

- Service account & token controllers : prennent en charge l'authentification et la gestion des jetons d'accès pour des opérations sécurisées.

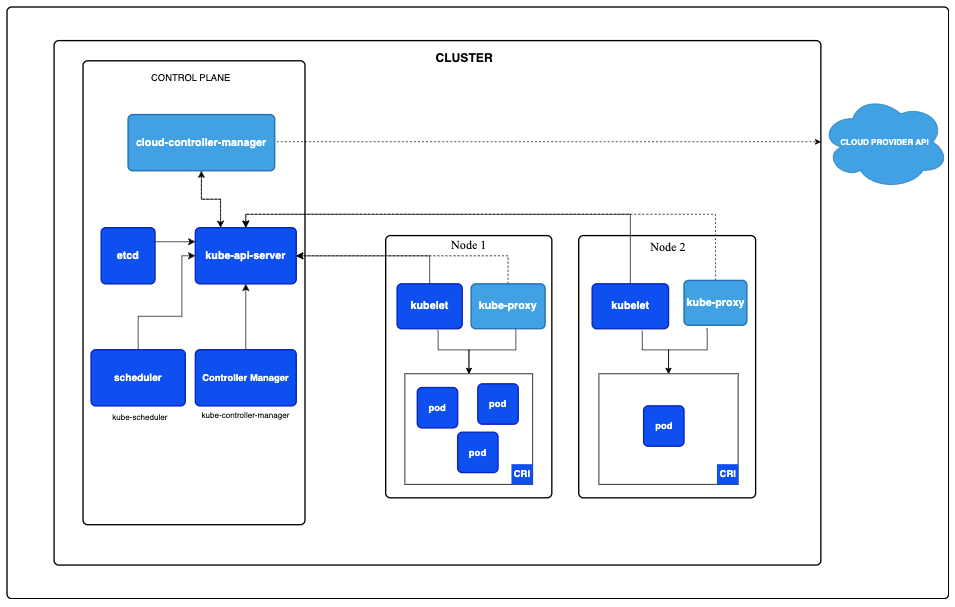

Architecture des nodes Kubernetes

( Source)

Les worker nodes sont les moteurs de calcul du cluster Kubernetes : ce sont eux qui exécutent vos applications conteneurisées. Ils représentent en pratique les ressources de calcul facturées dans votre configuration cloud ; leur nombre et leur taille ont donc un impact direct sur vos coûts. Pour réduire les dépenses Kubernetes, les organisations cherchent souvent à mieux exploiter leurs nodes. Ajuster leur nombre, améliorer le bin-packing et choisir les bonnes tailles peut faire une réelle différence.

Pour gagner en efficacité et réduire le gaspillage à l'échelle des clusters et des workloads, PerfectScale for Kubernetes by DoiT aide les équipes à right-sizer en continu les requests et les limits, à optimiser le placement des pods et à identifier les ressources inutilisées. Pour plus d'informations sur le produit, vous pouvez aussi consulter PerfectScale.

Les worker nodes comprennent les composants suivants :

kubelet

Le kubelet est l'agent principal de chaque node Kubernetes. Il prend en charge plusieurs tâches clés qui garantissent le bon fonctionnement de votre cluster :

- Communiquer avec le control plane : le kubelet échange régulièrement avec le control plane pour recevoir des instructions et remonter le statut du node ainsi que ses workloads.

- Exécuter correctement les pods : il s'assure que les conteneurs de chaque pod fonctionnent comme prévu et intervient en cas de problème.

- Surveiller la santé des nodes et des pods : il suit l'état du node et de ses pods, et signale tout incident pour préserver la stabilité et les performances.

- Gérer le cycle de vie des conteneurs : il démarre, arrête et redémarre les conteneurs tout au long de leur cycle de vie.

Container runtime

Le container runtime exécute les conteneurs dans un environnement Kubernetes. Il prend en charge plusieurs runtimes (notamment Docker, containerd et CRI-O) et gère des tâches essentielles :

- Récupérer les images de conteneurs depuis les registries

- Exécuter les conteneurs efficacement

- Isoler les ressources pour des performances stables et sécurisées

Quels sont les autres composants d'infrastructure Kubernetes ?

Kubernetes inclut plusieurs composants d'infrastructure clés qui complètent ses fonctionnalités principales. Voici un panorama de chacun pour mieux comprendre leur rôle :

- Pods : ce sont les plus petites unités déployables dans Kubernetes. Un pod contient un ou plusieurs conteneurs qui partagent des ressources et s'exécutent ensemble en une unité unique.

- Deployments : ils définissent l'état souhaité des pods et des replica sets, ce qui permet à votre application de fonctionner sans accroc et de s'adapter à la demande.

- Services : ils créent un mécanisme stable pour gérer la mise en réseau et la communication, afin que les différents composants de votre application interagissent de manière fiable.

- Namespaces : ils permettent d'isoler les ressources au sein de votre cluster et facilitent l'organisation comme la gestion d'environnements complexes.

- Persistent volumes : ils protègent vos données en dissociant le stockage des pods individuels et assurent leur persistance, même en cas de recréation des pods.

- ConfigMaps et secrets : ils contribuent à gérer efficacement la configuration et les données sensibles, pour des applications à la fois flexibles et sécurisées.

Chacun de ces composants joue un rôle important dans la simplification de la gestion applicative et dans la mise à l'échelle fluide au sein de votre cluster. Articulés entre eux, ils contribuent à simplifier les processus complexes et à faire évoluer votre système efficacement.

Interactions entre les composants

Schéma Kubernetes simplifié ( Source)

L'écosystème Kubernetes repose sur des interactions parfaitement orchestrées pour offrir un environnement dynamique de gestion des conteneurs. Lors d'une demande de déploiement, l'utilisateur soumet une configuration via l'API Kubernetes. Le kube-apiserver valide la requête et fait office de point d'entrée pour les opérations du cluster. Une fois la requête validée, le scheduler analyse l'état du cluster pour identifier le node optimal pour la workload, en tenant compte de la disponibilité des ressources, des contraintes matérielles et de la répartition des workloads.

Ensuite, le kubelet du node cible récupère les images de conteneurs nécessaires depuis le registry, tandis que kube-proxy configure le routage réseau pour assurer la communication au sein du cluster et avec les services externes. Le container runtime lance alors les conteneurs et rapproche le système de l'état souhaité.

La véritable force de Kubernetes réside dans sa surveillance continue et son auto-réparation. Les contrôleurs comparent en permanence l'état actuel du cluster à l'état souhaité et appliquent les corrections nécessaires : remplacement de conteneurs défaillants, redistribution des workloads en cas de défaillance d'un node, réallocation des ressources pour préserver les performances et la fiabilité.

Cette orchestration des composants permet aux clusters Kubernetes de rester résilients, efficaces et réactifs face à l'évolution des besoins. Sa capacité à surveiller, réparer et optimiser allège la charge opérationnelle, renforce la fiabilité et accélère l'innovation.

Bonnes pratiques et principes de l'architecture Kubernetes

Bâtir des cas d'usage solides pour l'architecture Kubernetes implique de suivre un ensemble de bonnes pratiques fondamentales. Examinons les principes les plus importants pour concevoir des systèmes fiables, scalables et sécurisés.

Infrastructure immuable

- Considérez les conteneurs comme jetables. Concevez votre système pour que les conteneurs puissent être remplacés plutôt que modifiés en place.

- Évitez d'apporter des modifications directement aux conteneurs en cours d'exécution. Privilégiez plutôt des configurations déclaratives pour assurer cohérence et reproductibilité.

- Appuyez-vous sur des images de conteneurs versionnées et immuables pour préserver la stabilité et la prévisibilité, et offrir une base fiable à vos applications.

Conception en microservices

- Structurez votre application en services faiblement couplés afin que chaque composant puisse fonctionner indépendamment.

- Concevez chaque service pour qu'il s'adapte indépendamment à la demande, ce qui améliore l'allocation des ressources.

- Simplifiez la maintenance et les mises à jour en gardant des services réduits et focalisés sur des tâches précises.

Gestion des ressources

- Définissez des requests et des limits clairs pour les conteneurs afin d'éviter les conflits et la surconsommation de ressources.

- Mettez en place des stratégies de mise à l'échelle, comme l'horizontal pod autoscaling, pour vous adapter aux variations de workload.

- Surveillez régulièrement l'utilisation des ressources pour repérer les inefficacités et optimiser les performances.

Sécurité

- Protégez votre cluster avec des mécanismes d'authentification robustes et limitez l'accès aux utilisateurs et systèmes autorisés.

- Utilisez le contrôle d'accès basé sur les rôles (RBAC) pour gérer les permissions et restreindre l'accès au strict nécessaire pour chaque rôle.

- Maintenez les composants Kubernetes et les images de conteneurs à jour avec les derniers correctifs pour réduire les vulnérabilités.

- Limitez les privilèges des conteneurs en appliquant le principe du moindre privilège.

En appliquant ces bonnes pratiques, vous bâtissez une architecture Kubernetes efficace, scalable et sécurisée. Les défis ne manqueront pas, mais ces principes constituent une base solide pour orienter vos efforts et maintenir un système fiable.

Haute disponibilité et scalabilité

Graphique de détection d'anomalies

Graphique de détection d'anomalies

( Source)

Kubernetes est conçu pour offrir haute disponibilité et scalabilité — deux exigences incontournables pour les applications critiques d'aujourd'hui. La haute disponibilité repose sur plusieurs instances du control plane afin d'éviter les points de défaillance uniques, ainsi que sur des stratégies d'élection de leader qui maintiennent les composants critiques opérationnels même lorsque certaines instances rencontrent des problèmes.

Au niveau des nodes, Kubernetes répartit les workloads et utilise des mécanismes de bascule pour se remettre des défaillances de nodes sans impacter les performances applicatives. Pour renforcer la résilience, les organisations déploient souvent leurs environnements sur plusieurs zones ou régions afin d'ajouter une redondance géographique et de se prémunir contre les pannes d'infrastructure de plus grande ampleur.

La scalabilité est un autre atout majeur de Kubernetes. Le Horizontal Pod Autoscaler (HPA) ajuste le nombre de réplicas de pods selon des métriques en temps réel, ce qui aide les applications à absorber efficacement les variations de trafic tout en optimisant les ressources. De même, le Cluster Autoscaler peut ajouter ou retirer des nodes selon les besoins en workload, rendant la mise à l'échelle plus fluide et plus rentable lorsqu'il est correctement configuré.

Kubernetes prend en charge des opérations à grande échelle et des milliers de nodes au sein d'un même cluster. Il s'appuie sur l'allocation dynamique des ressources pour distribuer intelligemment les workloads, réduire les goulets d'étranglement et améliorer l'efficacité globale.

Kubernetes offre également des moyens concrets de maîtriser les coûts en tirant le meilleur parti de vos ressources. Définir des requests et des limits aide le scheduler à utiliser efficacement la capacité, tandis que le dimensionnement des nodes et l'autoscaling permettent d'équilibrer coût et performance. Des outils comme Prometheus fournissent des métriques d'utilisation qui orientent les décisions d'optimisation. Pour les organisations qui souhaitent transformer ces données d'utilisation en actions d'optimisation continues, PerfectScale for Kubernetes by DoiT aide à right-sizer les workloads, à améliorer le bin-packing et à réduire le gaspillage de ressources inutilisées sur l'ensemble de vos clusters. Vous pouvez également découvrir la plateforme plus en détail sur PerfectScale.

Optimisez votre parcours Kubernetes avec DoiT

Sans l'expertise adéquate, gérer des environnements Kubernetes peut s'avérer complexe. Chez DoiT, nous proposons des solutions d'optimisation et de gestion Kubernetes conçues pour aider votre organisation à relever ces défis efficacement. Notre plateforme se concentre sur :

- L'optimisation des performances du cluster pour des opérations plus fluides

- La réduction des coûts d'infrastructure cloud pour améliorer l'efficacité budgétaire

- La rationalisation des processus de déploiement pour gagner du temps et des ressources

Mettez en place des configurations conformes aux bonnes pratiques pour réussir sur le long terme grâce à nos programmes GKE Accelerator et EKS Accelerator.

La plateforme DoiT facilite l'optimisation des déploiements Kubernetes grâce à des informations de scaling en temps réel, à des fonctionnalités de cost management telles que des dashboards de dépenses et des recommandations de right-sizing, et à des améliorations de performance comme l'analytics au niveau des conteneurs et un placement plus intelligent des workloads. Pour faire de l'optimisation des coûts Kubernetes automatisée et permanente une priorité, commencez avec PerfectScale for Kubernetes by DoiT, et utilisez PerfectScale comme ressource complémentaire pour plus d'informations produit.

Foire aux questions sur l'architecture Kubernetes

Qu'est-ce que l'architecture Kubernetes ?

L'architecture Kubernetes se compose de deux éléments principaux : le control plane et les worker nodes. Le control plane gère l'état du cluster et prend les décisions globales, tandis que les worker nodes exécutent les applications conteneurisées. Ensemble, ils permettent une orchestration scalable et automatisée des workloads distribués.

Quels sont les composants clés de Kubernetes ?

Les composants clés du control plane incluent kube-apiserver, etcd, kube-scheduler et kube-controller-manager. Les worker nodes comprennent kubelet, un container runtime (comme containerd ou Docker) et des composants réseau tels que kube-proxy.

Qu'est-ce que le control plane Kubernetes ?

Le control plane Kubernetes est la couche de gestion centralisée d'un cluster. Il inclut des composants comme kube-apiserver, etcd, le scheduler et le controller manager. Le control plane maintient l'état souhaité du cluster, planifie les workloads et garantit que le système fonctionne comme prévu.

Que sont les nodes Kubernetes ?

Les nodes Kubernetes sont des machines de travail — virtuelles ou physiques — qui exécutent les applications conteneurisées. Chaque node comprend kubelet, un container runtime et des composants réseau. Les nodes fournissent les ressources de calcul, de mémoire et de stockage nécessaires à l'exécution des workloads.

Qu'est-ce que kubelet ?

Kubelet est l'agent principal de chaque node Kubernetes. Il communique avec le control plane, s'assure que les conteneurs s'exécutent comme prévu, surveille la santé des pods et gère le cycle de vie des conteneurs sur chaque node.

Qu'est-ce qu'etcd dans Kubernetes ?

etcd est un magasin clé-valeur distribué qui sert de système principal de stockage de données pour Kubernetes. Il conserve l'état complet du cluster, y compris les données de configuration et les métadonnées. etcd garantit la cohérence et la fiabilité à l'échelle du cluster.

Qu'est-ce que le HPA dans Kubernetes ?

HPA signifie Horizontal Pod Autoscaler. Il ajuste automatiquement le nombre de réplicas de pods dans un déploiement à partir de métriques en temps réel comme l'utilisation CPU ou des métriques applicatives personnalisées. Le HPA aide à maintenir les performances pendant les variations de trafic.

Comment Kubernetes garantit-il la haute disponibilité ?

Kubernetes garantit la haute disponibilité grâce à plusieurs instances de control plane, à un basculement automatique, à des conteneurs auto-réparants, à la répartition des workloads entre nodes et à la prise en charge de déploiements multi-zones ou multi-régions.

Comment Kubernetes gère-t-il la mise à l'échelle ?

Kubernetes prend en charge la mise à l'échelle via le Horizontal Pod Autoscaler (HPA), qui ajuste les réplicas de pods selon la demande, et le Cluster Autoscaler, qui ajoute ou retire des nodes selon les besoins en ressources.

Kubernetes est-il rentable ?

Kubernetes peut améliorer l'efficacité des coûts en optimisant l'allocation des ressources, en activant l'autoscaling, en améliorant le bin-packing et en réduisant l'infrastructure inactive. Des outils d'optimisation peuvent encore renforcer cette efficacité grâce au right-sizing automatisé et à l'analyse des workloads.

Quelle est la différence entre Kubernetes et Docker ?

Docker est une plateforme de conteneurisation qui empaquette les applications et leurs dépendances dans des conteneurs. Kubernetes est une plateforme d'orchestration de conteneurs qui gère, met à l'échelle et automatise les conteneurs sur des clusters. Docker crée les conteneurs ; Kubernetes les gère à grande échelle.

Faut-il utiliser un service Kubernetes managé ?

Les services managés tels qu'Amazon EKS, Google Kubernetes Engine (GKE) et Azure Kubernetes Service (AKS) réduisent la charge opérationnelle en gérant le control plane, les mises à niveau et la haute disponibilité. Les équipes peuvent ainsi se concentrer sur le développement applicatif plutôt que sur la maintenance de l'infrastructure.

D'AWS à Azure, en exploitant les accélérateurs Kubernetes et le cloud analytics de DoiT, vous pouvez simplifier des architectures Kubernetes complexes et en faire un véritable atout DevOps stratégique pour votre entreprise.

Découvrez PerfectScale for Kubernetes by DoiT dès aujourd'hui et constatez comment le right-sizing automatisé et un scaling plus intelligent permettent de réduire le gaspillage sans sacrifier les performances. Pour en savoir plus sur le produit, rendez-vous sur PerfectScale.