Kubernetesはクラウドコンピューティングを支える中核技術として定着し、コンテナ化アプリケーションのデプロイ、スケーリング、管理のあり方を一変させつつあります。オープンソースのコンテナオーケストレーションシステムとして分散システムの管理を簡素化し、環境を問わずアプリケーションを安定稼働させます。では、Kubernetesは自社にどう活かせるのでしょうか。デプロイ、スケーリング、復旧を自動化することで運用を効率化し、イノベーションに集中できる体制をつくります。

効率性と信頼性を追求する組織にとって、Kubernetesは目標達成を後押しするツール群を備えています。これらの機能により、チームは安心してシステムを運用し、ワークフローを改善できます。ロードバランシング、自動ロールアウト、スケーリングなどを備えたKubernetesは、いまやDevOpsに欠かせない存在です。リソースを最適化しながら、アプリケーションの耐障害性も維持します。

Kubernetesアーキテクチャとは

Kubernetesアーキテクチャを理解するうえで、まず押さえておきたいのがコンテナ化と、それがアプリケーションのデプロイに与える影響です。コンテナ化は、いわば仮想化を軽量化した技術です。アプリケーションと依存関係(ライブラリ、バイナリ、設定ファイルなど)をひとつの可搬性のあるパッケージ、すなわちコンテナにまとめます。インスタンスごとに完全なOSを必要とする従来の仮想マシンと違い、コンテナはホストOSのカーネルを共有するため、効率がよく起動も高速です。

コンテナ化は従来型の仮想化に代わる軽量な選択肢で、ホストOSのカーネルを共有することでオーバーヘッドを抑え、起動を速め、リソース消費を低減します。コンテナは一貫した環境を提供し、「一度ビルドすれば、どこでも動かせる」を実現します。

Kubernetesは、スケーラビリティ、自動化、セルフヒーリング、強力なエコシステムといった機能で大規模なコンテナ運用を簡素化し、コンテナオーケストレーションの定番プラットフォームとなっています。分散コンピューティング環境の複雑さを、効率と精度をもって扱える信頼性の高い基盤を提供します。たとえば従来の環境では、アプリケーションのデプロイやスケーリングを手作業で行う必要があり、時間がかかるうえにミスも起きやすく、インフラが拡大するほど維持が難しくなります。

Kubernetesは単一のAPIを通じてタスクを自動化することで、異なる環境にまたがるコンテナ運用を容易にします。さらにセルフヒーリング機能を備え、人手を介さずに障害から自動復旧します。Kubernetesがあれば、トラフィックが急増する場面でもアプリケーションの稼働と応答性を保ったまま、新バージョンをスムーズにロールアウトできます。

Kubernetesがソフトウェアデプロイの代表的な課題にどう対処するのか、ポイントを整理しましょう。

- 自動スケーリング: アプリケーションの需要に応じてリソースをリアルタイムに調整し、人手を介さず変動に対応します。

- セルフヒーリング機能: コンテナに障害が起きても、Kubernetesが検知して自動で差し替え、アプリケーションの稼働を維持します。

- ダウンタイムゼロの更新: シームレスなロールアウトとロールバックにより、ユーザーへの影響を抑えながら更新でき、ダウンタイムを最小化します。

- 高度なネットワーキング: 複雑なネットワーク要件に対応し、分散システム内の複数コンテナ間で滑らかな通信を実現します。

- 賢いリソース活用: ワークロードのスケジューリングを最適化してインフラを最大限に活かし、性能を保ちながらコストを抑えます。

Kubernetesはコンテナ化アプリケーションの運用負荷を軽減し、インフラ管理に追われることなく、ソフトウェアの構築と運用に集中できる環境を整えます。Kubernetes活用の主なメリットは次のとおりです。

- 柔軟性: さまざまな環境にアプリケーションを手軽にデプロイできます。

- 一貫性: オンプレミス、クラウド、ハイブリッドのいずれでも安定したパフォーマンスを維持できます。

- 効率性: 定型的な管理作業を自動化し、運用オーバーヘッドを削減します。

- スケーラビリティ: 複雑な分散システムも、過度な負担なく効果的に管理できます。

- コスト最適化: リソース利用効率を高め、コスト管理をより効果的に行えます。リソースリクエストやノード効率を継続的に最適化したいチームには、PerfectScale for Kubernetes by DoiTが、実際のworkloadの挙動に基づく自動分析と実行可能な推奨事項を提供します。

Kubernetesを導入する際は、主要クラウドベンダーが提供する優れたマネージドサービスを選択肢にできます。Amazon Elastic Kubernetes Service(EKS)、Google Kubernetes Engine(GKE)、Azure Kubernetes Service(AKS)が、面倒な作業を肩代わりしてくれます。これらは、コントロールプレーンの管理、アップデートの自動化、高可用性の維持といった複雑なタスクを引き受けます。

それぞれに強みがあり、EKSはAWSサービスとシームレスに統合し、GKEは高度なオートスケーリング機能を備え、AKSはAzure DevOpsとの連携に優れます。マネージドサービスを選べば、インフラの複雑さはベンダーに任せ、自社はアプリケーションに専念できます。

結局のところ、Kubernetesはワークフローを楽にする実践的な手段を提供し、個別のニーズにも合わせられるからこそ、アプリケーション管理の難しさを和らげてくれるのです。

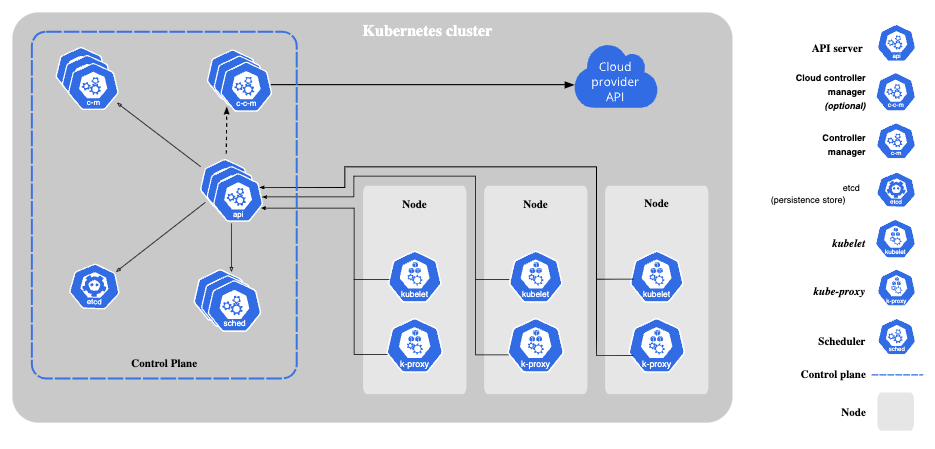

Kubernetesアーキテクチャの中核コンポーネント

(出典)

Kubernetesアーキテクチャは、コントロールプレーンとワーカーノードという2つの中核コンポーネントを軸に構成されています。この構造は、コンテナ化アプリケーションを管理するうえで、信頼性、スケーラビリティ、柔軟性に優れた基盤を提供することを狙いとしています。役割を分離することで、Kubernetesは効率的なオーケストレーションを可能にし、workloadのスケーリングと管理をシンプルにします。

Kubernetesコントロールプレーンのアーキテクチャ

コントロールプレーンは、Kubernetesクラスタ、すなわちコンテナ化アプリケーションを動かすワーカーマシン群(ノード)を統括します。クラスタはデプロイの土台であり、アプリケーションの実行に必要なマシンとリソースを、まとまった管理単位として束ねます。

コントロールプレーンには、次のようなコンポーネントが含まれます。

kube-apiserver

kube-apiserverは、Kubernetesクラスタの中央管理コンポーネントです。次の役割を担います。

- クラスタ操作の主な入口となるKubernetes APIへのアクセスを提供します。

- 管理タスクを処理し、クラスタの状態を監督して、全体が円滑に動作する状態を保ちます。

- クラスタ操作の主要インターフェースとして機能し、運用の制御と管理を効果的に行えるようにします。

etcd

etcdは、分散型で一貫性のあるキーバリューストアであり、Kubernetesアーキテクチャで重要な役割を果たします。主な利点は次のとおりです。

- クラスタの主要なデータストアとして、システム全体の状態を保持します。

- 信頼性の高い構成バックアップにより、クラスタのデータを安全に、復旧可能な状態で保ちます。

- クラスタ全体で一貫した状態管理を実現し、安定性と信頼性を確保します。

- 分散アーキテクチャによる高可用性で、ダウンタイムを最小化します。

kube-scheduler

kube-schedulerは、Kubernetesクラスタ内でPodを最適な場所に配置する役割を担います。Podをスケジューリングするとき、kube-schedulerは次の要素を考慮します。

- リソース要件: Podに必要なCPU、メモリ、その他のリソースが確保されることを保証します。

- ハードウェア/ソフトウェア要件: 必要な条件を満たすノードにPodを割り当てます。

- アフィニティ/アンチアフィニティルール: 同居させるべきPod、分離すべきPodのルールに従います。

- データの局所性: 必要なデータの近くにPodを配置し、レイテンシを抑えます。

- パフォーマンス最適化: ノード間でworkloadを分散し、クラスタ性能を高めます。

kube-controller-manager

kube-controller-managerは、クラスタを望ましい状態に保つために複数のコントローラープロセスを統括します。主なコントローラーは次のとおりです。

- Nodeコントローラー: ノードの健全性とステータスを監視し、正常に稼働しているか確認します。

- Replicationコントローラー: 指定された数のPodレプリカが稼働している状態を保ちます。

- Endpointsコントローラー: 効率的な通信のため、サービスエンドポイントを管理します。

- Service account & tokenコントローラー: 認証を扱い、安全な操作のためのアクセストークンを管理します。

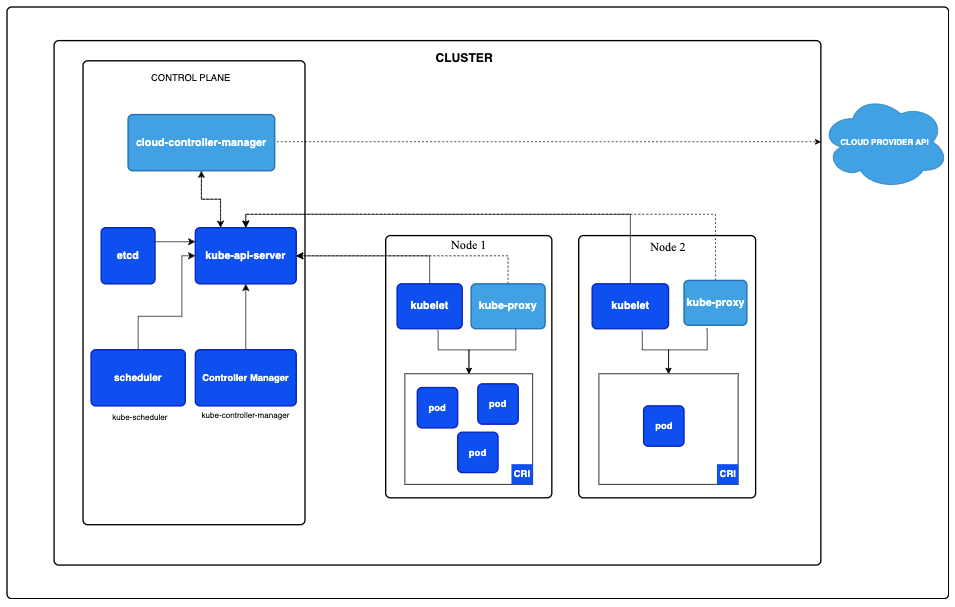

Kubernetesノードのアーキテクチャ

(出典)

ワーカーノードはKubernetesクラスタの計算エンジンであり、コンテナ化アプリケーションを実行する主体です。これらのノードはクラウド環境で課金対象となるコンピューティングリソースそのものなので、台数とサイズはコストに直結します。Kubernetesのコスト削減では、ノードをいかに有効に使うかが焦点になりがちです。台数の調整、ビンパッキングの改善、適切なノードサイズの選定が、効果に大きく響きます。

クラスタやworkload全体の効率を高めて無駄を減らすために、PerfectScale for Kubernetes by DoiTは、リクエストとリミットの継続的なライトサイジング、Pod配置の改善、アイドルリソースの特定をチームに提供します。製品の詳細はPerfectScaleでもご覧いただけます。

ワーカーノードには次のコンポーネントが含まれます。

kubelet

kubeletはKubernetesの主要なノードエージェントです。クラスタの円滑な運用を支える、いくつもの重要なタスクを担います。

- コントロールプレーンとの通信: kubeletは定期的にコントロールプレーンと通信し、指示を受け取り、ノードのステータスやworkloadを報告します。

- Podの正しい実行: 各Pod内のコンテナが期待どおりに動作しているかを確認し、問題があれば対処します。

- ノードとPodの健全性監視: ノードとPodの状態を追跡し、問題があれば報告して安定性とパフォーマンスを維持します。

- コンテナのライフサイクル管理: コンテナの起動・停止、ライフサイクル全体での再起動を管理します。

コンテナランタイム

コンテナランタイムは、Kubernetes環境でコンテナを実行する役割を担います。Docker、containerd、CRI-Oなど複数のランタイムをサポートし、次のような不可欠なタスクを処理します。

- レジストリからのコンテナイメージの取得

- コンテナの効率的な実行

- 安定かつ安全な動作のためのリソース分離

その他のKubernetesインフラコンポーネント

Kubernetesには、コア機能と並んで動作する重要なインフラコンポーネントがいくつかあります。それぞれの役割を整理しておきましょう。

- Pod: Kubernetesにおける最小のデプロイ単位。リソースを共有し、ひとつのまとまりとして動く1つ以上のコンテナを含みます。

- Deployment: Podとレプリカセットの望ましい状態を定義し、アプリケーションを安定稼働させ、適切にスケールできるようにします。

- Service: ネットワークと通信を安定的に管理する仕組みを提供し、アプリケーションの各部が確実に連携できるようにします。

- Namespace: クラスタ内のリソースを分離する手段を提供し、複雑な環境の整理と管理を容易にします。

- Persistent Volume: ストレージを個々のPodから切り離し、Podが再作成されてもデータが残るようにします。

- ConfigMapとSecret: 設定情報や機密データを効率的に扱い、アプリケーションの柔軟性とセキュリティを両立します。

これらのコンポーネントはそれぞれ、アプリケーション運用の効率化と、クラスタ内でのスムーズなスケーリングに重要な役割を担います。連携することで複雑な処理がシンプルになり、システムの管理と拡張を効率的に進められます。

コンポーネント間の連携

Kubernetesの簡略図 (出典)

Kubernetesエコシステムは、整然と連携する各コンポーネントによって、動的なコンテナ管理環境を実現します。デプロイのリクエストが発生すると、ユーザーはKubernetes API経由で構成情報を送信します。kube-apiserverはリクエストを検証し、クラスタ操作の入口として機能します。検証後、スケジューラーがクラスタの状態を分析し、リソースの可用性、ハードウェア制約、workload分散を踏まえて、最適なノードを選定します。

続いて、対象ノード上のkubeletが必要なコンテナイメージをレジストリから取得し、kube-proxyがクラスタ内および外部サービスとの通信を保つためのネットワークルーティングを構成します。その後、コンテナランタイムがコンテナを起動し、システムは望ましい状態へと近づいていきます。

Kubernetesの真価は、継続的な監視とセルフヒーリングにあります。コントローラーは現在のクラスタ状態と望ましい状態を絶えず比較し、必要に応じて修正を加えます。具体的には、障害が起きたコンテナの差し替え、ノード障害時のworkload再分散、性能と信頼性を保つためのリソース再配分などです。

こうしたコンポーネント連携によって、Kubernetesクラスタは耐障害性と効率を維持し、変化する需要に応え続けられます。監視・自己修復・最適化の力が、運用オーバーヘッドを削り、信頼性を高め、イノベーションを加速させます。

Kubernetesアーキテクチャのベストプラクティスと原則

Kubernetesアーキテクチャで強固なユースケースを築くには、土台となるベストプラクティスを押さえることが欠かせません。信頼性、スケーラビリティ、セキュリティを兼ね備えたシステムを設計するために、特に重要な原則を整理しましょう。

イミュータブルインフラ

- コンテナは使い捨てとして扱います。稼働中のコンテナを書き換えるのではなく、置き換えで対応できるよう設計しましょう。

- 稼働中のコンテナへ直接変更を加えるのは避け、宣言的な構成で一貫性と再現性を担保します。

- バージョン管理されたイミュータブルなコンテナイメージを利用し、安定性と予測可能性を保って、アプリケーションの信頼できる土台にします。

マイクロサービス設計

- アプリケーションを疎結合のサービス群として構成し、各コンポーネントが独立して動けるようにします。

- 需要に応じて各サービスを個別にスケールできるよう設計し、リソース配分を最適化します。

- サービスを小さく、特定の役割に絞ることで、保守と更新を簡素化します。

リソース管理

- コンテナごとにリソースリクエストとリミットを明確に指定し、リソースの競合や過剰利用を防ぎます。

- 水平Podオートスケーリングなどの戦略を取り入れ、workloadの変化に対応します。

- リソース利用状況を定期的に監視し、無駄を見つけてシステム性能を最適化します。

セキュリティの考慮事項

- 強力な認証でクラスタを保護し、アクセスを許可されたユーザーとシステムに限定します。

- ロールベースアクセス制御(RBAC)で権限を管理し、各ロールに必要な範囲だけにアクセスを絞ります。

- Kubernetesコンポーネントとコンテナイメージを最新のパッチに保ち、脆弱性を低減します。

- 最小権限の原則に従い、コンテナの権限を必要最小限に抑えます。

これらのベストプラクティスに従えば、効率的で、スケーラブルかつ安全なKubernetesアーキテクチャを構築できます。課題は避けられませんが、これらの原則は確かな指針となり、信頼できるシステムを支えてくれます。

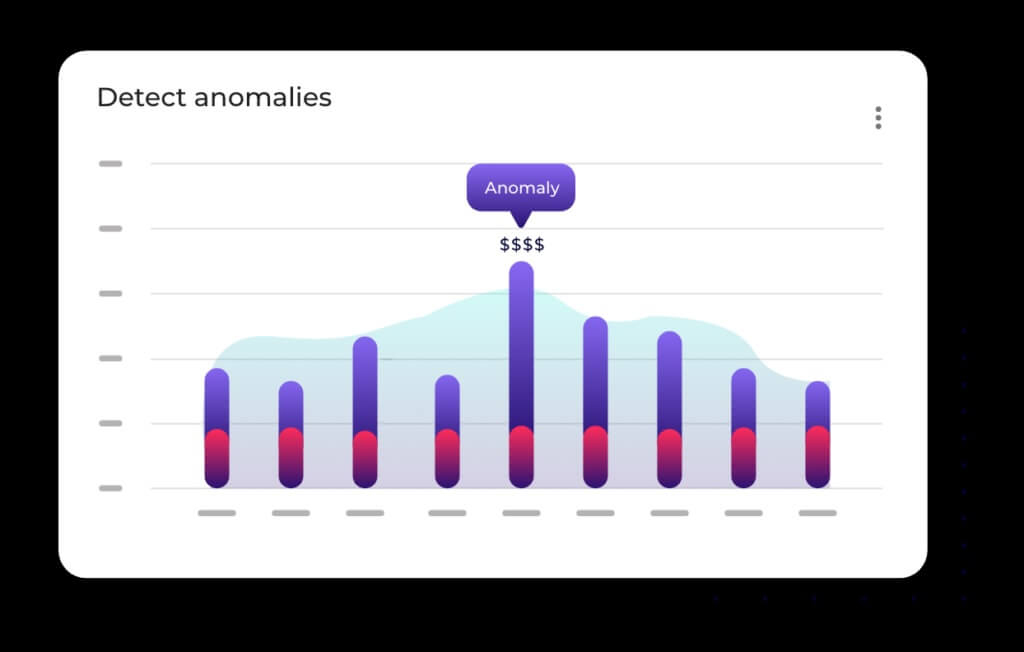

高可用性とスケーラビリティ

異常検知のグラフ

異常検知のグラフ

(出典)

Kubernetesは高可用性とスケーラビリティを念頭に設計されており、いずれも今日のミッションクリティカルなアプリケーションに欠かせない要素です。高可用性は、単一障害点を避けるための複数のコントロールプレーンインスタンスと、個々のインスタンスに不具合が起きてもコアコンポーネントを動かし続けるリーダー選出戦略によって支えられます。

ノードレベルでは、Kubernetesがworkloadをノード間に分散し、フェイルオーバー機構によってアプリケーション性能に影響を与えずノード障害から復旧します。さらなる耐障害性を求める組織は、地理的冗長性を確保し、より大規模な障害に備えるために、マルチゾーンやマルチリージョン構成を採用しています。

スケーラビリティもKubernetesの大きな特徴です。Horizontal Pod Autoscaler(HPA)はリアルタイムのメトリクスに応じてPodレプリカ数を調整し、リソースを最適化しつつトラフィック変動に効率よく対応します。同様に、Cluster Autoscalerはworkloadの需要に合わせてノードを追加・削減でき、適切に設定すればスケーリングをよりスムーズかつコスト効率よく行えます。

Kubernetesは大規模運用に耐え、単一クラスタで数千ノード規模までサポートできます。動的なリソース割り当てによってworkloadを賢く分散し、ボトルネックを抑え、全体の効率を高めます。

Kubernetesは、リソースを最大限に活かしてコストを抑える実践的な手段も用意しています。Podのリソースリクエストとリミットを設定すればスケジューラーがキャパシティを効率よく使え、ノードサイジングとオートスケーリングはコストとパフォーマンスのバランスに役立ちます。Prometheusのようなツールは、最適化判断の根拠となる利用メトリクスを提供します。利用データを継続的な最適化アクションへとつなげたい組織には、PerfectScale for Kubernetes by DoiTが、workloadのライトサイジング、ビンパッキングの改善、クラスタ全体のアイドルリソース削減を支援します。プラットフォーム全体についてはPerfectScaleもご覧ください。

DoiTでKubernetes活用を最適化

適切な専門知識がなければ、Kubernetes環境の運用は決して簡単ではありません。DoiTでは、こうした課題に効果的に向き合うためのKubernetes最適化・運用管理ソリューションを提供しています。当社プラットフォームが重視するのは次の点です。

- クラスタ性能の最適化による運用の円滑化

- クラウドインフラコストの削減による予算効率の向上

- デプロイプロセスの効率化による時間とリソースの節約

長期的な成功に向けたベストプラクティス構成は、GKE AcceleratorとEKS Acceleratorプログラムを通じて実装できます。

DoiTのプラットフォームは、リアルタイムのスケーリングインサイト、コストダッシュボードやライトサイジングのガイダンスといったコスト管理機能、コンテナレベルの分析や賢いworkload配置による性能改善を通じて、Kubernetesデプロイの最適化を後押しします。常時稼働の自動的なKubernetesコスト最適化を優先するなら、まずPerfectScale for Kubernetes by DoiTから始め、補足の製品情報にはPerfectScaleをご活用ください。

Kubernetesアーキテクチャに関するよくある質問

Kubernetesアーキテクチャとは何ですか?

Kubernetesアーキテクチャは、コントロールプレーンとワーカーノードという2つの主要コンポーネントで構成されます。コントロールプレーンはクラスタ状態の管理と全体的な意思決定を担い、ワーカーノードはコンテナ化アプリケーションを実行します。両者の連携により、分散workloadのスケーラブルかつ自動化されたオーケストレーションが実現します。

Kubernetesの中核コンポーネントは何ですか?

コントロールプレーンの中核コンポーネントには、kube-apiserver、etcd、kube-scheduler、kube-controller-managerが含まれます。ワーカーノードには、kubelet、コンテナランタイム(containerdやDockerなど)、kube-proxyのようなネットワーキングコンポーネントが含まれます。

Kubernetesコントロールプレーンとは何ですか?

Kubernetesコントロールプレーンは、クラスタの中央管理層です。kube-apiserver、etcd、スケジューラー、コントローラーマネージャーなどで構成されます。クラスタの望ましい状態を維持し、workloadをスケジューリングし、システムが意図どおりに動くことを保証します。

Kubernetesノードとは何ですか?

Kubernetesノードは、コンテナ化アプリケーションを動かすワーカーマシン(仮想または物理)です。各ノードにはkubelet、コンテナランタイム、ネットワーキングコンポーネントが含まれます。ノードは、workloadの実行に必要な計算、メモリ、ストレージのリソースを提供します。

kubeletとは何ですか?

kubeletはKubernetesの主要なノードエージェントです。コントロールプレーンと通信し、コンテナが指定どおりに動作していることを確認し、Podの健全性を監視し、各ノード上でコンテナのライフサイクルを管理します。

Kubernetesにおけるetcdとは何ですか?

etcdはKubernetesの主要なデータストアとして使われる分散キーバリューストアです。構成データやメタデータを含むクラスタ全体の状態を保持し、クラスタ全体での一貫性と信頼性を確保します。

KubernetesにおけるHPAとは何ですか?

HPAはHorizontal Pod Autoscalerの略です。CPU使用率やカスタムアプリケーションメトリクスといったリアルタイム指標に基づいて、デプロイメント内のPodレプリカ数を自動で調整します。トラフィックが変動するときも性能維持に役立ちます。

Kubernetesはどのように高可用性を実現しますか?

Kubernetesは、複数のコントロールプレーンインスタンス、自動フェイルオーバー、セルフヒーリングコンテナ、ノード間でのworkload分散、マルチゾーン/マルチリージョン構成のサポートによって高可用性を実現します。

Kubernetesはどのようにスケーリングを扱いますか?

Kubernetesは、workloadの需要に応じてPodレプリカを調整するHorizontal Pod Autoscaler(HPA)と、リソース要件に応じてノードを追加・削減するCluster Autoscalerによってスケーリングをサポートします。

Kubernetesはコスト効率に優れていますか?

Kubernetesは、リソース割り当ての最適化、オートスケーリングの活用、ビンパッキングの改善、アイドルインフラの削減により、コスト効率を高められます。最適化ツールを使えば、自動ライトサイジングやworkload分析を通じて効率をさらに引き上げられます。

KubernetesとDockerの違いは何ですか?

Dockerはアプリケーションと依存関係をコンテナにパッケージングするコンテナ化プラットフォームです。Kubernetesは、クラスタ全体でコンテナを管理・スケーリング・自動化するコンテナオーケストレーションプラットフォームです。Dockerがコンテナをつくり、Kubernetesがそれを大規模に管理します。

マネージドKubernetesサービスを使うべきですか?

Amazon EKS、Google Kubernetes Engine(GKE)、Azure Kubernetes Service(AKS)といったマネージドサービスは、コントロールプレーンの管理、アップグレード、高可用性を引き受け、運用オーバーヘッドを軽減します。チームはインフラ保守ではなく、アプリケーション開発に専念できます。

AWSからAzureまで、DoiTのKubernetesアクセラレーターとクラウドアナリティクスを活用すれば、複雑なKubernetesアーキテクチャをシンプルにし、ビジネスの戦略的なDevOpsの強みへと変えられます。

PerfectScale for Kubernetes by DoiTを今すぐご覧いただき、自動ライトサイジングと賢いスケーリングが、性能を犠牲にせず無駄を減らすさまをご確認ください。製品の詳細はPerfectScaleへ。