Kubernetes hat sich zu einer Schlüsseltechnologie im Cloud Computing entwickelt und kann grundlegend verändern, wie Ihr Unternehmen containerisierte Anwendungen bereitstellt, skaliert und verwaltet. Als Open-Source-System für Container-Orchestrierung vereinfacht es den Betrieb verteilter Systeme und sorgt dafür, dass Anwendungen in unterschiedlichsten Umgebungen zuverlässig laufen. Was bringt Kubernetes konkret für Ihr Unternehmen? Durch automatisiertes Deployment, Skalierung und Recovery verschlanken Sie den Betrieb und schaffen Freiraum für Innovation.

Wenn für Ihr Unternehmen Effizienz und Zuverlässigkeit zählen, liefert Kubernetes das passende Werkzeug. Teams können damit Systeme souverän steuern und Workflows verbessern. Mit Funktionen wie Load Balancing, automatisierten Rollouts und Skalierung ist Kubernetes für DevOps praktisch unverzichtbar – Ressourcen werden optimal genutzt, und Ihre Anwendungen bleiben robust.

Was ist Kubernetes-Architektur?

Bevor wir uns der Kubernetes-Architektur widmen, lohnt sich ein Blick auf Containerisierung und ihre Bedeutung für die Anwendungsbereitstellung. Containerisierung ist gewissermaßen eine schlanke Variante der Virtualisierung. Sie bündelt eine Anwendung samt all ihrer Abhängigkeiten (etwa Bibliotheken, Binaries und Konfigurationsdateien) in einem portablen Paket – dem sogenannten Container. Anders als klassische virtuelle Maschinen, die für jede Instanz ein vollständiges Betriebssystem benötigen, teilen sich Container den OS-Kernel des Hostsystems. Das macht sie effizienter und schneller startbereit.

Containerisierung ist eine schlanke Alternative zur klassischen Virtualisierung: Da der Host-OS-Kernel gemeinsam genutzt wird, sinkt der Overhead, der Start beschleunigt sich und der Ressourcenverbrauch sinkt. Container schaffen einheitliche Umgebungen und ermöglichen das Prinzip "einmal bauen, überall ausführen".

Kubernetes vereinfacht den Betrieb großer Container-Deployments mit Funktionen wie Skalierbarkeit, Automatisierung, Self-Healing und einem starken Ökosystem – und gehört damit zu den führenden Plattformen für Container-Orchestrierung. Es bietet ein verlässliches Framework, um die Komplexität verteilter Computing-Umgebungen effizient und präzise in den Griff zu bekommen. In einer klassischen Umgebung müsste Ihr Team Deployment und Skalierung von Anwendungen manuell verwalten – ein zeitaufwendiger, fehleranfälliger Prozess, der mit wachsender Infrastruktur immer schwerer beherrschbar wird.

Indem Kubernetes Aufgaben über eine einzige API automatisiert, wird vieles einfacher: Sie verwalten Container über unterschiedliche Umgebungen hinweg. Dank Self-Healing erholt sich das System eigenständig von Ausfällen. Mit Kubernetes rollt Ihr Team neue App-Versionen reibungslos aus, während alles weiterläuft und auch bei hoher Last reaktionsschnell bleibt.

Werfen wir einen Blick darauf, wie Kubernetes einige der größten Herausforderungen beim Software-Deployment löst:

- Automatische Skalierung: Kubernetes passt Ressourcen in Echtzeit an die Anwendungsnachfrage an, sodass Ihr System Schwankungen ohne manuelles Eingreifen bewältigt.

- Self-Healing-Fähigkeiten: Fällt ein Container aus, erkennt Kubernetes das Problem und ersetzt ihn automatisch – Ihre Anwendungen laufen reibungslos weiter.

- Updates ohne Downtime: Mit nahtlosen Rollouts und Rollbacks lassen sich Updates einspielen, ohne Nutzer zu stören – Ausfallzeiten werden minimiert.

- Fortgeschrittenes Networking: Kubernetes meistert komplexe Netzwerkanforderungen und sorgt für reibungslose Kommunikation zwischen mehreren Containern in verteilten Systemen.

- Intelligente Ressourcennutzung: Das Workload-Scheduling ist so optimiert, dass die Infrastruktur bestmöglich ausgelastet wird – das hilft beim Kostenmanagement und sichert die Performance.

Kubernetes nimmt Ihnen die Komplexität beim Betrieb containerisierter Anwendungen ab, sodass Sie sich auf Entwicklung und Betrieb Ihrer Software konzentrieren können – ohne sich um die Infrastruktur kümmern zu müssen. Die wichtigsten Vorteile auf einen Blick:

- Flexibilität: Anwendungen lassen sich mühelos in unterschiedlichsten Umgebungen bereitstellen.

- Konsistenz: Verlässliche Performance – ob On-Premises, bei Cloud-Anbietern oder in hybriden Umgebungen.

- Effizienz: Reduzieren Sie operativen Aufwand durch Automatisierung von Routineaufgaben.

- Skalierbarkeit: Komplexe, verteilte Systeme lassen sich ohne zusätzlichen Aufwand effektiv steuern.

- Kostenoptimierung: Verbessern Sie die Ressourcenauslastung, um Kosten wirksamer zu steuern. Für Teams, die Resource Requests und Knoten-Effizienz fortlaufend optimieren wollen, liefert PerfectScale for Kubernetes by DoiT automatisierte Analysen und konkrete Handlungsempfehlungen auf Basis des realen Workload-Verhaltens.

Wenn Sie Kubernetes einführen möchten, stehen Ihnen erstklassige Managed-Service-Optionen der großen Cloud-Anbieter zur Verfügung. Amazons Elastic Kubernetes Service (EKS), Google Kubernetes Engine (GKE) und Azure Kubernetes Service (AKS) übernehmen die Schwerstarbeit für Sie. Diese Dienste kümmern sich um komplexe Aufgaben wie das Management der Control Plane, automatisierte Updates und die Sicherstellung hoher Verfügbarkeit.

Jeder Anbieter hat eigene Stärken: EKS integriert sich nahtlos mit AWS-Diensten, GKE bietet fortschrittliche Autoscaling-Funktionen, und AKS punktet mit starker Azure-DevOps-Integration. Mit einem Managed Service können Sie sich auf Ihre Anwendungen konzentrieren, während der Anbieter die Infrastrukturkomplexität trägt.

Kurzum: Mit praxisnahen Lösungen, die Ihren Workflow vereinfachen und sich an Ihre individuellen Anforderungen anpassen, nimmt Kubernetes Ihnen die Last beim Anwendungsmanagement ab.

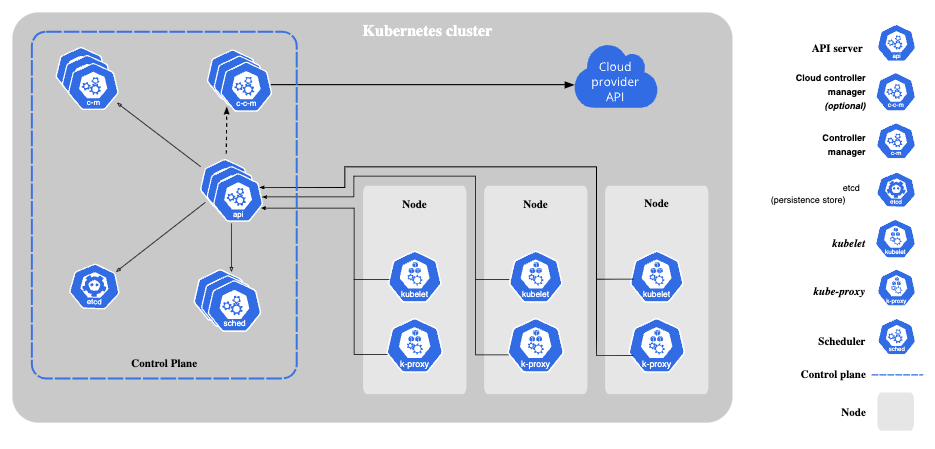

Die zentralen Komponenten der Kubernetes-Architektur

( Quelle)

Die Kubernetes-Architektur basiert auf zwei Kernkomponenten: der Control Plane und den Worker Nodes. Diese Struktur sorgt für eine zuverlässige, skalierbare und flexible Plattform für den Betrieb containerisierter Anwendungen. Durch die klare Aufgabenteilung zwischen beiden Komponenten ermöglicht Kubernetes effiziente Orchestrierung und vereinfacht das Skalieren und Verwalten von Workloads.

Architektur der Kubernetes Control Plane

Die Control Plane überwacht einen Kubernetes-Cluster – eine Gruppe von Worker-Maschinen (sogenannte Nodes), auf denen containerisierte Anwendungen laufen. Der Cluster ist das Rückgrat Ihres Deployments und vereint alle Maschinen und Ressourcen, die für den Betrieb Ihrer Apps nötig sind, zu einer geschlossenen, verwaltbaren Einheit.

Zu den Komponenten der Control Plane zählen:

kube-apiserver

kube-apiserver ist die zentrale Management-Komponente eines Kubernetes-Clusters. Seine Aufgaben:

- Bereitstellen des Zugriffs auf die Kubernetes-API – dem zentralen Einstiegspunkt für die Interaktion mit dem Cluster.

- Verwalten administrativer Aufgaben und Überwachen des Cluster-Zustands, damit alles reibungslos läuft.

- Funktion als primäre Schnittstelle für Cluster-Interaktionen, sodass Sie Operationen effektiv steuern und verwalten können.

etcd

etcd ist ein verteilter, konsistenter Key-Value-Store, der eine zentrale Rolle in der Kubernetes-Architektur spielt. Seine wichtigsten Vorteile:

- Dient als primärer Datenspeicher des Clusters und hält den vollständigen Systemzustand vor.

- Schützt die Daten Ihres Clusters und macht sie wiederherstellbar – durch zuverlässige Konfigurations-Backups.

- Sorgt für Stabilität und Zuverlässigkeit durch konsistentes State-Management im gesamten Cluster.

- Minimiert Ausfallzeiten dank hoher Verfügbarkeit über die verteilte Architektur.

kube-scheduler

Der kube-scheduler bestimmt die optimale Platzierung der Pods innerhalb eines Kubernetes-Clusters. Beim Scheduling berücksichtigt er mehrere Faktoren:

- Ressourcenanforderungen: Stellt sicher, dass der Pod die benötigte CPU, den Arbeitsspeicher und weitere Ressourcen erhält.

- Hardware-/Software-Anforderungen: Ordnet den Pod Nodes zu, die spezifische Hardware- oder Software-Anforderungen erfüllen.

- Affinity- und Anti-Affinity-Regeln: Berücksichtigt Regeln, die festlegen, welche Pods zusammen platziert (oder voneinander getrennt) werden sollen.

- Datenlokalität: Platziert Pods näher an den benötigten Daten, um Latenz zu minimieren.

- Performance-Optimierung: Verteilt Workloads auf die Nodes, um die Cluster-Performance zu steigern.

kube-controller-manager

Der kube-controller-manager steuert mehrere Controller-Prozesse, um den gewünschten Zustand des Clusters aufrechtzuerhalten. Wichtige Controller sind:

- Node Controller: Überwacht Zustand und Status der Nodes, um deren ordnungsgemäßen Betrieb sicherzustellen.

- Replication Controller: Sorgt dafür, dass die korrekte Anzahl an Pod-Replikaten läuft.

- Endpoints Controller: Verwaltet die Service-Endpoints für effiziente Kommunikation.

- Service-Account- & Token-Controller: Übernehmen Authentifizierung und Verwaltung von Access Tokens für sichere Operationen.

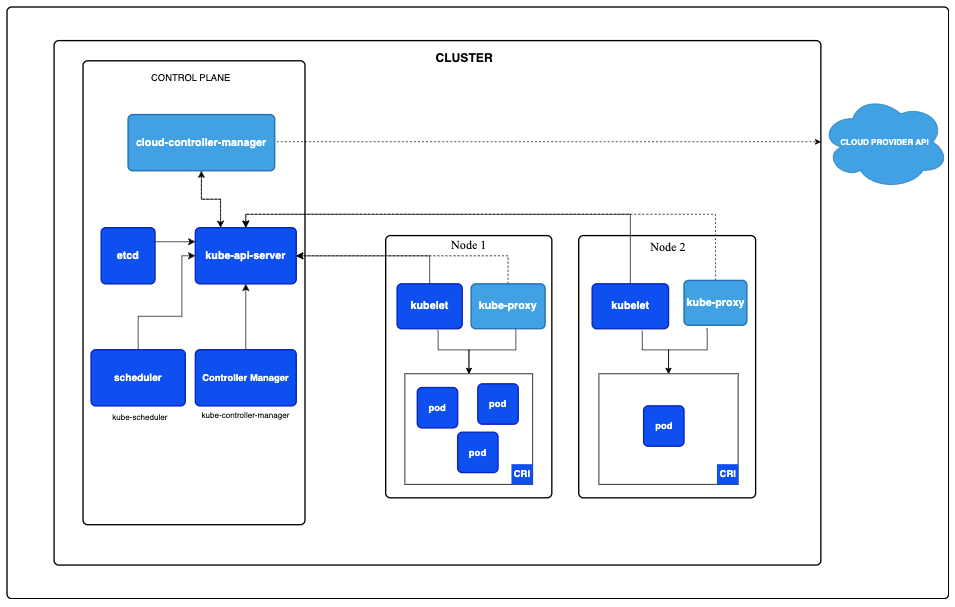

Architektur der Kubernetes-Nodes

( Quelle)

Worker Nodes sind die Rechenmaschinen des Kubernetes-Clusters und führen Ihre containerisierten Anwendungen aus. Sie sind im Grunde die Compute-Ressourcen, für die Sie in Ihrer Cloud-Umgebung bezahlen – Anzahl und Größe wirken sich also direkt auf Ihre Kosten aus. Wer die Kubernetes-Ausgaben senken will, setzt deshalb häufig bei einer besseren Auslastung der Nodes an. Anzahl und Größe der Nodes anzupassen und das Bin-Packing zu verbessern, kann einen großen Unterschied machen.

Um die Effizienz zu steigern und Waste über Cluster und Workloads hinweg zu reduzieren, unterstützt PerfectScale for Kubernetes by DoiT Teams dabei, Requests und Limits kontinuierlich richtig zu dimensionieren, die Pod-Platzierung zu verbessern und ungenutzte Ressourcen zu identifizieren. Weitere Produktdetails finden Sie auch unter PerfectScale.

Worker Nodes umfassen folgende Komponenten:

kubelet

Das kubelet ist der primäre Node-Agent in Kubernetes. Es übernimmt mehrere zentrale Aufgaben für den reibungslosen Betrieb Ihres Clusters:

- Kommunikation mit der Control Plane: Das kubelet meldet sich regelmäßig bei der Control Plane, nimmt Anweisungen entgegen und meldet Status sowie Workloads des Nodes zurück.

- Korrekter Betrieb der Pods: Stellt sicher, dass die Container in jedem Pod wie erwartet laufen, und greift bei Problemen ein.

- Überwachung der Node- und Pod-Gesundheit: Verfolgt den Zustand des Nodes und seiner Pods und meldet Probleme, um Stabilität und Performance zu sichern.

- Management der Container-Lebenszyklen: Startet und stoppt Container und steuert Neustarts über den gesamten Container-Lebenszyklus hinweg.

Container Runtime

Die Container Runtime ist für die Ausführung der Container in einer Kubernetes-Umgebung zuständig. Sie unterstützt mehrere Runtimes (darunter Docker, containerd und CRI-O) und übernimmt zentrale Aufgaben wie:

- Abrufen von Container-Images aus Registries

- Effiziente Ausführung von Containern

- Isolation von Ressourcen für stabile und sichere Performance

Welche weiteren Infrastruktur-Komponenten gibt es in Kubernetes?

Kubernetes umfasst mehrere zentrale Infrastruktur-Komponenten, die ergänzend zu den Kernfunktionen wirken. Hier ein Überblick über die jeweiligen Aufgaben:

- Pods: Die kleinsten deploybaren Einheiten in Kubernetes. Pods enthalten einen oder mehrere Container, die sich Ressourcen teilen und gemeinsam als Einheit laufen.

- Deployments: Definieren den gewünschten Zustand für Pods und Replica Sets und sorgen dafür, dass Ihre Anwendung reibungslos läuft und passend skaliert.

- Services: Schaffen einen stabilen Mechanismus für Networking und Kommunikation, sodass verschiedene Teile Ihrer Anwendung zuverlässig miteinander interagieren.

- Namespaces: Bieten eine Möglichkeit, Ressourcen innerhalb des Clusters zu isolieren – das erleichtert das Strukturieren und Verwalten komplexer Umgebungen.

- Persistent Volumes: Halten Ihre Daten sicher, indem sie den Speicher von einzelnen Pods entkoppeln – die Daten bleiben auch bei einer Neuerstellung der Pods erhalten.

- ConfigMaps und Secrets: Helfen beim effizienten Management von Konfigurations- und sensiblen Daten und halten Anwendungen flexibel und sicher.

Jede dieser Komponenten spielt eine wichtige Rolle dabei, das Anwendungsmanagement zu verschlanken und reibungsloses Skalieren innerhalb des Clusters zu ermöglichen. Im Zusammenspiel vereinfachen sie komplexe Prozesse und machen es leichter, Ihr System effizient zu betreiben und auszubauen.

Wie die Komponenten zusammenspielen

Vereinfachtes Kubernetes-Diagramm ( Quelle)

Das Kubernetes-Ökosystem lebt von gut orchestrierten Interaktionen, die eine dynamische Container-Management-Umgebung schaffen. Bei einem Deployment-Request übermittelt ein Nutzer eine Konfiguration über die Kubernetes-API. Der kube-apiserver validiert die Anfrage und fungiert als Einstiegspunkt für Cluster-Operationen. Anschließend analysiert der Scheduler den Cluster-Zustand, um den besten Node für den Workload zu finden – unter Berücksichtigung verfügbarer Ressourcen, Hardware-Beschränkungen und Workload-Verteilung.

Danach zieht das kubelet auf dem Ziel-Node die benötigten Container-Images aus der Registry, während kube-proxy das Netzwerk-Routing konfiguriert, um die Kommunikation innerhalb des Clusters und zu externen Diensten aufrechtzuerhalten. Die Container Runtime startet daraufhin die Container und führt das System näher an den gewünschten Zustand heran.

Die eigentliche Stärke von Kubernetes liegt in seiner kontinuierlichen Überwachung und Selbstheilung. Controller vergleichen permanent den aktuellen Cluster-Zustand mit dem gewünschten und korrigieren bei Bedarf. Dazu gehört, ausgefallene Container zu ersetzen, Workloads bei Node-Ausfällen umzuverteilen und Ressourcen neu zuzuweisen, um Performance und Zuverlässigkeit zu erhalten.

Dieses Zusammenspiel der Komponenten sorgt dafür, dass Kubernetes-Cluster widerstandsfähig, effizient und reaktionsschnell auf wechselnde Anforderungen bleiben. Die Fähigkeit zu überwachen, zu heilen und zu optimieren senkt den operativen Aufwand, steigert die Zuverlässigkeit und beschleunigt Innovation.

Best Practices und Prinzipien für die Kubernetes-Architektur

Belastbare Use Cases für die Kubernetes-Architektur entstehen, wenn Sie sich an einige grundlegende Best Practices halten. Werfen wir einen Blick auf die wichtigsten Prinzipien, mit denen Sie zuverlässige, skalierbare und sichere Systeme entwerfen.

Unveränderliche Infrastruktur

- Behandeln Sie Container als Wegwerfartikel. Gestalten Sie Ihr System so, dass Container ersetzt und nicht im Betrieb verändert werden.

- Verzichten Sie auf Änderungen direkt an laufenden Containern. Setzen Sie stattdessen auf deklarative Konfigurationen, um Konsistenz und Wiederholbarkeit zu gewährleisten.

- Setzen Sie auf versionierte, unveränderliche Container-Images, um Stabilität und Vorhersagbarkeit zu sichern – als verlässliche Grundlage für Ihre Anwendungen.

Microservices-Design

- Strukturieren Sie Ihre Anwendung als lose gekoppelte Services, damit Komponenten unabhängig voneinander funktionieren.

- Entwerfen Sie jeden Service so, dass er bedarfsgerecht unabhängig skaliert – das ermöglicht eine bessere Ressourcenzuweisung.

- Erleichtern Sie Wartung und Updates, indem Sie Services klein und auf eine konkrete Aufgabe fokussiert halten.

Ressourcenmanagement

- Definieren Sie klare Resource Requests und Limits für Container, um Ressourcenkonflikte und Übernutzung zu vermeiden.

- Setzen Sie Skalierungsstrategien wie Horizontal Pod Autoscaling ein, um sich an Workload-Veränderungen anzupassen.

- Beobachten Sie die Ressourcennutzung regelmäßig, um Ineffizienzen zu erkennen und die Systemleistung zu optimieren.

Sicherheitsaspekte

- Schützen Sie Ihren Cluster mit starken Authentifizierungsmechanismen und beschränken Sie den Zugriff auf autorisierte Nutzer und Systeme.

- Nutzen Sie Role-Based Access Control (RBAC) zur Verwaltung von Berechtigungen – jede Rolle erhält nur die nötigen Zugriffsrechte.

- Halten Sie Kubernetes-Komponenten und Container-Images mit den neuesten Patches aktuell, um Schwachstellen zu reduzieren.

- Beschränken Sie Container-Privilegien nach dem Least-Privilege-Prinzip auf das nötige Minimum.

Wenn Sie diese Best Practices befolgen, schaffen Sie eine Kubernetes-Architektur, die effizient, skalierbar und sicher ist. Herausforderungen lassen sich zwar nie ganz vermeiden – doch diese Prinzipien bieten ein solides Fundament für Ihre Arbeit und den Betrieb eines verlässlichen Systems.

Hochverfügbarkeit und Skalierbarkeit

Diagramm zur Anomalieerkennung

Diagramm zur Anomalieerkennung

( Quelle)

Kubernetes ist auf Hochverfügbarkeit und Skalierbarkeit ausgelegt – zwei Pflichtmerkmale für heutige unternehmenskritische Anwendungen. Hochverfügbarkeit entsteht durch mehrere Control-Plane-Instanzen, um Single Points of Failure zu vermeiden, sowie durch Leader-Election-Strategien, die Kernkomponenten selbst dann funktionsfähig halten, wenn einzelne Instanzen Probleme haben.

Auf Node-Ebene verteilt Kubernetes Workloads über mehrere Nodes und nutzt Failover-Mechanismen, um sich von Node-Ausfällen zu erholen, ohne die Anwendungsleistung zu beeinträchtigen. Für zusätzliche Resilienz setzen Unternehmen häufig auf Multi-Zone- oder Multi-Region-Deployments, die geografische Redundanz schaffen und vor größeren Infrastrukturausfällen schützen.

Skalierbarkeit ist ein weiteres Schlüsselmerkmal von Kubernetes. Der Horizontal Pod Autoscaler (HPA) passt die Anzahl der Pod-Replikate auf Basis von Echtzeit-Metriken an und hilft Anwendungen, Traffic-Schwankungen effizient zu bewältigen, ohne Ressourcen zu verschwenden. Ähnlich kann der Cluster Autoscaler nach Bedarf Nodes hinzufügen oder entfernen, um die Workload-Anforderungen zu erfüllen – richtig konfiguriert wird Skalierung damit nahtloser und kosteneffizienter.

Kubernetes unterstützt Großbetrieb mit Tausenden Nodes in einem einzigen Cluster. Es nutzt dynamische Ressourcenzuweisung, um Workloads intelligent zu verteilen, Engpässe zu reduzieren und die Gesamteffizienz zu steigern.

Kubernetes bietet außerdem praxisnahe Wege, um Kosten im Griff zu behalten und Ressourcen optimal zu nutzen. Durch das Setzen von Pod-Resource-Requests und -Limits kann der Scheduler die verfügbare Kapazität effizient nutzen, während die richtige Node-Dimensionierung und Autoscaling helfen, Kosten und Performance auszubalancieren. Tools wie Prometheus liefern Nutzungsmetriken als Grundlage für Optimierungsentscheidungen. Wer Nutzungsdaten in fortlaufende Optimierungsmaßnahmen übersetzen will, findet in PerfectScale for Kubernetes by DoiT einen Partner, um Workloads richtig zu dimensionieren, das Bin-Packing zu verbessern und Waste durch ungenutzte Ressourcen über Cluster hinweg zu reduzieren. Die Plattform im Detail finden Sie unter PerfectScale.

Optimieren Sie Ihren Kubernetes-Weg mit DoiT

Ohne die richtige Expertise kann der Betrieb von Kubernetes-Umgebungen herausfordernd sein. Bei DoiT bieten wir Lösungen für Kubernetes-Optimierung und -Management, mit denen Ihr Unternehmen diese Herausforderungen wirksam meistert. Im Fokus unserer Plattform stehen:

- Optimierung der Cluster-Performance für reibungsloseren Betrieb

- Senkung der Cloud-Infrastrukturkosten zur Steigerung der Budget-Effizienz

- Verschlankung der Deployment-Prozesse, um Zeit und Ressourcen zu sparen

Mit unseren GKE Accelerator- und EKS Accelerator-Programmen setzen Sie Best-Practice-Konfigurationen für nachhaltigen Erfolg um.

Die DoiT-Plattform vereinfacht die Optimierung von Kubernetes-Deployments mit Echtzeit-Skalierungsanalysen, Cost-Management-Funktionen wie Kosten-Dashboards und Right-Sizing-Empfehlungen sowie Performance-Verbesserungen wie Container-Level-Analytics und intelligenterer Workload-Platzierung. Wer auf automatisierte, dauerhaft aktive Kubernetes-Kostenoptimierung setzen will, startet mit PerfectScale for Kubernetes by DoiT; ergänzende Produktinformationen finden Sie unter PerfectScale.

Häufig gestellte Fragen zur Kubernetes-Architektur

Was ist die Kubernetes-Architektur?

Die Kubernetes-Architektur besteht aus zwei Hauptkomponenten: der Control Plane und den Worker Nodes. Die Control Plane verwaltet den Cluster-Zustand und trifft globale Entscheidungen, während die Worker Nodes containerisierte Anwendungen ausführen. Gemeinsam ermöglichen sie die skalierbare, automatisierte Orchestrierung verteilter Workloads.

Was sind die Kernkomponenten von Kubernetes?

Zu den Kernkomponenten der Control Plane zählen kube-apiserver, etcd, kube-scheduler und kube-controller-manager. Worker Nodes umfassen das kubelet, eine Container Runtime (z. B. containerd oder Docker) sowie Networking-Komponenten wie kube-proxy.

Was ist die Kubernetes Control Plane?

Die Kubernetes Control Plane ist die zentrale Management-Ebene eines Clusters. Zu ihr gehören Komponenten wie kube-apiserver, etcd, Scheduler und Controller Manager. Die Control Plane hält den gewünschten Zustand des Clusters aufrecht, plant Workloads und stellt sicher, dass das System wie vorgesehen läuft.

Was sind Kubernetes-Nodes?

Kubernetes-Nodes sind Worker-Maschinen – virtuell oder physisch –, auf denen containerisierte Anwendungen laufen. Jeder Node enthält ein kubelet, eine Container Runtime und Networking-Komponenten. Nodes stellen die Compute-, Memory- und Storage-Ressourcen bereit, die zur Ausführung von Workloads benötigt werden.

Was ist das kubelet?

Das kubelet ist der primäre Node-Agent in Kubernetes. Es kommuniziert mit der Control Plane, stellt sicher, dass Container wie spezifiziert laufen, überwacht die Pod-Gesundheit und verwaltet die Container-Lebenszyklen auf jedem Node.

Was ist etcd in Kubernetes?

etcd ist ein verteilter Key-Value-Store, der als primäres Datenspeichersystem von Kubernetes dient. Er hält den vollständigen Cluster-Zustand vor, einschließlich Konfigurationsdaten und Metadaten. etcd sorgt für Konsistenz und Zuverlässigkeit über den gesamten Cluster.

Was ist HPA in Kubernetes?

HPA steht für Horizontal Pod Autoscaler. Er passt die Anzahl der Pod-Replikate in einem Deployment automatisch an Echtzeit-Metriken wie CPU-Auslastung oder anwendungsspezifische Metriken an. HPA hilft, die Performance bei Traffic-Schwankungen aufrechtzuerhalten.

Wie sorgt Kubernetes für Hochverfügbarkeit?

Kubernetes gewährleistet Hochverfügbarkeit durch mehrere Control-Plane-Instanzen, automatisiertes Failover, selbstheilende Container, Workload-Verteilung über Nodes hinweg sowie die Unterstützung von Multi-Zone- und Multi-Region-Deployments.

Wie handhabt Kubernetes Skalierung?

Kubernetes unterstützt Skalierung über den Horizontal Pod Autoscaler (HPA), der Pod-Replikate basierend auf der Workload-Nachfrage anpasst, und den Cluster Autoscaler, der Nodes je nach Ressourcenbedarf hinzufügt oder entfernt.

Ist Kubernetes kosteneffizient?

Kubernetes kann die Kosteneffizienz steigern, indem es die Ressourcenzuweisung optimiert, Autoscaling ermöglicht, das Bin-Packing verbessert und ungenutzte Infrastruktur reduziert. Optimierungstools können die Effizienz durch automatisiertes Right-Sizing und Workload-Analyse weiter erhöhen.

Was ist der Unterschied zwischen Kubernetes und Docker?

Docker ist eine Containerisierungs-Plattform, die Anwendungen samt ihrer Abhängigkeiten in Container verpackt. Kubernetes ist eine Plattform für Container-Orchestrierung, die Container über Cluster hinweg verwaltet, skaliert und automatisiert. Docker erstellt Container; Kubernetes managt sie im großen Maßstab.

Sollte ich einen Managed Kubernetes Service nutzen?

Managed Services wie Amazon EKS, Google Kubernetes Engine (GKE) und Azure Kubernetes Service (AKS) reduzieren operativen Aufwand, indem sie Control Plane, Upgrades und Hochverfügbarkeit übernehmen. So können sich Teams auf die Anwendungsentwicklung konzentrieren statt auf die Pflege der Infrastruktur.

Von AWS bis Azure: Mit den Kubernetes-Acceleratoren und der Cloud Analytics von DoiT vereinfachen Sie komplexe Kubernetes-Architekturen und machen sie zu einem strategischen DevOps-Vorteil für Ihr Unternehmen.

Entdecken Sie noch heute PerfectScale for Kubernetes by DoiT und sehen Sie, wie automatisiertes Right-Sizing und intelligenteres Skalieren Waste reduzieren – ohne Performance-Einbußen. Mehr Hintergründe zum Produkt finden Sie unter PerfectScale.