Kubernetes è ormai una tecnologia cardine del cloud computing e può rivoluzionare il modo in cui la sua organizzazione distribuisce, scala e gestisce le applicazioni containerizzate. In quanto sistema open source per l'orchestrazione di container, semplifica la gestione dei sistemi distribuiti e permette alle applicazioni di funzionare in modo affidabile in ambienti diversi. Come può Kubernetes fare la differenza per la sua azienda? Automatizzando deployment, scaling e ripristino, Kubernetes aiuta la sua organizzazione a snellire le operazioni e a concentrarsi sull'innovazione.

Se la sua organizzazione punta a efficienza e affidabilità, Kubernetes mette a disposizione gli strumenti giusti per centrare questi obiettivi. Sono strumenti che permettono ai team di gestire i sistemi con sicurezza e di migliorare i flussi di lavoro. Grazie a funzionalità come load balancing, rollout automatici e scaling, Kubernetes è ormai imprescindibile per il DevOps: ottimizza le risorse mantenendo al tempo stesso le applicazioni resilienti.

Cos'è l'architettura Kubernetes?

Prima di addentrarci nell'architettura Kubernetes, è importante capire cos'è la containerizzazione e quale impatto ha sul deployment delle applicazioni. La containerizzazione è una sorta di versione leggera della virtualizzazione: racchiude un'applicazione e tutte le sue dipendenze (librerie, binari e file di configurazione) in un unico pacchetto portabile, chiamato container. A differenza delle macchine virtuali tradizionali, che richiedono un sistema operativo completo per ogni istanza, i container condividono il kernel del sistema operativo dell'host, risultando più efficienti e più rapidi all'avvio.

La containerizzazione è quindi un'alternativa leggera alla virtualizzazione tradizionale: condividendo il kernel del sistema operativo host riduce l'overhead, accelera l'avvio e consuma meno risorse. I container offrono ambienti coerenti e abilitano la logica del "build once, run anywhere".

Kubernetes semplifica la gestione di deployment di container su larga scala con funzionalità come scalabilità, automazione, self-healing e un ecosistema solido, posizionandosi come piattaforma di riferimento per l'orchestrazione di container. Offre un framework affidabile per affrontare con efficienza e precisione la complessità degli ambienti di calcolo distribuito. In un contesto tradizionale, ad esempio, il suo team dovrebbe gestire manualmente deployment e scaling delle applicazioni: un processo lungo, soggetto a errori e sempre più difficile da mantenere con la crescita dell'infrastruttura.

Automatizzando le attività tramite un'unica API, Kubernetes semplifica il lavoro e le consente di gestire i container in ambienti diversi. Include inoltre funzionalità di self-healing in grado di ripristinare automaticamente i guasti senza alcun intervento. Con Kubernetes il suo team può rilasciare nuove versioni delle applicazioni senza interruzioni, mantenendo tutto operativo e reattivo anche con traffico elevato.

Vediamo nel concreto come Kubernetes affronta alcune delle principali sfide del deployment software:

- Scaling automatico: Kubernetes regola le risorse in tempo reale in base alla domanda dell'applicazione, garantendo che il sistema gestisca i picchi senza intervento manuale.

- Self-healing: se un container va in errore, Kubernetes rileva il problema e lo sostituisce automaticamente, mantenendo le applicazioni operative.

- Aggiornamenti senza downtime: grazie a rollout e rollback fluidi, gli aggiornamenti vengono applicati senza interrompere il servizio agli utenti, riducendo al minimo i tempi di inattività.

- Networking avanzato: Kubernetes risponde a esigenze di rete complesse, garantendo una comunicazione fluida tra i numerosi container nei sistemi distribuiti.

- Utilizzo intelligente delle risorse: la pianificazione dei workloads è ottimizzata per sfruttare al meglio l'infrastruttura, aiutandola a tenere sotto controllo i costi senza compromettere le prestazioni.

Kubernetes alleggerisce le sfide della gestione delle applicazioni containerizzate e le permette di concentrarsi sullo sviluppo e sull'esecuzione del software, senza il peso della gestione dell'infrastruttura. Ecco alcuni dei principali vantaggi:

- Flessibilità: distribuisca le applicazioni con facilità in ambienti eterogenei.

- Coerenza: garantisca prestazioni affidabili, sia on-premises sia con cloud provider o in ambienti ibridi.

- Efficienza: riduca il carico operativo automatizzando le attività di gestione di routine.

- Scalabilità: gestisca con efficacia sistemi distribuiti complessi senza ulteriori difficoltà.

- Ottimizzazione dei costi: migliori l'utilizzo delle risorse per gestire i costi in modo più efficace. Per i team che vogliono ottimizzare in modo continuo richieste di risorse ed efficienza dei nodi, PerfectScale for Kubernetes by DoiT fornisce analisi automatizzate e raccomandazioni concrete basate sul comportamento reale dei workloads.

Quando deciderà di adottare Kubernetes, potrà contare su ottime opzioni di servizio gestito offerte dai principali cloud provider. Amazon Elastic Kubernetes Service (EKS), Google Kubernetes Engine (GKE) e Azure Kubernetes Service (AKS) si fanno carico delle attività più impegnative: gestione del control plane, automazione degli aggiornamenti e mantenimento dell'alta disponibilità.

Ognuno ha i propri punti di forza: EKS si integra in modo nativo con i servizi AWS, GKE offre funzionalità avanzate di autoscaling e AKS garantisce una solida integrazione con Azure DevOps. Optando per un servizio gestito, può dedicarsi alle sue applicazioni mentre il provider si occupa della complessità infrastrutturale.

In definitiva, grazie a soluzioni concrete che semplificano il flusso di lavoro e si adattano alle sue esigenze specifiche, Kubernetes riduce le difficoltà legate alla gestione delle applicazioni.

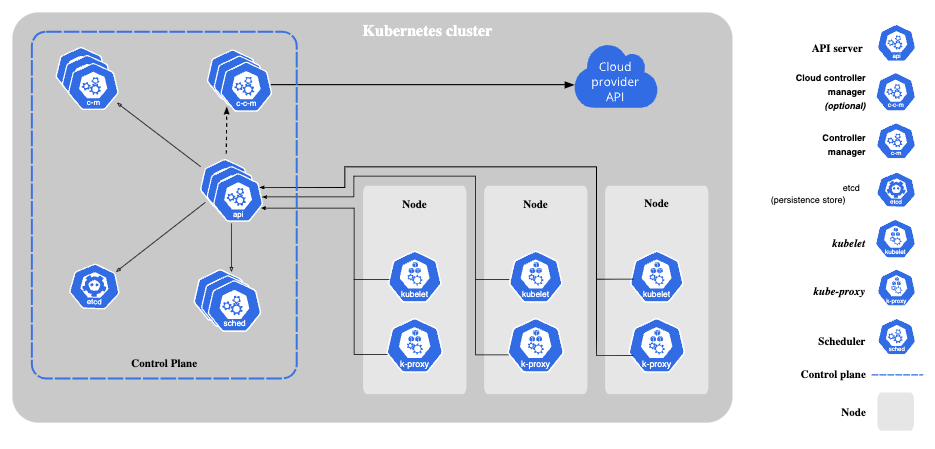

I componenti principali dell'architettura Kubernetes

( Fonte)

L'architettura Kubernetes si fonda su due componenti principali: il control plane e i worker node. Una struttura pensata per offrire una piattaforma affidabile, scalabile e flessibile per la gestione delle applicazioni containerizzate. Separando le responsabilità tra questi componenti, Kubernetes consente un'orchestrazione efficiente e semplifica scaling e gestione dei workloads.

Architettura del control plane di Kubernetes

Il control plane sovrintende un cluster Kubernetes, ovvero un insieme di macchine worker (chiamate nodi) che eseguono le applicazioni containerizzate. In Kubernetes il cluster è la spina dorsale del deployment: riunisce tutte le macchine e le risorse necessarie per eseguire le applicazioni come un'unica unità coesa e gestibile.

I componenti del control plane sono:

kube-apiserver

kube-apiserver è il componente centrale di gestione di un cluster Kubernetes. Nello specifico:

- Espone l'API di Kubernetes, che funge da punto di ingresso principale per interagire con il cluster.

- Gestisce le attività amministrative e supervisiona lo stato del cluster perché tutto continui a funzionare in modo regolare.

- Funge da interfaccia primaria per le interazioni con il cluster, permettendole di controllare e gestire le operazioni in modo efficace.

etcd

etcd è un key-value store distribuito e coerente, che svolge un ruolo cruciale nell'architettura Kubernetes. Tra i suoi principali vantaggi:

- Funge da meccanismo principale di archiviazione dati per il cluster, mantenendo lo stato completo del sistema.

- Mantiene i dati del cluster sicuri e ripristinabili tramite backup di configurazione affidabili.

- Garantisce stabilità e affidabilità con una gestione coerente dello stato dell'intero cluster.

- Riduce al minimo i tempi di inattività grazie all'alta disponibilità abilitata dalla sua architettura distribuita.

kube-scheduler

Il kube-scheduler ha il compito di individuare la collocazione ottimale dei pod all'interno di un cluster Kubernetes. Nella pianificazione dei pod considera diversi fattori:

- Requisiti di risorse: verifica che il pod disponga di CPU, memoria e altre risorse necessarie.

- Vincoli hardware/software: abbina il pod ai nodi che soddisfano specifiche esigenze hardware o software.

- Regole di affinità e anti-affinità: rispetta le regole che definiscono quali pod devono restare insieme (o separati).

- Località dei dati: colloca i pod il più vicino possibile ai dati di cui hanno bisogno per ridurre la latenza.

- Ottimizzazione delle prestazioni: bilancia i workloads tra i nodi per migliorare le prestazioni del cluster.

kube-controller-manager

Il kube-controller-manager coordina diversi processi controller per mantenere lo stato desiderato del cluster. Tra i controller principali:

- Node controller: monitora salute e stato dei nodi per assicurarne il corretto funzionamento.

- Replication controller: mantiene il numero corretto di repliche di pod in esecuzione, come specificato.

- Endpoints controller: gestisce la popolazione degli endpoint dei servizi per una comunicazione efficiente.

- Service account & token controllers: gestiscono l'autenticazione e i token di accesso per operazioni sicure.

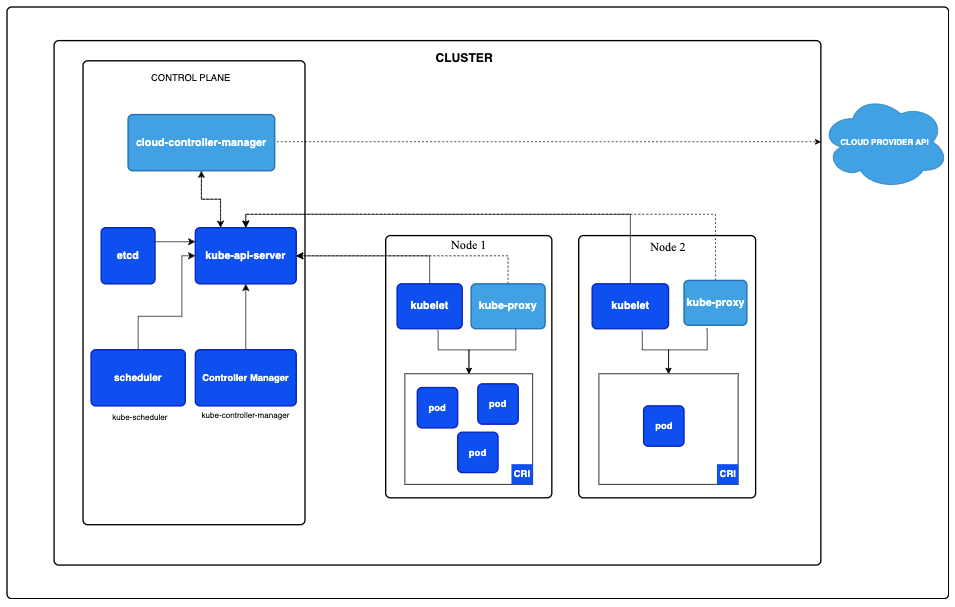

Architettura dei nodi Kubernetes

( Fonte)

I worker node sono i motori computazionali del cluster Kubernetes ed eseguono le applicazioni containerizzate. Sono di fatto le risorse di calcolo che paga nel suo setup cloud, perciò il loro numero e le loro dimensioni incidono direttamente sui costi. Quando si tratta di ridurre le spese di Kubernetes, le organizzazioni si concentrano spesso sull'utilizzo più efficiente dei nodi: rivedere il numero di nodi, migliorare il bin-packing e scegliere le giuste dimensioni può fare una grande differenza.

Per migliorare l'efficienza e ridurre gli sprechi tra cluster e workloads, PerfectScale for Kubernetes by DoiT aiuta i team a effettuare il right-sizing continuo di richieste e limiti, a migliorare il posizionamento dei pod e a individuare le risorse inutilizzate. Per ulteriori dettagli sul prodotto può visitare anche PerfectScale.

I worker node comprendono i seguenti componenti:

kubelet

Il kubelet è l'agente principale dei nodi in Kubernetes ed è responsabile di diverse attività chiave per il corretto funzionamento del cluster:

- Comunicazione con il control plane: il kubelet contatta regolarmente il control plane per ricevere istruzioni e segnalare lo stato del nodo e dei workloads.

- Esecuzione corretta dei pod: verifica che i container all'interno di ogni pod funzionino come previsto, intervenendo in caso di anomalie.

- Monitoraggio della salute di nodi e pod: tiene traccia dello stato del nodo e dei suoi pod, segnalando eventuali problemi per garantire stabilità e prestazioni.

- Gestione del ciclo di vita dei container: avvia e ferma i container e ne gestisce i riavvii lungo l'intero ciclo di vita.

Container runtime

Il container runtime si occupa dell'esecuzione dei container in un ambiente Kubernetes. Supporta diversi runtime (tra cui Docker, containerd e CRI-O) e gestisce attività essenziali come:

- Pull delle immagini dei container dai registri

- Esecuzione efficiente dei container

- Isolamento delle risorse per prestazioni stabili e sicure

Quali sono gli altri componenti dell'infrastruttura Kubernetes?

Kubernetes include diversi componenti infrastrutturali chiave che si affiancano alle funzionalità di base. Ecco una panoramica per capire il ruolo di ciascuno:

- Pod: le unità distribuibili più piccole in Kubernetes; contengono uno o più container che condividono risorse e funzionano insieme come un'unica unità.

- Deployment: definiscono lo stato desiderato di pod e replica set, e consentono all'applicazione di funzionare correttamente e di scalare in modo adeguato.

- Service: creano una modalità stabile per gestire networking e comunicazione, in modo che le diverse parti dell'applicazione possano interagire in modo affidabile.

- Namespace: permettono di isolare le risorse all'interno del cluster, semplificando l'organizzazione e la gestione di ambienti complessi.

- Volumi persistenti: mantengono i dati al sicuro separando lo storage dai singoli pod, in modo che persistano anche in caso di ricreazione dei pod.

- ConfigMap e secret: aiutano a gestire in modo efficiente la configurazione e i dati sensibili, mantenendo le applicazioni flessibili e sicure.

Ognuno di questi componenti svolge un ruolo importante nello snellire la gestione delle applicazioni e nell'abilitare uno scaling fluido all'interno del cluster. Lavorando insieme, contribuiscono a semplificare processi complessi, rendendo più facile gestire e far crescere il sistema in modo efficiente.

Le interazioni tra i componenti

Diagramma semplificato di Kubernetes ( Fonte)

L'ecosistema Kubernetes si basa su interazioni ben orchestrate per creare un ambiente dinamico di gestione dei container. Quando si effettua una richiesta di deployment, l'utente invia una configurazione tramite l'API di Kubernetes. Il kube-apiserver convalida la richiesta, agendo come punto di ingresso per le operazioni del cluster. Una volta validata, lo scheduler analizza lo stato del cluster per individuare il nodo migliore per il workload, considerando disponibilità delle risorse, vincoli hardware e distribuzione dei workloads.

A questo punto, il kubelet sul nodo di destinazione effettua il pull delle immagini dei container richieste dal registro, mentre kube-proxy configura il routing di rete per garantire la comunicazione all'interno del cluster e con i servizi esterni. Il container runtime avvia poi i container, avvicinando il sistema allo stato desiderato.

La vera forza di Kubernetes risiede nel monitoraggio continuo e nel self-healing. I controller confrontano costantemente lo stato attuale del cluster con quello desiderato e apportano le correzioni necessarie: sostituiscono i container guasti, ridistribuiscono i workloads in caso di malfunzionamento dei nodi e riallocano le risorse per mantenere prestazioni e affidabilità.

Questa orchestrazione dei componenti permette ai cluster Kubernetes di restare resilienti, efficienti e reattivi alle esigenze in evoluzione. La capacità di monitorare, ripristinare e ottimizzare riduce il carico operativo, aumenta l'affidabilità e accelera l'innovazione.

Best practice e principi dell'architettura Kubernetes

Per costruire casi d'uso solidi sull'architettura Kubernetes occorre seguire una serie di best practice fondamentali. Vediamo alcuni dei principi più importanti per progettare sistemi affidabili, scalabili e sicuri.

Infrastruttura immutabile

- Tratti i container come elementi sostituibili. Progetti il sistema in modo che i container possano essere sostituiti anziché modificati sul posto.

- Eviti di apportare modifiche direttamente ai container in esecuzione. Utilizzi invece configurazioni dichiarative per garantire coerenza e ripetibilità.

- Si affidi a immagini di container immutabili e versionate per mantenere stabilità e prevedibilità, offrendo una base affidabile alle sue applicazioni.

Progettazione a microservizi

- Strutturi l'applicazione come un insieme di servizi debolmente accoppiati, in modo che i componenti possano funzionare in modo indipendente.

- Progetti ogni servizio per scalare in autonomia in base alla domanda, consentendo una migliore allocazione delle risorse.

- Semplifichi manutenzione e aggiornamenti mantenendo i servizi compatti e focalizzati su attività specifiche.

Gestione delle risorse

- Specifichi richieste e limiti chiari di risorse per i container, per prevenire contese e utilizzi eccessivi.

- Implementi strategie di scaling come l'horizontal pod autoscaling per adattarsi alle variazioni dei workloads.

- Monitori regolarmente l'utilizzo delle risorse per individuare inefficienze e ottimizzare le prestazioni del sistema.

Aspetti di sicurezza

- Protegga il cluster con meccanismi di autenticazione robusti e limiti l'accesso a utenti e sistemi autorizzati.

- Utilizzi il role-based access control (RBAC) per gestire i permessi, limitando l'accesso a quanto strettamente necessario per ciascun ruolo.

- Mantenga aggiornati i componenti di Kubernetes e le immagini dei container con le patch più recenti per ridurre le vulnerabilità.

- Riduca al minimo i privilegi dei container seguendo il principio del minimo privilegio.

Seguendo queste best practice può costruire un'architettura Kubernetes efficiente, scalabile e sicura. Anche se possono presentarsi delle difficoltà, questi principi offrono una base solida per orientare i suoi sforzi e mantenere un sistema affidabile.

Alta disponibilità e scalabilità

Grafico di anomaly detection

Grafico di anomaly detection

( Fonte)

Kubernetes è progettato per offrire alta disponibilità e scalabilità: due requisiti imprescindibili per le applicazioni mission-critical di oggi. L'alta disponibilità nasce da più istanze del control plane, che eliminano i single point of failure, e da strategie di leader election che mantengono operativi i componenti core anche quando le singole istanze incontrano problemi.

A livello di nodo, Kubernetes distribuisce i workloads tra i nodi e utilizza meccanismi di failover per recuperare dai guasti senza impattare sulle prestazioni delle applicazioni. Per una resilienza ulteriore, le organizzazioni implementano spesso deployment multi-zona o multi-regione, che aggiungono ridondanza geografica e proteggono da disservizi infrastrutturali più estesi.

La scalabilità è un'altra caratteristica chiave di Kubernetes. L'Horizontal Pod Autoscaler (HPA) regola il numero di repliche dei pod in base a metriche in tempo reale, aiutando le applicazioni a gestire i cambiamenti di traffico in modo efficiente e ottimizzando le risorse. Allo stesso modo, il Cluster Autoscaler può aggiungere o rimuovere nodi secondo necessità per adeguarsi alle esigenze dei workloads, rendendo lo scaling più fluido ed economicamente efficiente quando configurato correttamente.

Kubernetes è in grado di supportare operazioni su larga scala e migliaia di nodi in un singolo cluster. Sfrutta l'allocazione dinamica delle risorse per distribuire i workloads in modo intelligente, riducendo i colli di bottiglia e migliorando l'efficienza complessiva.

Kubernetes offre anche strumenti concreti per tenere sotto controllo i costi sfruttando al massimo le risorse. L'impostazione di richieste e limiti per i pod aiuta lo scheduler a utilizzare la capacità in modo efficiente, mentre il dimensionamento dei nodi e l'autoscaling permettono di bilanciare costi e prestazioni. Strumenti come Prometheus forniscono metriche di utilizzo che orientano le decisioni di ottimizzazione. Per le organizzazioni che vogliono trasformare i dati di utilizzo in azioni di ottimizzazione continua, PerfectScale for Kubernetes by DoiT aiuta a fare il right-sizing dei workloads, a migliorare il bin-packing e a ridurre lo spreco di risorse inutilizzate tra i cluster. Può inoltre approfondire la piattaforma su PerfectScale.

Ottimizzi il suo percorso Kubernetes con DoiT

Senza le competenze giuste, gestire ambienti Kubernetes può rivelarsi complesso. In DoiT offriamo soluzioni di ottimizzazione e gestione di Kubernetes pensate per aiutare la sua organizzazione ad affrontare queste sfide in modo efficace. La nostra piattaforma si concentra su:

- Ottimizzazione delle prestazioni del cluster per operazioni più fluide

- Riduzione dei costi dell'infrastruttura cloud per migliorare l'efficienza del budget

- Snellimento dei processi di deployment per risparmiare tempo e risorse

Implementi configurazioni best-practice per il successo a lungo termine grazie ai nostri programmi GKE Accelerator ed EKS Accelerator.

La piattaforma DoiT semplifica l'ottimizzazione dei deployment Kubernetes con insight di scaling in tempo reale, funzionalità di gestione dei costi come dashboard di spesa e indicazioni per il right-sizing, oltre a miglioramenti delle prestazioni come analytics a livello di container e una collocazione più intelligente dei workloads. Per dare priorità a un'ottimizzazione dei costi Kubernetes automatizzata e sempre attiva, parta da PerfectScale for Kubernetes by DoiT e utilizzi PerfectScale come risorsa secondaria per ulteriori informazioni di prodotto.

Domande frequenti sull'architettura Kubernetes

Cos'è l'architettura Kubernetes?

L'architettura Kubernetes si compone di due elementi principali: il control plane e i worker node. Il control plane gestisce lo stato del cluster e prende le decisioni globali, mentre i worker node eseguono le applicazioni containerizzate. Insieme abilitano un'orchestrazione scalabile e automatizzata di workloads distribuiti.

Quali sono i componenti principali di Kubernetes?

I componenti principali del control plane sono kube-apiserver, etcd, kube-scheduler e kube-controller-manager. I worker node includono kubelet, un container runtime (come containerd o Docker) e componenti di rete come kube-proxy.

Cos'è il control plane di Kubernetes?

Il control plane di Kubernetes è il livello di gestione centralizzato del cluster. Comprende componenti come kube-apiserver, etcd, scheduler e controller manager. Il control plane mantiene lo stato desiderato del cluster, pianifica i workloads e garantisce che il sistema funzioni come previsto.

Cosa sono i nodi Kubernetes?

I nodi Kubernetes sono macchine worker, virtuali o fisiche, che eseguono le applicazioni containerizzate. Ogni nodo include kubelet, un container runtime e componenti di rete. I nodi mettono a disposizione le risorse di calcolo, memoria e storage necessarie per eseguire i workloads.

Cos'è kubelet?

Kubelet è l'agente principale dei nodi in Kubernetes. Comunica con il control plane, garantisce che i container siano in esecuzione come specificato, monitora la salute dei pod e gestisce il ciclo di vita dei container su ciascun nodo.

Cos'è etcd in Kubernetes?

etcd è un key-value store distribuito utilizzato come sistema principale di archiviazione dati di Kubernetes. Mantiene lo stato completo del cluster, inclusi dati di configurazione e metadati, e garantisce coerenza e affidabilità in tutto il cluster.

Cos'è l'HPA in Kubernetes?

HPA è l'acronimo di Horizontal Pod Autoscaler. Regola automaticamente il numero di repliche dei pod in un deployment in base a metriche in tempo reale, come l'utilizzo della CPU o metriche personalizzate dell'applicazione. L'HPA aiuta a mantenere le prestazioni durante le fluttuazioni di traffico.

Come garantisce l'alta disponibilità Kubernetes?

Kubernetes garantisce l'alta disponibilità grazie a più istanze del control plane, failover automatico, container con self-healing, distribuzione dei workloads tra i nodi e supporto per deployment multi-zona o multi-regione.

Come gestisce lo scaling Kubernetes?

Kubernetes supporta lo scaling tramite l'Horizontal Pod Autoscaler (HPA), che regola le repliche dei pod in base alla domanda dei workloads, e il Cluster Autoscaler, che aggiunge o rimuove nodi in base ai requisiti di risorse.

Kubernetes è efficiente in termini di costi?

Kubernetes può migliorare l'efficienza dei costi ottimizzando l'allocazione delle risorse, abilitando l'autoscaling, migliorando il bin-packing e riducendo l'infrastruttura inutilizzata. Gli strumenti di ottimizzazione possono potenziare ulteriormente l'efficienza tramite right-sizing automatizzato e analisi dei workloads.

Qual è la differenza tra Kubernetes e Docker?

Docker è una piattaforma di containerizzazione che impacchetta le applicazioni e le loro dipendenze in container. Kubernetes è una piattaforma di orchestrazione di container che gestisce, scala e automatizza i container nei cluster. Docker crea i container; Kubernetes li gestisce su larga scala.

Conviene utilizzare un servizio Kubernetes gestito?

I servizi gestiti come Amazon EKS, Google Kubernetes Engine (GKE) e Azure Kubernetes Service (AKS) riducono il carico operativo gestendo control plane, aggiornamenti e alta disponibilità. In questo modo i team possono concentrarsi sullo sviluppo applicativo anziché sulla manutenzione dell'infrastruttura.

Da AWS ad Azure, sfruttando gli accelerator Kubernetes e i cloud analytics di DoiT può semplificare architetture Kubernetes complesse e trasformarle in un vantaggio DevOps strategico per la sua azienda.

Scopra oggi PerfectScale for Kubernetes by DoiT e veda come il right-sizing automatizzato e uno scaling più intelligente possano ridurre gli sprechi senza sacrificare le prestazioni. Per ulteriori informazioni di prodotto, visiti PerfectScale.