Kubernetes se ha convertido en una tecnología clave dentro del cloud computing y tiene el potencial de transformar la forma en que tu organización despliega, escala y gestiona aplicaciones en contenedores. Al ser un sistema de orquestación de contenedores de código abierto, simplifica la gestión de sistemas distribuidos y permite que las aplicaciones funcionen de forma confiable en distintos entornos. ¿Cómo puede Kubernetes aportar valor a tu empresa? Al automatizar el despliegue, el escalamiento y la recuperación, ayuda a tu organización a optimizar las operaciones y a poner el foco en la innovación.

Si buscas eficiencia y confiabilidad, Kubernetes ofrece las herramientas para lograrlo. Estas herramientas le dan a los equipos la confianza para gestionar sistemas y mejorar los flujos de trabajo. Con funciones como balanceo de carga, despliegues automatizados y escalamiento, Kubernetes resulta prácticamente indispensable para DevOps, ya que optimiza los recursos y mantiene la resiliencia de tus aplicaciones.

¿Qué es la arquitectura de Kubernetes?

Antes de meternos de lleno en la arquitectura de Kubernetes, conviene entender qué es la contenerización y cómo impacta en el despliegue de aplicaciones. La contenerización es como una versión ligera de la virtualización: empaqueta una aplicación junto con todas sus dependencias (librerías, binarios, archivos de configuración) en un paquete portable llamado contenedor. A diferencia de las máquinas virtuales tradicionales, que requieren un sistema operativo completo por instancia, los contenedores comparten el kernel del sistema operativo del host, lo que los hace más eficientes y rápidos de iniciar.

La contenerización es una alternativa ligera a la virtualización tradicional: al compartir el kernel del SO del host, se reduce la sobrecarga, se acelera el arranque y se consumen menos recursos. Los contenedores brindan entornos consistentes y habilitan la lógica de "build once, run anywhere".

Kubernetes simplifica la gestión de despliegues de contenedores a gran escala con escalabilidad, automatización, autorreparación y un ecosistema sólido, lo que lo posiciona como una de las plataformas líderes de orquestación de contenedores. Ofrece un marco confiable para manejar la complejidad de los entornos de cómputo distribuido con eficiencia y precisión. Por ejemplo, en un entorno tradicional, tu equipo tendría que gestionar manualmente el despliegue y el escalamiento de las aplicaciones: un proceso que consume tiempo, es propenso a errores y se complica a medida que crece la infraestructura.

Al automatizar tareas a través de una sola API, Kubernetes facilita la gestión de contenedores en distintos entornos. Además, sus funciones de autorreparación le permiten recuperarse de fallas por sí solo, sin intervención. Con Kubernetes, tu equipo puede lanzar nuevas versiones de aplicaciones sin contratiempos y mantener todo en funcionamiento con buena capacidad de respuesta, incluso ante picos de tráfico.

Veamos los fundamentos de cómo Kubernetes resuelve algunos de los mayores retos del despliegue de software:

- Escalamiento automático: Kubernetes ajusta los recursos en tiempo real según la demanda de la aplicación, para que tu sistema absorba las fluctuaciones sin intervención manual.

- Autorreparación: si un contenedor falla, Kubernetes detecta el problema y lo reemplaza automáticamente, manteniendo tus aplicaciones en marcha.

- Actualizaciones sin downtime: con despliegues y reversiones fluidos, las actualizaciones se aplican sin interrumpir a los usuarios y se reduce al mínimo el tiempo de inactividad.

- Networking avanzado: Kubernetes gestiona necesidades de red complejas y asegura una comunicación fluida entre múltiples contenedores en sistemas distribuidos.

- Uso inteligente de los recursos: la programación de workloads se optimiza para sacarle el máximo provecho a la infraestructura, lo que te ayuda a controlar costos sin sacrificar el rendimiento.

Kubernetes simplifica la gestión de aplicaciones en contenedores y te permite concentrarte en construir y operar software sin la carga de administrar la infraestructura. Estos son algunos beneficios clave de usarlo:

- Flexibilidad: despliega aplicaciones con facilidad en una variedad de entornos.

- Consistencia: mantén un rendimiento confiable, ya sea on-premises, con proveedores cloud o en entornos híbridos.

- Eficiencia: reduce la carga operativa al automatizar las tareas rutinarias de gestión.

- Escalabilidad: gestiona sistemas distribuidos y complejos sin complicaciones adicionales.

- Optimización de costos: mejora el aprovechamiento de los recursos para gestionar costos con mayor eficacia. Para los equipos que quieren optimizar de forma continua las solicitudes de recursos y la eficiencia de los nodos, PerfectScale for Kubernetes by DoiT ofrece análisis automatizado y recomendaciones accionables a partir del comportamiento real de los workloads.

Cuando llegue el momento de implementar Kubernetes, vas a contar con excelentes opciones de servicios gestionados de los principales proveedores cloud. Amazon Elastic Kubernetes Service (EKS), Google Kubernetes Engine (GKE) y Azure Kubernetes Service (AKS) se encargan del trabajo pesado: gestionan tu control plane, automatizan actualizaciones y mantienen alta disponibilidad.

Cada uno tiene sus fortalezas: EKS se integra de forma nativa con los servicios de AWS, GKE ofrece funciones avanzadas de autoescalado y AKS aporta una sólida integración con Azure DevOps. Al optar por un servicio gestionado, te puedes enfocar en tus aplicaciones mientras el proveedor se ocupa de la complejidad de la infraestructura.

En definitiva, al ofrecer soluciones prácticas que facilitan tu flujo de trabajo y se adaptan a tus necesidades, Kubernetes simplifica la gestión de aplicaciones.

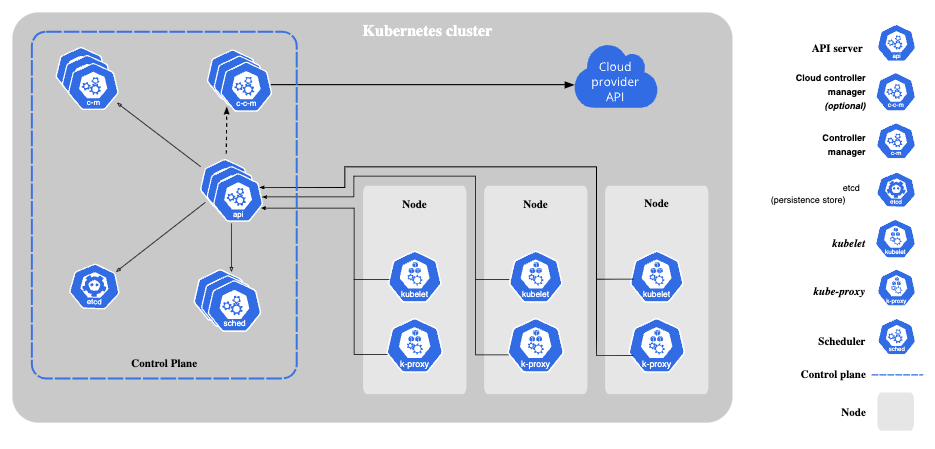

Los componentes centrales de la arquitectura de Kubernetes

( Fuente)

La arquitectura de Kubernetes se construye en torno a dos componentes centrales: el control plane y los worker nodes. Esta estructura está pensada para ofrecer una plataforma confiable, escalable y flexible para gestionar aplicaciones en contenedores. Al separar las responsabilidades entre estos componentes, se logra una orquestación eficiente y se simplifica el escalamiento y la gestión de los workloads.

Arquitectura del control plane de Kubernetes

El control plane supervisa un clúster de Kubernetes, es decir, un conjunto de máquinas trabajadoras (llamadas nodos) que ejecutan las aplicaciones en contenedores. En Kubernetes, el clúster es la columna vertebral de tu despliegue: reúne todas las máquinas y recursos necesarios para ejecutar tus aplicaciones como una unidad cohesiva y manejable.

Los componentes del control plane son los siguientes:

kube-apiserver

kube-apiserver es el componente central de gestión de un clúster de Kubernetes. Se encarga de:

- Brindar acceso a la API de Kubernetes, el principal punto de entrada para interactuar con el clúster.

- Gestionar las tareas administrativas y supervisar el estado del clúster para que todo funcione sin contratiempos.

- Actuar como interfaz principal para las interacciones con el clúster, lo que te permite controlar y gestionar las operaciones de manera efectiva.

etcd

etcd es un almacén de clave-valor distribuido y consistente que cumple un rol crítico en la arquitectura de Kubernetes. Sus principales beneficios son:

- Funciona como mecanismo principal de almacenamiento de datos del clúster y conserva el estado completo del sistema.

- Mantiene los datos de tu clúster seguros y recuperables con respaldos confiables de configuración.

- Aporta estabilidad y confiabilidad mediante una gestión de estado consistente en todo el clúster.

- Reduce el tiempo de inactividad gracias a la alta disponibilidad que habilita su arquitectura distribuida.

kube-scheduler

El kube-scheduler es el responsable de definir la mejor ubicación para los pods dentro de un clúster de Kubernetes. A la hora de programarlos, considera varios factores:

- Requisitos de recursos: garantiza que el pod cuente con la CPU, memoria y demás recursos que necesita.

- Restricciones de hardware/software: asigna el pod a nodos que cumplan necesidades específicas de hardware o software.

- Reglas de afinidad y antiafinidad: respeta las reglas que definen qué pods deben colocarse juntos (o separados).

- Localidad de los datos: ubica los pods cerca de los datos que necesitan para minimizar la latencia.

- Optimización del rendimiento: equilibra los workloads entre los nodos para mejorar el rendimiento del clúster.

kube-controller-manager

El kube-controller-manager supervisa múltiples procesos de control para mantener el estado deseado del clúster. Entre los controladores clave están:

- Node controller: monitorea la salud y el estado de los nodos para asegurar que funcionen correctamente.

- Replication controller: mantiene en ejecución la cantidad correcta de réplicas de pods según lo especificado.

- Endpoints controller: gestiona los endpoints de servicio para una comunicación eficiente.

- Service account & token controllers: manejan la autenticación y administran los tokens de acceso para operaciones seguras.

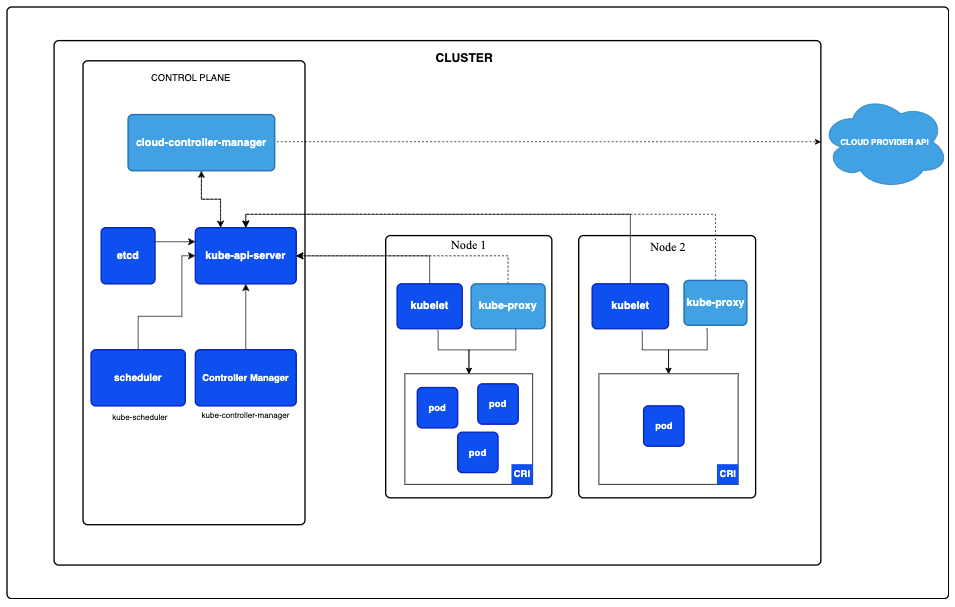

Arquitectura de los nodos de Kubernetes

( Fuente)

Los worker nodes son los motores de cómputo del clúster de Kubernetes y se encargan de ejecutar tus aplicaciones en contenedores. En esencia, estos nodos son los recursos de cómputo que pagas en tu configuración cloud, así que su cantidad y tamaño impactan directamente en tus costos. Cuando se trata de recortar gastos en Kubernetes, las organizaciones suelen enfocarse en aprovechar mejor sus nodos. Ajustar la cantidad, mejorar el bin-packing y elegir los tamaños adecuados puede marcar una gran diferencia.

Para mejorar la eficiencia y reducir la pérdida en clústeres y workloads, PerfectScale for Kubernetes by DoiT ayuda a los equipos a hacer rightsizing continuo de requests y limits, mejorar la colocación de pods e identificar recursos inactivos. Para más detalles del producto, también puedes visitar PerfectScale.

Los worker nodes incluyen los siguientes componentes:

kubelet

El kubelet es el agente principal de los nodos en Kubernetes. Se encarga de varias tareas clave para que tu clúster funcione correctamente:

- Comunicación con el control plane: el kubelet se reporta de forma regular con el control plane para recibir instrucciones e informar el estado del nodo y de los workloads.

- Ejecución correcta de los pods: garantiza que los contenedores de cada pod corran como se espera y actúa cuando algo falla.

- Monitoreo de la salud del nodo y de los pods: hace seguimiento del estado del nodo y sus pods, e informa cualquier problema para mantener la estabilidad y el rendimiento.

- Gestión del ciclo de vida de los contenedores: inicia y detiene contenedores y administra los reinicios durante todo su ciclo de vida.

Container runtime

El container runtime es el responsable de ejecutar los contenedores en un entorno de Kubernetes. Soporta múltiples runtimes (Docker, containerd y CRI-O, entre otros) y gestiona tareas esenciales como:

- Descargar imágenes de contenedores desde los registros

- Ejecutar contenedores de forma eficiente

- Aislar los recursos para un rendimiento estable y seguro

¿Cuáles son los demás componentes de infraestructura de Kubernetes?

Kubernetes incluye varios componentes de infraestructura clave que se complementan con sus funciones centrales. Aquí va un repaso de cada uno para que entiendas qué rol cumplen:

- Pods: son las unidades desplegables más pequeñas de Kubernetes; contienen uno o más contenedores que comparten recursos y se ejecutan juntos como una unidad.

- Deployments: se usan para definir el estado deseado de pods y replica sets, y permiten que tu aplicación funcione sin contratiempos y escale de forma adecuada.

- Services: crean una forma estable de gestionar el networking y la comunicación, para que las distintas partes de tu aplicación interactúen de manera confiable.

- Namespaces: brindan una manera de aislar recursos dentro de tu clúster, lo que facilita organizar y gestionar entornos complejos.

- Persistent volumes: mantienen tus datos a salvo al separar el almacenamiento de los pods individuales, de modo que persistan incluso si los pods se vuelven a crear.

- ConfigMaps y secrets: ayudan a gestionar de forma eficiente la configuración y los datos sensibles, manteniendo a las aplicaciones flexibles y seguras.

Cada uno de estos componentes cumple un rol importante para optimizar la gestión de aplicaciones y permitir un escalamiento fluido dentro de tu clúster. Al trabajar en conjunto, simplifican procesos complejos y facilitan gestionar y hacer crecer tu sistema de manera eficiente.

Interacciones entre componentes

Diagrama simplificado de Kubernetes ( Fuente)

El ecosistema de Kubernetes depende de interacciones bien orquestadas para dar vida a un entorno dinámico de gestión de contenedores. Cuando se hace una solicitud de despliegue, el usuario envía una configuración a través de la API de Kubernetes. El kube-apiserver valida la solicitud y actúa como punto de entrada para las operaciones del clúster. Una vez validada, el scheduler analiza el estado del clúster para encontrar el mejor nodo para el workload, considerando la disponibilidad de recursos, las restricciones de hardware y la distribución de la carga.

A continuación, el kubelet del nodo destino descarga las imágenes de contenedores requeridas desde el registro, mientras que kube-proxy configura el enrutamiento de red para mantener la comunicación dentro del clúster y con servicios externos. El container runtime entonces lanza los contenedores y acerca al sistema al estado deseado.

La verdadera fortaleza de Kubernetes está en su monitoreo continuo y en la autorreparación. Los controladores comparan constantemente el estado actual del clúster con el estado deseado y aplican las correcciones necesarias: reemplazan contenedores fallidos, redistribuyen workloads cuando los nodos fallan y reasignan recursos para mantener el rendimiento y la confiabilidad.

Esta orquestación de componentes permite que los clústeres de Kubernetes se mantengan resilientes, eficientes y receptivos ante demandas cambiantes. Su capacidad de monitorear, reparar y optimizar reduce la carga operativa, eleva la confiabilidad y acelera la innovación.

Buenas prácticas y principios de la arquitectura de Kubernetes

Construir casos de uso sólidos para la arquitectura de Kubernetes implica seguir un conjunto de buenas prácticas fundamentales. Veamos algunos de los principios más importantes para diseñar sistemas confiables, escalables y seguros.

Infraestructura inmutable

- Trata los contenedores como desechables. Diseña tu sistema para que se reemplacen en lugar de modificarse en sitio.

- Evita hacer cambios directamente sobre contenedores en ejecución. En su lugar, usa configuraciones declarativas para garantizar consistencia y repetibilidad.

- Apóyate en imágenes de contenedores versionadas e inmutables para mantener estabilidad y previsibilidad, y darle a tus aplicaciones una base confiable.

Diseño de microservicios

- Estructura tu aplicación como servicios poco acoplados, para que los componentes funcionen de manera independiente.

- Diseña cada servicio para que escale de forma independiente según la demanda, lo que mejora la asignación de recursos.

- Simplifica el mantenimiento y las actualizaciones manteniendo los servicios pequeños y enfocados en tareas específicas.

Gestión de recursos

- Especifica requests y limits claros para los contenedores, con el fin de evitar contención y uso excesivo de recursos.

- Implementa estrategias de escalamiento como el horizontal pod autoscaling para adaptarte a los cambios de los workloads.

- Monitorea el uso de recursos con regularidad para identificar ineficiencias y optimizar el rendimiento del sistema.

Consideraciones de seguridad

- Protege tu clúster con mecanismos de autenticación robustos y limita el acceso a usuarios y sistemas autorizados.

- Usa role-based access control (RBAC) para gestionar permisos y restringir el acceso a lo necesario para cada rol.

- Mantén los componentes de Kubernetes y las imágenes de contenedores al día con los últimos parches para reducir vulnerabilidades.

- Minimiza los privilegios de los contenedores siguiendo el principio de menor privilegio.

Al seguir estas buenas prácticas, podrás crear una arquitectura de Kubernetes eficiente, escalable y segura. Aunque pueden surgir desafíos, estos principios son una base sólida para guiar tus esfuerzos y mantener un sistema confiable.

Alta disponibilidad y escalabilidad

Gráfico de detección de anomalías

Gráfico de detección de anomalías

( Fuente)

Kubernetes está diseñado para ofrecer alta disponibilidad y escalabilidad: dos imprescindibles para las aplicaciones críticas de hoy. La alta disponibilidad se logra con múltiples instancias del control plane, que evitan puntos únicos de falla, y con estrategias de elección de líder que mantienen funcionales los componentes principales aun cuando alguna instancia presenta problemas.

A nivel de los nodos, Kubernetes distribuye los workloads y usa mecanismos de failover para recuperarse de fallas sin afectar el rendimiento de las aplicaciones. Para mayor resiliencia, las organizaciones suelen implementar despliegues multi-zona o multi-región, que suman redundancia geográfica y protegen frente a interrupciones mayores de infraestructura.

La escalabilidad es otra característica clave de Kubernetes. El Horizontal Pod Autoscaler (HPA) ajusta la cantidad de réplicas de pods según métricas en tiempo real, lo que permite a las aplicaciones manejar cambios de tráfico de forma eficiente y optimizar los recursos. De manera similar, el Cluster Autoscaler agrega o quita nodos según la demanda de los workloads, lo que hace el escalamiento más fluido y rentable cuando se ajusta correctamente.

Kubernetes puede dar soporte a operaciones a gran escala y a miles de nodos en un mismo clúster. Utiliza la asignación dinámica de recursos para distribuir los workloads de forma inteligente, reducir cuellos de botella y mejorar la eficiencia general.

Kubernetes también ofrece formas prácticas de mantener los costos bajo control sacándole el máximo provecho a tus recursos. Definir requests y limits para los pods ayuda al scheduler a usar la capacidad con eficiencia, mientras que el dimensionamiento de nodos y el autoescalado equilibran costo y rendimiento. Herramientas como Prometheus entregan métricas de uso que respaldan las decisiones de optimización. Para las organizaciones que buscan traducir esos datos de uso en acciones de optimización continua, PerfectScale for Kubernetes by DoiT ayuda a hacer rightsizing de los workloads, mejorar el bin-packing y reducir la pérdida por recursos inactivos en los clústeres. También puedes explorar la plataforma completa en PerfectScale.

Optimiza tu camino con Kubernetes junto a DoiT

Sin la experiencia adecuada, gestionar entornos de Kubernetes puede ser todo un reto. En DoiT ofrecemos soluciones de optimización y gestión de Kubernetes diseñadas para ayudar a tu organización a enfrentar estos desafíos de forma efectiva. Nuestra plataforma se enfoca en:

- Optimizar el rendimiento del clúster para operaciones más fluidas

- Reducir los costos de infraestructura cloud para mejorar la eficiencia del presupuesto

- Agilizar los procesos de despliegue para ahorrar tiempo y recursos

Implementa configuraciones de buenas prácticas para el éxito a largo plazo con nuestros programas GKE Accelerator y EKS Accelerator.

La plataforma de DoiT facilita la optimización de los despliegues de Kubernetes con insights de escalamiento en tiempo real, funcionalidades de gestión de costos como dashboards de gastos y guía de rightsizing, y mejoras de rendimiento como analítica a nivel de contenedor y una colocación más inteligente de los workloads. Para priorizar la optimización automatizada y permanente de costos en Kubernetes, comienza con PerfectScale for Kubernetes by DoiT y consulta PerfectScale como recurso secundario para más información del producto.

Preguntas frecuentes sobre la arquitectura de Kubernetes

¿Qué es la arquitectura de Kubernetes?

La arquitectura de Kubernetes consta de dos componentes principales: el control plane y los worker nodes. El control plane gestiona el estado del clúster y toma decisiones globales, mientras que los worker nodes ejecutan las aplicaciones en contenedores. Juntos, hacen posible una orquestación escalable y automatizada de workloads distribuidos.

¿Cuáles son los componentes centrales de Kubernetes?

Los componentes centrales del control plane son kube-apiserver, etcd, kube-scheduler y kube-controller-manager. Los worker nodes incluyen kubelet, un container runtime (como containerd o Docker) y componentes de networking como kube-proxy.

¿Qué es el control plane de Kubernetes?

El control plane de Kubernetes es la capa centralizada de gestión de un clúster. Incluye componentes como kube-apiserver, etcd, scheduler y controller manager. El control plane mantiene el estado deseado del clúster, programa los workloads y se asegura de que el sistema funcione como se espera.

¿Qué son los nodos de Kubernetes?

Los nodos de Kubernetes son máquinas trabajadoras (virtuales o físicas) que ejecutan aplicaciones en contenedores. Cada nodo incluye kubelet, un container runtime y componentes de networking. Los nodos brindan los recursos de cómputo, memoria y almacenamiento necesarios para ejecutar los workloads.

¿Qué es kubelet?

Kubelet es el agente principal de los nodos en Kubernetes. Se comunica con el control plane, garantiza que los contenedores se ejecuten según lo especificado, monitorea la salud de los pods y gestiona el ciclo de vida de los contenedores en cada nodo.

¿Qué es etcd en Kubernetes?

etcd es un almacén de clave-valor distribuido que se usa como sistema principal de almacenamiento de datos de Kubernetes. Mantiene el estado completo del clúster, incluidos los datos de configuración y los metadatos. etcd asegura consistencia y confiabilidad en todo el clúster.

¿Qué es HPA en Kubernetes?

HPA significa Horizontal Pod Autoscaler. Ajusta automáticamente la cantidad de réplicas de pods en un deployment con base en métricas en tiempo real, como el uso de CPU o métricas personalizadas de la aplicación. HPA ayuda a mantener el rendimiento durante las fluctuaciones de tráfico.

¿Cómo asegura Kubernetes la alta disponibilidad?

Kubernetes garantiza alta disponibilidad mediante múltiples instancias del control plane, failover automatizado, contenedores con autorreparación, distribución de workloads entre nodos y soporte para despliegues multi-zona o multi-región.

¿Cómo maneja Kubernetes el escalamiento?

Kubernetes soporta el escalamiento mediante el Horizontal Pod Autoscaler (HPA), que ajusta las réplicas de pods según la demanda del workload, y el Cluster Autoscaler, que agrega o elimina nodos según los requisitos de recursos.

¿Es Kubernetes eficiente en costos?

Kubernetes puede mejorar la eficiencia de costos al optimizar la asignación de recursos, habilitar el autoescalado, mejorar el bin-packing y reducir la infraestructura inactiva. Las herramientas de optimización pueden potenciar aún más la eficiencia mediante rightsizing automatizado y análisis de workloads.

¿Cuál es la diferencia entre Kubernetes y Docker?

Docker es una plataforma de contenerización que empaqueta aplicaciones y sus dependencias en contenedores. Kubernetes es una plataforma de orquestación de contenedores que gestiona, escala y automatiza contenedores en clústeres. Docker crea contenedores; Kubernetes los gestiona a escala.

¿Conviene usar un servicio gestionado de Kubernetes?

Servicios gestionados como Amazon EKS, Google Kubernetes Engine (GKE) y Azure Kubernetes Service (AKS) reducen la carga operativa al gestionar el control plane, las actualizaciones y la alta disponibilidad. Esto le permite a los equipos enfocarse en el desarrollo de aplicaciones y no en el mantenimiento de la infraestructura.

Desde AWS hasta Azure, con los aceleradores de Kubernetes y el cloud analytics de DoiT puedes simplificar arquitecturas complejas de Kubernetes y convertirlas en una ventaja estratégica de DevOps para tu negocio.

Descubre PerfectScale for Kubernetes by DoiT hoy mismo y comprueba cómo el rightsizing automatizado y un escalamiento más inteligente reducen la pérdida sin sacrificar el rendimiento. Para más información del producto, visita PerfectScale.