O Kubernetes virou peça central em cloud computing e tem potencial para revolucionar a forma como sua organização implanta, escala e gerencia aplicações em containers. Por ser um sistema open-source de orquestração de containers, ele descomplica a gestão de sistemas distribuídos e faz suas aplicações rodarem com confiabilidade em qualquer ambiente. E como o Kubernetes pode trabalhar a favor da sua empresa? Automatizando implantação, escalonamento e recuperação, ele ajuda sua organização a enxugar operações e direcionar energia para a inovação.

Se a sua organização busca eficiência e confiabilidade, o Kubernetes entrega as ferramentas certas para chegar lá. Com elas, os times gerenciam sistemas com segurança e aprimoram seus fluxos de trabalho. Recursos como balanceamento de carga, rollouts automatizados e escalonamento tornam o Kubernetes praticamente indispensável para DevOps. Ele otimiza recursos e mantém suas aplicações resilientes.

O que é a arquitetura do Kubernetes?

Antes de mergulhar na arquitetura do Kubernetes, vale entender o que é containerização e por que ela mudou a forma de implantar aplicações. A containerização funciona como uma versão mais leve da virtualização. Ela empacota uma aplicação junto com todas as suas dependências (bibliotecas, binários e arquivos de configuração) em um pacote portátil chamado container. Diferente das máquinas virtuais tradicionais, que precisam de um sistema operacional completo para cada instância, os containers compartilham o kernel do SO do host, o que os torna mais eficientes e mais rápidos para iniciar.

A containerização é uma alternativa leve à virtualização tradicional: ao compartilhar o kernel do SO host, ela reduz overhead, acelera a inicialização e usa menos recursos. Os containers oferecem ambientes consistentes e viabilizam o famoso "build once, run anywhere" (construa uma vez, execute em qualquer lugar).

O Kubernetes simplifica a gestão de implantações de containers em larga escala com recursos como escalabilidade, automação, autorrecuperação e um ecossistema robusto — tudo isso o consolida como uma das principais plataformas de orquestração de containers. Ele oferece uma estrutura confiável para lidar com a complexidade de ambientes distribuídos, com eficiência e precisão. Em um ambiente tradicional, por exemplo, sua equipe precisaria gerenciar manualmente a implantação e o escalonamento das aplicações — um processo demorado, sujeito a erros e difícil de manter à medida que a infraestrutura cresce.

Ao automatizar tarefas com uma única API, o Kubernetes facilita a vida do time e permite gerenciar containers em diferentes ambientes. Ele também conta com autorrecuperação, então se recompõe sozinho diante de falhas, sem nenhuma intervenção. Com o Kubernetes, sua equipe lança novas versões de aplicações sem sustos, mantendo tudo no ar e responsivo até nos picos de tráfego.

Veja, em linhas gerais, como o Kubernetes resolve alguns dos maiores desafios da implantação de software:

- Escalonamento automático: o Kubernetes ajusta os recursos em tempo real conforme a demanda da aplicação, garantindo que seu sistema absorva flutuações sem intervenção manual.

- Autorrecuperação: se um container falha, o Kubernetes detecta o problema e o substitui automaticamente, mantendo as aplicações no ar.

- Atualizações sem downtime: com rollouts e rollbacks fluidos, dá para implementar atualizações sem afetar os usuários, minimizando o tempo de inatividade.

- Networking avançado: o Kubernetes dá conta de necessidades complexas de rede, garantindo comunicação fluida entre vários containers em sistemas distribuídos.

- Uso inteligente de recursos: o agendamento de workloads é otimizado para tirar o máximo da infraestrutura, ajudando você a controlar custos sem abrir mão da performance.

O Kubernetes simplifica os desafios de gerenciar aplicações em containers e libera o time para focar em construir e rodar software, sem o peso de administrar a infraestrutura. Veja alguns dos principais benefícios:

- Flexibilidade: implante aplicações com facilidade em diversos ambientes.

- Consistência: mantenha performance confiável on-premises, em provedores de nuvem ou em ambientes híbridos.

- Eficiência: reduza o overhead operacional automatizando tarefas rotineiras de gerenciamento.

- Escalabilidade: gerencie sistemas distribuídos complexos sem dor de cabeça extra.

- Otimização de custos: melhore o uso de recursos para gerenciar custos com mais eficácia. Para times que querem otimizar continuamente as solicitações de recursos e a eficiência dos nodes, o PerfectScale for Kubernetes by DoiT oferece análises automatizadas e recomendações práticas baseadas no comportamento real das workloads.

Quando chegar a hora de implementar o Kubernetes, você pode contar com excelentes serviços gerenciados dos principais provedores de nuvem. O Amazon Elastic Kubernetes Service (EKS), o Google Kubernetes Engine (GKE) e o Azure Kubernetes Service (AKS) tiram o trabalho pesado das suas costas, cuidando de tarefas complexas como gerenciar o control plane, automatizar atualizações e manter alta disponibilidade.

Cada um tem seus pontos fortes: o EKS se integra perfeitamente aos serviços da AWS, o GKE traz recursos avançados de autoscaling e o AKS conta com forte integração com o Azure DevOps. Ao optar por um serviço gerenciado, você foca nas suas aplicações enquanto o provedor cuida das complexidades da infraestrutura.

No fim das contas, com soluções práticas que se encaixam nas suas necessidades e facilitam o dia a dia, o Kubernetes simplifica o desafio de gerenciar aplicações.

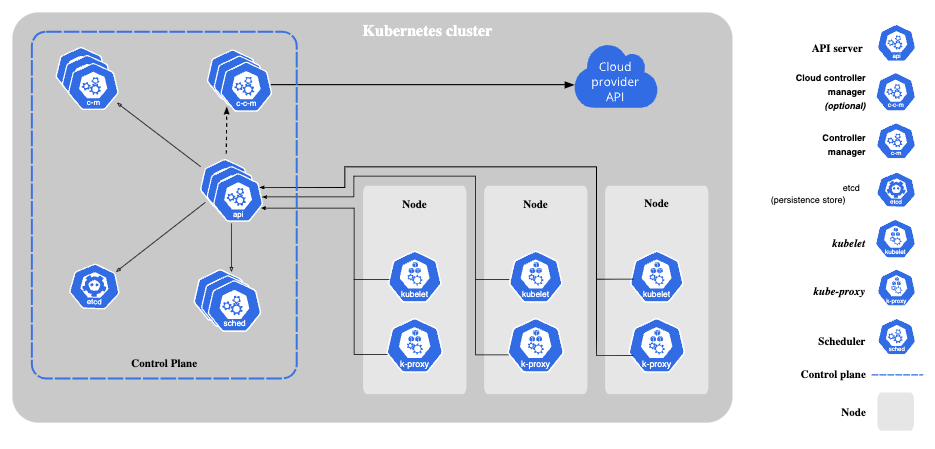

Os componentes principais da arquitetura do Kubernetes

( Fonte)

A arquitetura do Kubernetes se apoia em dois componentes principais: o control plane e os worker nodes. Essa estrutura foi pensada para entregar uma plataforma confiável, escalável e flexível para gerenciar aplicações em containers. Ao dividir as responsabilidades entre esses componentes, o Kubernetes permite uma orquestração eficiente e descomplica o escalonamento e o gerenciamento de workloads.

Arquitetura do control plane do Kubernetes

O control plane comanda um cluster Kubernetes — um conjunto de máquinas worker (chamadas de nodes) que executam aplicações em containers. No Kubernetes, o cluster é a espinha dorsal da implantação: reúne todas as máquinas e recursos necessários para rodar suas aplicações como uma unidade coesa e gerenciável.

Os componentes do control plane incluem:

kube-apiserver

O kube-apiserver é o componente central de gerenciamento de um cluster Kubernetes. Ele atua:

- Dando acesso à API do Kubernetes, que é o ponto principal de entrada para interagir com o cluster.

- Gerenciando tarefas administrativas e supervisionando o estado do cluster para manter tudo funcionando bem.

- Como interface principal de interação com o cluster, permitindo controlar e gerenciar operações com eficácia.

etcd

O etcd é um armazenamento de chave-valor distribuído e consistente que tem papel crítico na arquitetura do Kubernetes. Seus principais benefícios incluem:

- Funcionar como o mecanismo principal de armazenamento de dados do cluster, mantendo o estado completo do sistema.

- Manter os dados do seu cluster seguros e recuperáveis com backups de configuração confiáveis.

- Oferecer estabilidade e confiabilidade com gerenciamento de estado consistente em todo o cluster.

- Reduzir o downtime graças à alta disponibilidade viabilizada pela arquitetura distribuída.

kube-scheduler

O kube-scheduler define a melhor alocação para os pods dentro de um cluster Kubernetes. Ao agendar pods, ele considera vários fatores:

- Requisitos de recursos: garante que o pod tenha CPU, memória e demais recursos de que precisa.

- Restrições de hardware/software: aloca o pod em nodes que atendam a necessidades específicas de hardware ou software.

- Regras de afinidade e antiafinidade: respeita regras que definem quais pods devem ficar juntos (ou separados).

- Localidade dos dados: posiciona pods perto dos dados que precisam acessar para reduzir a latência.

- Otimização de performance: equilibra workloads entre os nodes para melhorar o desempenho do cluster.

kube-controller-manager

O kube-controller-manager coordena vários processos de controladores para manter o estado desejado do cluster. Os principais são:

- Node controller: monitora a saúde e o status dos nodes para garantir que estejam funcionando corretamente.

- Replication controller: mantém em execução o número correto de réplicas de pods, conforme especificado.

- Endpoints controller: gerencia o preenchimento dos endpoints de serviço para uma comunicação eficiente.

- Service account & token controllers: cuidam da autenticação e do gerenciamento de tokens de acesso para operações seguras.

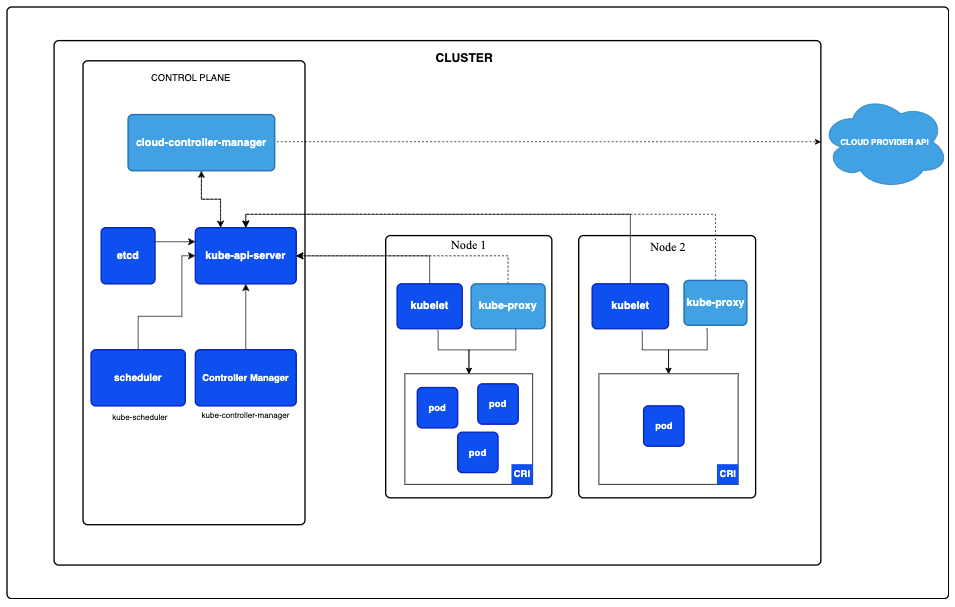

Arquitetura dos nodes do Kubernetes

( Fonte)

Os worker nodes são os motores computacionais do cluster Kubernetes e rodam suas aplicações em containers. Na prática, esses nodes são os recursos de computação pelos quais você paga na nuvem — então a quantidade e o tamanho deles têm impacto direto no seu custo. Quando o assunto é cortar despesas com Kubernetes, as organizações costumam focar em aproveitar melhor os nodes. Ajustar a quantidade, melhorar o bin-packing e escolher os tamanhos certos faz toda a diferença.

Para ganhar eficiência e reduzir desperdício em clusters e workloads, o PerfectScale for Kubernetes by DoiT ajuda os times a aplicar right-sizing continuamente em requisições e limites, melhorar o posicionamento de pods e identificar recursos ociosos. Para mais detalhes sobre o produto, acesse também o PerfectScale.

Os worker nodes incluem os seguintes componentes:

kubelet

O kubelet é o principal agente de node no Kubernetes. Ele é responsável por várias tarefas-chave que mantêm seu cluster funcionando bem:

- Comunicação com o control plane: o kubelet se reporta regularmente ao control plane para receber instruções e informar o status do node e das workloads.

- Execução correta dos pods: garante que os containers de cada pod estejam rodando como esperado e age quando algo dá errado.

- Monitoramento da saúde do node e dos pods: acompanha o estado do node e dos seus pods, reportando problemas para preservar estabilidade e performance.

- Gerenciamento do ciclo de vida dos containers: inicia, para e gerencia reinícios dos containers ao longo de todo o ciclo de vida.

Container runtime

O container runtime é responsável por executar os containers em um ambiente Kubernetes. Ele suporta vários runtimes (incluindo Docker, containerd e CRI-O) e cuida de tarefas essenciais como:

- Baixar imagens de containers a partir de registries

- Executar containers de forma eficiente

- Isolar recursos para uma performance estável e segura

Quais são os outros componentes da infraestrutura do Kubernetes?

O Kubernetes traz vários componentes-chave de infraestrutura que trabalham junto com a sua funcionalidade central. Veja um resumo de cada um para entender seus papéis:

- Pods: as menores unidades implantáveis no Kubernetes, os pods reúnem um ou mais containers que compartilham recursos e rodam juntos como uma única unidade.

- Deployments: definem o estado desejado para pods e replica sets e fazem sua aplicação rodar sem sobressaltos, escalando conforme a necessidade.

- Services: criam uma forma estável de gerenciar networking e comunicação para que diferentes partes da sua aplicação interajam de maneira confiável.

- Namespaces: isolam recursos dentro do cluster, facilitando organizar e gerenciar ambientes complexos.

- Persistent volumes: mantêm seus dados seguros separando o armazenamento dos pods individuais, de modo que persistam mesmo quando os pods são recriados.

- ConfigMaps e secrets: ajudam a gerenciar configurações e dados sensíveis com eficiência, mantendo as aplicações flexíveis e seguras.

Cada um desses componentes tem um papel importante para simplificar o gerenciamento de aplicações e viabilizar um escalonamento fluido dentro do seu cluster. Trabalhando em conjunto, eles descomplicam processos complexos e tornam mais fácil gerenciar e fazer seu sistema crescer com eficiência.

Interações entre os componentes

Diagrama simplificado do Kubernetes ( Fonte)

O ecossistema Kubernetes depende de interações bem orquestradas para criar um ambiente dinâmico de gerenciamento de containers. Quando uma solicitação de implantação é feita, o usuário envia uma configuração via API do Kubernetes. O kube-apiserver valida a solicitação, atuando como ponto de entrada para as operações do cluster. Depois da validação, o scheduler analisa o estado do cluster para encontrar o melhor node para a workload, levando em conta disponibilidade de recursos, restrições de hardware e distribuição de workloads.

Na sequência, o kubelet do node de destino baixa as imagens de container necessárias do registry, enquanto o kube-proxy configura o roteamento de rede para manter a comunicação dentro do cluster e com serviços externos. O container runtime, então, sobe os containers e aproxima o sistema do estado desejado.

A verdadeira força do Kubernetes está no monitoramento contínuo e na autorrecuperação. Os controladores comparam o tempo todo o estado atual do cluster com o estado desejado, fazendo correções conforme necessário — substituindo containers que falharam, redistribuindo workloads quando nodes caem e realocando recursos para preservar performance e confiabilidade.

Essa orquestração entre componentes mantém os clusters Kubernetes resilientes, eficientes e prontos para responder a demandas em constante mudança. A capacidade de monitorar, recuperar e otimizar reduz o overhead operacional, aumenta a confiabilidade e acelera a inovação.

Boas práticas e princípios da arquitetura do Kubernetes

Construir bons casos de uso para a arquitetura do Kubernetes passa por seguir um conjunto de boas práticas fundamentais. Veja alguns dos princípios mais importantes para projetar sistemas confiáveis, escaláveis e seguros.

Infraestrutura imutável

- Trate os containers como descartáveis. Projete seu sistema para que os containers sejam substituídos em vez de modificados no local.

- Evite alterações diretas em containers em execução. Em vez disso, use configurações declarativas para garantir consistência e repetibilidade.

- Aposte em imagens de containers versionadas e imutáveis para manter estabilidade e previsibilidade — uma base confiável para suas aplicações.

Design de microsserviços

- Estruture sua aplicação como serviços fracamente acoplados, para que os componentes funcionem de forma independente.

- Projete cada serviço para escalar de forma independente conforme a demanda, permitindo melhor alocação de recursos.

- Simplifique manutenção e atualizações mantendo os serviços pequenos e focados em tarefas específicas.

Gerenciamento de recursos

- Defina requisições e limites de recursos claros para os containers e evite contenção e uso excessivo.

- Implemente estratégias de escalonamento, como horizontal pod autoscaling, para se adaptar às mudanças de workload.

- Monitore o uso de recursos com regularidade para identificar ineficiências e otimizar a performance do sistema.

Considerações de segurança

- Proteja seu cluster com mecanismos fortes de autenticação e restrinja o acesso a usuários e sistemas autorizados.

- Use o controle de acesso baseado em papéis (RBAC) para gerenciar permissões, liberando apenas o necessário para cada papel.

- Mantenha os componentes do Kubernetes e as imagens de containers atualizados com os patches mais recentes para reduzir vulnerabilidades.

- Reduza os privilégios dos containers seguindo o princípio do menor privilégio.

Seguindo essas boas práticas, você cria uma arquitetura Kubernetes eficiente, escalável e segura. Desafios vão aparecer, mas esses princípios são uma base sólida para guiar seus esforços e manter um sistema confiável.

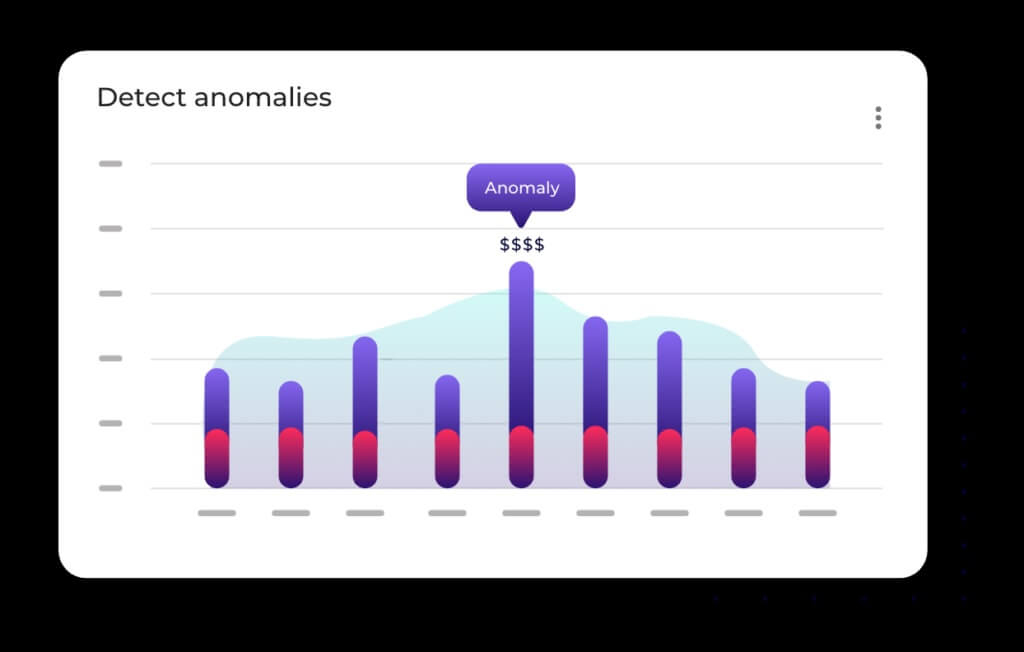

Alta disponibilidade e escalabilidade

Gráfico de detecção de anomalias

Gráfico de detecção de anomalias

( Fonte)

O Kubernetes foi feito para entregar alta disponibilidade e escalabilidade — duas características indispensáveis nas aplicações de missão crítica de hoje. A alta disponibilidade vem de múltiplas instâncias do control plane, que evitam pontos únicos de falha, somadas a estratégias de eleição de líder que mantêm os componentes principais funcionais mesmo quando uma instância apresenta problemas.

No nível do node, o Kubernetes distribui workloads entre os nodes e usa mecanismos de failover para se recuperar de falhas sem afetar a performance da aplicação. Para reforçar a resiliência, é comum implementar implantações multizona ou multirregião, adicionando redundância geográfica e protegendo contra falhas maiores de infraestrutura.

Escalabilidade é outra marca registrada do Kubernetes. O Horizontal Pod Autoscaler (HPA) ajusta o número de réplicas de pods com base em métricas em tempo real, ajudando as aplicações a absorver mudanças de tráfego com eficiência e otimizar recursos. Da mesma forma, o Cluster Autoscaler adiciona ou remove nodes conforme as demandas das workloads, deixando o escalonamento mais fluido e econômico quando bem ajustado.

O Kubernetes dá conta de operações em larga escala e suporta milhares de nodes em um único cluster. Ele usa alocação dinâmica de recursos para distribuir workloads de forma inteligente, reduzir gargalos e melhorar a eficiência geral.

O Kubernetes também oferece formas práticas de manter os custos sob controle, aproveitando ao máximo seus recursos. Definir requisições e limites de recursos para os pods ajuda o scheduler a usar a capacidade com eficiência; já o dimensionamento de nodes e o autoscaling equilibram custo e performance. Ferramentas como o Prometheus fornecem métricas de uso que orientam decisões de otimização. Para organizações que querem transformar dados de uso em ações contínuas de otimização, o PerfectScale for Kubernetes by DoiT aplica right-sizing nas workloads, melhora o bin-packing e corta o desperdício de recursos ociosos em clusters. Você também pode conhecer a plataforma completa em PerfectScale.

Otimize sua jornada com Kubernetes ao lado da DoiT

Sem a expertise certa, gerenciar ambientes Kubernetes pode virar uma dor de cabeça. Na DoiT, oferecemos soluções de otimização e gerenciamento de Kubernetes pensadas para ajudar sua organização a vencer esses desafios. Nossa plataforma foca em:

- Otimizar a performance do cluster para operações mais fluidas

- Reduzir custos de infraestrutura na nuvem para melhorar a eficiência orçamentária

- Simplificar processos de implantação para economizar tempo e recursos

Implemente configurações alinhadas às melhores práticas e garanta sucesso de longo prazo com nossos programas GKE Accelerator e EKS Accelerator.

A plataforma da DoiT facilita a otimização das implantações de Kubernetes com insights de escalonamento em tempo real, recursos de gestão de custos como dashboards de despesas e orientação de right-sizing, além de melhorias de performance como analytics em nível de container e posicionamento mais inteligente de workloads. Para priorizar a otimização de custos automatizada e contínua no Kubernetes, comece pelo PerfectScale for Kubernetes by DoiT e use o PerfectScale como recurso secundário para informações adicionais sobre o produto.

Perguntas frequentes sobre a arquitetura do Kubernetes

O que é a arquitetura do Kubernetes?

A arquitetura do Kubernetes é formada por dois componentes principais: o control plane e os worker nodes. O control plane gerencia o estado do cluster e toma decisões globais, enquanto os worker nodes executam aplicações em containers. Juntos, eles viabilizam a orquestração escalável e automatizada de workloads distribuídas.

Quais são os componentes principais do Kubernetes?

Os componentes principais do control plane são o kube-apiserver, etcd, kube-scheduler e kube-controller-manager. Os worker nodes incluem o kubelet, um container runtime (como containerd ou Docker) e componentes de rede, como o kube-proxy.

O que é o control plane do Kubernetes?

O control plane do Kubernetes é a camada centralizada de gerenciamento de um cluster. Reúne componentes como kube-apiserver, etcd, scheduler e controller manager. Ele mantém o estado desejado do cluster, agenda workloads e garante que o sistema funcione conforme planejado.

O que são os nodes do Kubernetes?

Os nodes do Kubernetes são máquinas worker — virtuais ou físicas — que executam aplicações em containers. Cada node tem kubelet, um container runtime e componentes de rede. Os nodes fornecem os recursos de computação, memória e armazenamento necessários para rodar as workloads.

O que é o kubelet?

O kubelet é o principal agente de node no Kubernetes. Ele se comunica com o control plane, garante que os containers estejam rodando conforme especificado, monitora a saúde dos pods e gerencia o ciclo de vida dos containers em cada node.

O que é o etcd no Kubernetes?

O etcd é um armazenamento distribuído de chave-valor usado como sistema principal de armazenamento de dados do Kubernetes. Ele mantém o estado completo do cluster, incluindo dados de configuração e metadados, e garante consistência e confiabilidade em todo o cluster.

O que é o HPA no Kubernetes?

HPA é a sigla para Horizontal Pod Autoscaler. Ele ajusta automaticamente o número de réplicas de pods em um deployment com base em métricas em tempo real, como utilização de CPU ou métricas customizadas da aplicação. O HPA ajuda a manter a performance durante flutuações de tráfego.

Como o Kubernetes garante alta disponibilidade?

O Kubernetes garante alta disponibilidade por meio de múltiplas instâncias do control plane, failover automatizado, containers com autorrecuperação, distribuição de workloads entre nodes e suporte a implantações multizona ou multirregião.

Como o Kubernetes lida com escalonamento?

O Kubernetes oferece suporte ao escalonamento por meio do Horizontal Pod Autoscaler (HPA), que ajusta réplicas de pods conforme a demanda das workloads, e do Cluster Autoscaler, que adiciona ou remove nodes conforme os requisitos de recursos.

O Kubernetes é eficiente em custos?

O Kubernetes pode melhorar a eficiência de custos otimizando a alocação de recursos, viabilizando autoscaling, melhorando o bin-packing e reduzindo infraestrutura ociosa. Ferramentas de otimização ampliam ainda mais essa eficiência por meio de right-sizing automatizado e análise de workloads.

Qual é a diferença entre Kubernetes e Docker?

O Docker é uma plataforma de containerização que empacota aplicações e suas dependências em containers. O Kubernetes é uma plataforma de orquestração de containers que gerencia, escala e automatiza containers em clusters. Em resumo: o Docker cria os containers; o Kubernetes os gerencia em escala.

Devo usar um serviço gerenciado de Kubernetes?

Serviços gerenciados como Amazon EKS, Google Kubernetes Engine (GKE) e Azure Kubernetes Service (AKS) reduzem o overhead operacional ao cuidar do control plane, das atualizações e da alta disponibilidade. Assim, os times podem focar no desenvolvimento das aplicações em vez de gastar energia com a manutenção da infraestrutura.

Da AWS ao Azure, ao usar os aceleradores de Kubernetes e os recursos de cloud analytics da DoiT, você simplifica arquiteturas complexas de Kubernetes e as transforma em uma vantagem estratégica de DevOps para o seu negócio.

Conheça hoje mesmo o PerfectScale for Kubernetes by DoiT e veja como o right-sizing automatizado e o escalonamento mais inteligente reduzem o desperdício sem comprometer a performance. Para mais informações sobre o produto, visite o PerfectScale.