Kubernetes s'est imposé comme la plateforme de référence pour l'orchestration de conteneurs : déployer, faire évoluer et gérer des applications conteneurisées dans le cloud n'a jamais été aussi simple. Mais cette puissance s'accompagne d'une complexité, et souvent de coûts imprévus liés à des nœuds sous-utilisés, à un autoscaling vertical mal réglé, à des paramètres requests/limits inadaptés ou à des workloads inactifs qui tournent indéfiniment. L'observabilité des coûts Kubernetes reste fragmentée et la visibilité financière n'est généralement pas native d'un cluster ou d'un namespace à l'autre sans outillage complémentaire.

Sans stratégie d'optimisation claire, les dépenses Kubernetes peuvent vite déraper. Les coûts élevés tiennent généralement à des problèmes architecturaux et opérationnels précis : pools de nœuds surdimensionnés par rapport aux besoins réels des workloads, bin-packing inefficace des pods qui laisse de la capacité de calcul inutilisée, absence de mécanismes d'autoscaling (Horizontal Pod Autoscaler, Vertical Pod Autoscaler ou Cluster Autoscaler) pour ajuster dynamiquement les ressources selon l'usage.

D'où l'intérêt d'une démarche proactive : examiner de près les dépenses Kubernetes permet de maîtriser les coûts et de maximiser le ROI. Cet article rassemble des conseils et outils concrets pour aider les équipes à reprendre la main sur leurs workloads et leurs dépenses Kubernetes, sans compromettre la continuité des opérations.

Réponses rapides : optimisation des coûts Kubernetes

**Qu'est-ce que l'optimisation des coûts Kubernetes ?**Il s'agit de réduire les dépenses des clusters en améliorant l'efficacité des ressources, en ajustant requests et limits, en faisant évoluer dynamiquement nœuds et pods, et en éliminant l'infrastructure inactive.**Quelles sont les causes des coûts Kubernetes élevés ?**Les plus fréquentes : pools de nœuds surdimensionnés, requests pod gonflés, bin-packing déficient, stockage inutilisé, clusters inactifs et frais d'egress réseau imprévus.**Comment réduire rapidement les coûts Kubernetes ?**Commencez par corriger les requests/limits, nettoyer les ressources inactives, planifier l'arrêt des clusters non-prod, activer l'autoscaling et exploiter du compute à tarif réduit (spot/preemptible) pour les workloads résilients.

Pourquoi l'optimisation des coûts Kubernetes est-elle indispensable ?

Sans gestion adéquate, les environnements Kubernetes peuvent devenir d'importants centres de coûts. Plusieurs facteurs alimentent ces dépenses :

L'inefficacité des ressources de calcul figure souvent en tête des préoccupations. Faute de right-sizing, beaucoup d'organisations surprovisionnent CPU et mémoire pour éviter les problèmes de performance, ce qui se traduit par de faibles taux d'utilisation et un gaspillage de ressources cloud. Les études montrent que plus de 65 % des workloads Kubernetes utilisent moins de la moitié du CPU et de la mémoire qu'ils demandent. La cause principale : des resource requests surdimensionnés par rapport aux limites et à l'usage réel. Les schedulers Kubernetes s'appuient sur les requests, et non sur l'usage réel, pour décider du placement des pods. Quand les requests sont gonflés, le bin-packing devient inefficace et le nombre de nœuds explose inutilement.

Les coûts de stockage peuvent grimper rapidement dans les environnements cloud Kubernetes. Les volumes persistants (en particulier les classes de stockage premium) prennent de l'ampleur à mesure que les données applicatives grossissent. S'y ajoutent les PVC conservés après suppression des pods et une rétention excessive des snapshots et sauvegardes. Optimiser le stockage suppose souvent une coordination entre équipes infrastructure et applicatives, surtout pour les workloads stateful, où les choix de gestion des données influent à la fois sur la performance et sur le budget.

Les frais réseau constituent un autre poste de coût, en particulier dans les déploiements multi-régions ou hybrides. Le transfert de données entre zones, régions et services externes peut générer des charges significatives, souvent sous-estimées au moment de la conception de l'architecture.

Les ressources inactives représentent également une source majeure de gaspillage. Clusters de développement et de test qui tournent en dehors des heures ouvrées, volumes persistants oubliés, load balancers inutilisés : autant d'éléments qui alourdissent inutilement la facture. Sans gouvernance, ces ressources s'accumulent et font grimper la dépense Kubernetes globale.

Stratégies clés pour réduire vos coûts Kubernetes

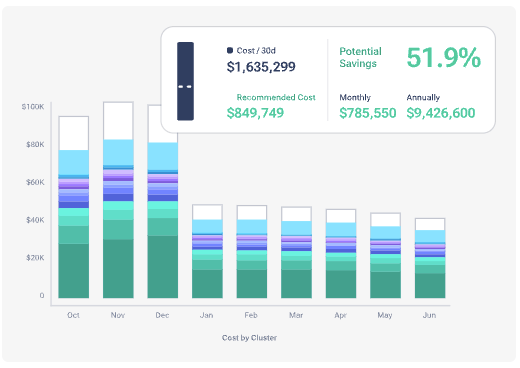

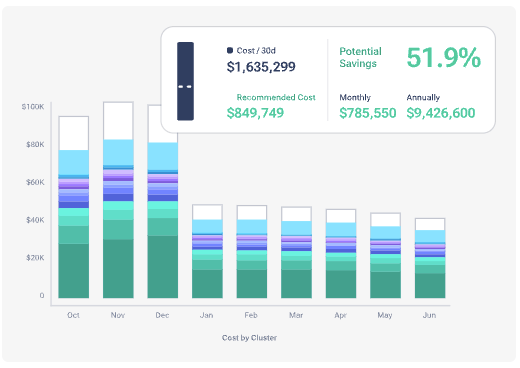

Graphique de cluster de coûts montrant les économies potentielles

Graphique de cluster de coûts montrant les économies potentielles

Comprendre les interactions entre ces facteurs est essentiel pour bâtir une architecture Kubernetes rentable et améliorer son efficacité financière. Voici les stratégies à déployer pour faire baisser vos coûts Kubernetes.

1. Right-sizer les ressources des nœuds

Le right-sizing compte parmi les leviers les plus efficaces pour réduire les dépenses Kubernetes. Le scheduling Kubernetes s'appuie sur les ressources demandées : des requests gonflés imposent donc un nombre de nœuds plus élevé, même quand l'usage réel reste faible.

Commencez par analyser l'utilisation historique sur l'ensemble de vos clusters. Repérez les pods qui consomment systématiquement bien moins de CPU ou de mémoire qu'ils n'en demandent. Bien souvent, il est possible de réduire les requests sans impact sur la performance, ce qui permet de faire tourner davantage de workloads sur les nœuds existants.

Définissez des resource quotas au niveau du namespace pour éviter les dérives et fixer des limites claires aux équipes. Les quotas aident aussi à contenir les pics de coûts imprévus qui forcent un scaling inutile.

Imposez des politiques sur les requests/limits. Mettez en place des outils d'application des règles (comme Gatekeeper) pour garantir que chaque workload spécifie les deux. Les requests déterminent le scheduling et influent sur les coûts de calcul, tandis que les limits préviennent les phénomènes de noisy neighbor et l'instabilité des workloads. Sans requests correctement définis, Kubernetes ne peut pas réaliser un bin-packing efficace, ce qui mène à des nœuds sous-utilisés et à des dépenses gaspillées.

Envisagez d'utiliser le Vertical Pod Autoscaler (VPA) en mode recommandation dans un premier temps. Vous obtenez ainsi des préconisations sûres, fondées sur les schémas d'usage, avant de passer à l'automatisation. Combinez le VPA au Horizontal Pod Autoscaler (HPA) lorsque c'est pertinent, en gardant à l'esprit qu'ils peuvent entrer en conflit lorsqu'ils ciblent les mêmes signaux CPU/mémoire — un réglage minutieux s'impose.

2. Recourir aux instances Spot

Les instances Spot (ou les VM preemptible sur Google Cloud) permettent de réduire fortement les coûts de calcul en exploitant la capacité disponible. Elles peuvent être récupérées avec un préavis très court : les workloads doivent donc tolérer les interruptions.

Utilisez les pod disruption budgets, les taints/tolerations et les règles d'affinité de nœud pour faire tourner en toute sécurité les workloads éligibles sur des nœuds Spot. Privilégiez les workloads stateless et tolérants aux pannes, comme le traitement par lots et les services scalables horizontalement.

En production, une approche hybride (Spot combiné à une capacité de base on-demand) permet d'équilibrer économies et fiabilité.

3. Déployer une gouvernance automatisée

La gouvernance automatisée assure un contrôle continu des coûts grâce au policy-as-code et à des contrôles à l'exécution sur l'ensemble du cycle de vie Kubernetes.

- Exiger des requests et limits pour tous les workloads

- Imposer l'utilisation de classes de stockage adaptées aux besoins des workloads

- Rendre obligatoires les labels pour l'allocation des coûts et l'identification des propriétaires

- Arrêter automatiquement ou réduire la taille des environnements de développement en dehors des heures ouvrées

Des outils comme CloudFlow de DoiT aident à appliquer ces politiques, à empêcher la création de ressources non conformes et à maintenir la discipline budgétaire entre les équipes.

4. Mettre en place un monitoring granulaire

L'optimisation des coûts exige une visibilité fine sur les schémas de consommation. Un monitoring efficace inclut généralement :

- Des métriques d'utilisation au niveau du pod

- Des statistiques d'efficacité des nœuds

- Une allocation des coûts par namespace et par label

- Des tendances historiques et la détection d'anomalies

Cette granularité permet d'identifier les opportunités d'optimisation et d'attribuer les coûts aux équipes, projets ou applications. Beaucoup d'environnements pâtissent d'un labeling incomplet, ce qui dégrade la précision. Les outils de facturation cloud natifs manquent souvent de détails spécifiques à Kubernetes : un outillage Kubernetes-aware devient alors indispensable.

Les solutions de monitoring les plus efficaces s'intègrent aux stacks d'observabilité existants tout en fournissant des insights propres aux coûts Kubernetes (allocation, efficacité et recommandations).

5. Appliquer des techniques de pod scaling

Le pod scaling complète le right-sizing et améliore l'utilisation. Utilisez le HPA en vous appuyant sur des métriques qui reflètent la demande réelle des workloads (souvent la profondeur de file d'attente, la latence ou le débit, plutôt que le seul CPU). Tous les workloads ne tirent pas parti du HPA : les services stateful et les applications à démarrage lent peuvent nécessiter d'autres approches.

Configurez le Cluster Autoscaler avec soin afin que le scale-up et le scale-down des nœuds collent à la réalité des workloads (temps de chauffe, contraintes de scheduling, exigences de disruption).

Pour les schémas prévisibles, le scheduled scaling permet d'ajuster la capacité par anticipation avant les variations de demande, notamment pour les workloads liés aux heures ouvrées ou au traitement par lots.

Pourquoi l'optimisation des coûts Kubernetes est cruciale

Au-delà des bénéfices financiers évidents, l'optimisation des coûts Kubernetes apporte des avantages stratégiques. Une utilisation efficiente réduit la contention et favorise un scaling plus prévisible. Elle peut aussi renforcer la durabilité grâce à une consommation énergétique moindre.

La maîtrise des risques constitue un autre avantage essentiel. Le right-sizing et une allocation correcte limitent les dépassements de quotas et la pénurie de ressources, surtout dans les environnements partagés. Cela contribue à éviter le throttling CPU, les OOMKills et les pods non schedulables liés à l'épuisement de la capacité du cluster.

Des environnements Kubernetes bien optimisés favorisent également une livraison plus rapide. Quand les équipes connaissent précisément les besoins en ressources, elles conçoivent des pipelines CI/CD plus propres, réduisent l'incertitude et simplifient les approbations — autant d'atouts pour l'agilité métier.

Plus important encore, garder les coûts Kubernetes sous contrôle améliore les prévisions. Les équipes finance gagnent en confiance grâce à des unit economics et à des modèles de chargeback/showback prévisibles, tandis que les équipes engineering disposent de la liberté nécessaire pour innover sans déclencher de dépenses inattendues.

Obstacles potentiels à la réduction de vos coûts Kubernetes

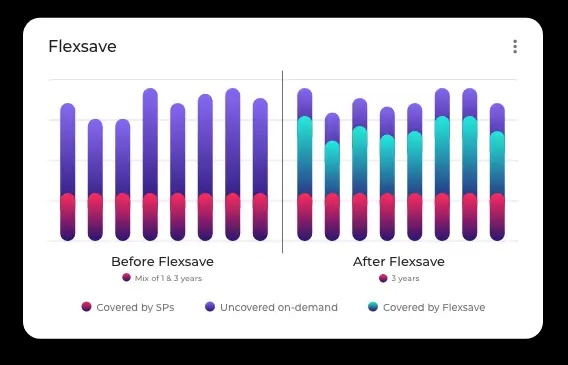

Graphiques avant/après le déploiement de Flexsave

Graphiques avant/après le déploiement de Flexsave

Les organisations rencontrent souvent des difficultés lorsqu'elles cherchent à optimiser leurs coûts Kubernetes. La complexité technique constitue un premier frein : l'optimisation des coûts requiert une expertise en scheduling, en autoscaling et en observabilité financière.

La coordination entre équipes peut aussi s'avérer délicate. Une optimisation efficace exige une collaboration entre les équipes finance, engineering et opérations, dont les objectifs ne sont pas toujours alignés.

Une résistance au changement peut se manifester quand les équipes craignent que l'optimisation ne dégrade la fiabilité. La pédagogie est essentielle : une bonne optimisation des coûts améliore souvent la fiabilité en évitant les phénomènes de noisy neighbor et la contention sur les ressources.

La visibilité sur les coûts demeure un défi persistant, car Kubernetes n'embarque pas de suivi des coûts par défaut. Beaucoup d'organisations déploient leurs clusters sans avoir prévu d'attribution des coûts, puis peinent à recouper après coup métriques, labels et données de facturation. Intégrer les signaux de coût aux workflows quotidiens aide les équipes à faire des choix éclairés dès le premier jour.

Enfin, beaucoup d'organisations ont du mal à inscrire la démarche dans la durée. Des efforts ponctuels peuvent générer des économies, mais sans gouvernance ni responsabilisation continues, les coûts ont tôt fait de repartir à la hausse.

Outils d'optimisation et de monitoring des coûts Kubernetes

Une optimisation efficace des coûts Kubernetes repose sur des outils capables de surveiller, d'analyser et d'aider à gérer l'utilisation des ressources.

1. DoiT

DoiT propose des fonctionnalités d'optimisation des coûts Kubernetes via sa plateforme. Flexsave for Kubernetes assure une optimisation intelligente qui réduit les coûts tout en préservant performance et disponibilité.

La plateforme analyse les schémas de consommation et fournit des recommandations et automatisations propres à Kubernetes, pour un meilleur alignement entre équipes finance et engineering.

Trax, par exemple, a réduit ses dépenses Kubernetes de 75 % avec PerfectScale by DoiT. DoiT aide aussi à corréler les dépenses Kubernetes aux résultats métier et aux unit economics.

2. AWS Cost Explorer

Pour Kubernetes sur AWS (y compris EKS), AWS Cost Explorer apporte une visibilité sur les dépenses liées aux conteneurs, à condition que tagging et allocation soient correctement configurés.

Bien qu'il ne soit pas Kubernetes-native, Cost Explorer permet d'identifier tendances et anomalies dans les dépenses EKS. Combiné à AWS Compute Optimizer, il facilite le right-sizing des instances pour les node groups.

3. Azure Cost Management + Billing

Azure Cost Management permet le suivi des coûts AKS via tagging, regroupement et budgétisation. Container insights ne cesse de progresser, mais les recommandations et l'allocation requièrent souvent une configuration supplémentaire et un labeling rigoureux.

4. GKE Usage Metering

Google Cloud prend en charge l'attribution au niveau namespace via GKE usage metering, qui offre une visibilité plus granulaire que les rapports de facturation standard.

Associé aux recommandations Google Cloud, il aide à identifier des opportunités d'optimisation à partir des schémas d'usage.

KPI FinOps pour piloter les coûts Kubernetes

Pour pérenniser l'optimisation des coûts, suivez des KPI qui relient les décisions techniques aux dépenses :

- Efficacité des clusters : CPU/mémoire demandés par rapport à utilisés sur les namespaces

- Efficacité des workloads : alignement requests/limits et événements de throttling/OOM

- Gaspillage lié à l'inactivité : nœuds inutilisés, namespaces vides, PVC et load balancers orphelins

- Efficacité de l'autoscaling : événements de scaling au regard de l'impact sur les SLO

- Coût unitaire : coût par requête, par job, par client ou par output de workload

FAQ sur l'optimisation des coûts Kubernetes

Comment réduire les coûts Kubernetes sans dégrader les performances ?

Commencez par mesurer : right-sizez les requests à partir de l'usage réel, activez l'autoscaling et supprimez les ressources inactives. Procédez par changements progressifs (mode recommandation du VPA, déploiements échelonnés) et suivez les SLO pour garantir la stabilité des performances.

Quel est le moyen le plus rapide de baisser les coûts Kubernetes ?

Les gains les plus rapides viennent généralement de la correction des requests gonflés, de l'arrêt des clusters non-prod inactifs, de la suppression du stockage orphelin et de la mise en place du cluster autoscaling avec des contraintes raisonnables.

Quels outils aident à l'allocation des coûts Kubernetes ?

Les outils Kubernetes-aware qui s'appuient sur l'allocation par namespace et par label sont les plus utiles. Les outils de facturation cloud n'apportent une vraie valeur que si votre stratégie de tagging/labeling est cohérente et intégrée aux métadonnées du cluster.

Les instances Spot sont-elles fiables pour Kubernetes ?

Oui, pour les workloads tolérants aux interruptions. Utilisez des pod disruption budgets, des taints/tolerations sur les nœuds, une gestion correcte des arrêts gracieux et une base de nœuds on-demand pour les services critiques.

Prochaines étapes pour des dépenses Kubernetes durables

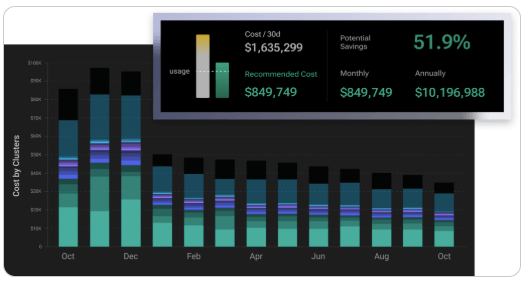

Graphique illustrant la baisse des coûts avec K8s

Graphique illustrant la baisse des coûts avec K8s

Une optimisation durable passe par une approche structurée. Commencez par établir une base de référence des dépenses Kubernetes actuelles par cluster, namespace et application. Cette base rend les progrès mesurables.

Priorisez les gains rapides : nettoyage des ressources inactives, application de politiques de gouvernance de base. Cette dynamique initiale facilite l'adoption d'optimisations plus avancées : ajustement de l'autoscaling, améliorations d'efficacité spécifiques aux workloads, etc.

Constituez un groupe transverse d'optimisation des coûts réunissant les parties prenantes finance, engineering et opérations. La collaboration garantit que les décisions techniques s'alignent sur les objectifs financiers, sans compromettre la fiabilité.

Enfin, instaurez des cycles de revue récurrents. Les environnements Kubernetes évoluent en permanence : l'optimisation des coûts doit être un effort continu, et non un projet ponctuel.

Vous voulez aller plus loin ? Téléchargez notre FinOps Guide to Kubernetes Costs and Complexity pour apprendre à budgétiser stratégiquement vos opérations Kubernetes à grande échelle.