Kubernetes è ormai la piattaforma di riferimento per l'orchestrazione dei container e consente alle aziende di distribuire, scalare e gestire più facilmente le applicazioni containerizzate nel cloud. A questa potenza, però, si accompagna una notevole complessità — e spesso costi inaspettati: nodi sottoutilizzati, vertical pod autoscaling mal calibrato, requests/limits poco efficienti o workloads inattivi che restano in esecuzione per lungo tempo. L'osservabilità dei costi in Kubernetes è frammentaria e, senza strumenti aggiuntivi, è raro avere visibilità nativa sulla spesa per cluster o namespace.

In assenza di una strategia chiara di ottimizzazione, le spese di Kubernetes possono sfuggire di mano. I costi elevati nascono in genere da specifiche criticità architetturali e operative: node pool sovradimensionati rispetto alle reali esigenze dei workloads, bin-packing inefficiente dei pod sui nodi che lascia inutilizzata preziosa capacità di calcolo e l'assenza di meccanismi di autoscaling (come Horizontal Pod Autoscaler, Vertical Pod Autoscaler o Cluster Autoscaler) capaci di adeguare dinamicamente le risorse all'utilizzo effettivo.

Ecco perché un atteggiamento proattivo e un esame attento della spesa di Kubernetes sono fondamentali per tenere i costi sotto controllo e massimizzare il ROI. In questo articolo trova consigli pratici e strumenti utili per aiutare i team a governare workloads e spesa di Kubernetes senza compromettere la fluidità delle operazioni.

Risposte rapide: ottimizzazione dei costi di Kubernetes

**Cos'è l'ottimizzazione dei costi di Kubernetes?**Significa ridurre la spesa dei cluster migliorando l'efficienza delle risorse, applicando il right-sizing a requests e limits, scalando dinamicamente nodi e pod ed eliminando l'infrastruttura inattiva.**Da cosa dipendono i costi elevati di Kubernetes?**Le cause più comuni sono node pool sovradimensionati, requests dei pod gonfiate, bin-packing scadente, storage inutilizzato, cluster inattivi ed egress di rete imprevisto.**Come si abbattono rapidamente i costi di Kubernetes?**Si parte sistemando requests/limits, ripulendo le risorse inattive, schedulando i cluster non di produzione, attivando l'autoscaling e ricorrendo a capacità di calcolo scontata (Spot/preemptible) per i workloads resilienti.

Perché serve ottimizzare i costi di Kubernetes

Senza una gestione adeguata, gli ambienti Kubernetes possono diventare voci di costo molto rilevanti. A determinare queste spese concorrono diversi fattori:

L'inefficienza nell'uso delle risorse di calcolo è quasi sempre la prima preoccupazione. Senza right-sizing, molte aziende sovradimensionano CPU e memoria per scongiurare problemi di prestazioni, con il risultato di tassi di utilizzo bassi e risorse cloud sprecate. Le ricerche indicano che oltre il 65% dei workloads Kubernetes utilizza meno della metà di CPU e memoria richieste. Il motivo principale è che le request di risorse sono sproporzionate rispetto a limits e utilizzo reale. Lo scheduler di Kubernetes si basa sulle request — non sull'utilizzo effettivo — per decidere il placement dei pod. Quando le request sono gonfiate, il bin-packing risulta inefficiente e il numero di nodi cresce senza necessità.

I costi di storage possono lievitare rapidamente negli ambienti cloud Kubernetes. I volumi persistenti — soprattutto le classi di storage premium — diventano significativi man mano che i dati delle applicazioni crescono. Pesano anche i PVC mantenuti dopo l'eliminazione dei pod e una retention eccessiva di snapshot e backup. Ottimizzare lo storage richiede in genere un coordinamento tra i team infrastructure e application, in particolare per i workloads stateful, dove le scelte sui dati incidono su prestazioni e spesa.

Le spese di rete sono un'altra voce importante, soprattutto nei deployment multi-region o ibridi. Il trasferimento dati tra zone, region e servizi esterni può generare addebiti rilevanti che spesso sfuggono nella pianificazione iniziale dell'architettura.

Le risorse inattive rappresentano un'altra grande fonte di spreco. Cluster di sviluppo e test lasciati accesi fuori orario, volumi persistenti dimenticati e load balancer inutilizzati alimentano costi superflui. Senza governance, queste risorse si sommano e gonfiano la spesa complessiva di Kubernetes.

Le strategie chiave per ridurre i costi di Kubernetes

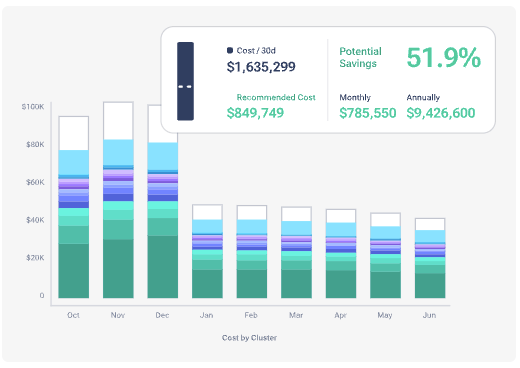

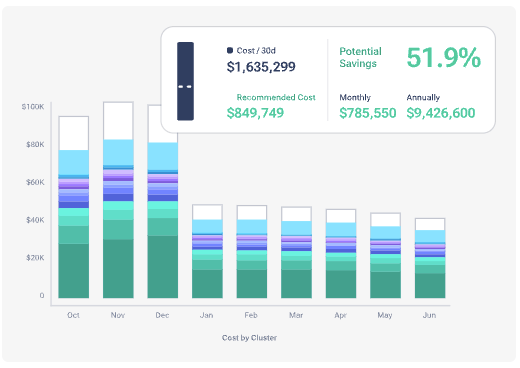

Grafico dei cluster di costo con i potenziali risparmi

Grafico dei cluster di costo con i potenziali risparmi

Capire come questi fattori si intrecciano è fondamentale per progettare un'architettura Kubernetes economicamente sostenibile e migliorarne l'efficienza in termini di costi. Ecco le strategie che può mettere in campo per ridurre la spesa di Kubernetes.

1. Applichi il right-sizing alle risorse dei nodi

Il right-sizing è una delle leve più efficaci per abbattere la spesa di Kubernetes. Lo scheduling si basa sulle risorse richieste, perciò request gonfiate impongono spesso un numero di nodi più elevato anche quando l'utilizzo reale è basso.

Inizi analizzando l'utilizzo storico dei vari cluster. Individui i pod che impiegano in modo costante CPU o memoria sensibilmente inferiori a quanto richiesto: in molti casi è possibile ridurre le request senza intaccare le prestazioni, facendo girare più workloads sui nodi esistenti.

Imposti quote di risorse a livello di namespace per evitare consumi fuori controllo e dare confini chiari ai team. Le quote aiutano anche a contenere picchi di costo imprevisti che innescano scaling non necessari.

Faccia rispettare le policy su requests/limits. Adotti strumenti di policy enforcement (come Gatekeeper) per garantire che ogni workload specifichi entrambi i valori. Le request determinano lo scheduling e influenzano i costi di calcolo, mentre i limits prevengono fenomeni di noisy neighbor e instabilità dei workloads. Senza request adeguate, Kubernetes non riesce a fare bin-packing efficiente: il risultato è nodi sottoutilizzati e spesa sprecata.

Valuti l'uso del Vertical Pod Autoscaler (VPA) inizialmente in modalità raccomandazione. È un modo sicuro per ottenere indicazioni basate sui pattern di utilizzo prima di passare all'automazione. Combini VPA con Horizontal Pod Autoscaler (HPA) dove ha senso, ricordando però che possono entrare in conflitto quando agiscono entrambi sugli stessi segnali di CPU/memoria: serve quindi una calibrazione attenta.

2. Sfrutti le Spot instances

Le Spot instances (o le VM preemptible su Google Cloud) consentono di ridurre in modo sensibile i costi di calcolo sfruttando capacità inutilizzata. Possono però essere revocate con preavviso minimo, quindi i workloads devono tollerare le interruzioni.

Utilizzi pod disruption budget, taint/toleration e regole di node affinity per eseguire in sicurezza i workloads idonei sui nodi Spot. Privilegi quelli stateless e fault-tolerant, come l'elaborazione batch e i servizi scalabili orizzontalmente.

In produzione, un approccio ibrido (Spot più una baseline on-demand) è il giusto compromesso tra risparmio e affidabilità.

3. Implementi una governance automatizzata

La governance automatizzata assicura un controllo continuo dei costi attraverso l'enforcement di policy-as-code e controlli runtime lungo tutto il ciclo di vita di Kubernetes.

- Richieda requests e limits per tutti i workloads

- Imponga l'uso di classi di storage in base ai requisiti del workload

- Renda obbligatorie le label per l'allocazione dei costi e l'attribuzione della responsabilità

- Spenga o riduca automaticamente gli ambienti di sviluppo fuori orario

Strumenti come CloudFlow di DoiT aiutano a far rispettare le policy, impediscono la creazione di risorse non conformi e garantiscono disciplina sui costi tra i team.

4. Adotti un monitoraggio granulare

Per ottimizzare i costi serve visibilità sui pattern di consumo. Un monitoraggio efficace include in genere:

- Metriche di utilizzo a livello di pod

- Statistiche sull'efficienza dei nodi

- Allocazione dei costi per namespace e label

- Analisi degli andamenti storici e rilevamento delle anomalie

Questa granularità aiuta a individuare opportunità di ottimizzazione e ad attribuire i costi a team, progetti o applicazioni. In molti ambienti il labeling è incompleto e ne riduce l'accuratezza. Gli strumenti di billing nativi dei cloud provider, inoltre, sono spesso poveri di dettaglio specifico per Kubernetes: per questo si ricorre frequentemente a soluzioni Kubernetes-aware.

Le soluzioni di monitoraggio più efficaci si integrano con gli stack di osservabilità esistenti e offrono insight specifici sui costi di Kubernetes (allocazione, efficienza e raccomandazioni).

5. Applichi tecniche di pod scaling

Il pod scaling è il complemento naturale del right-sizing e migliora l'utilizzo delle risorse. Usi l'HPA con metriche che riflettano la reale domanda del workload (spesso profondità della coda, latenza o throughput, più che la sola CPU). Non tutti i workloads traggono vantaggio dall'HPA: i servizi stateful e le applicazioni con avvio lento possono richiedere approcci alternativi.

Configuri il Cluster Autoscaler con cura, in modo che lo scale-up e lo scale-down dei nodi rispecchino la realtà dei workloads (tempi di warm-up, vincoli di scheduling e requisiti di disruption).

Per i pattern prevedibili, lo scaling pianificato consente di adeguare in anticipo la capacità rispetto alle variazioni di domanda — particolarmente utile per i workloads in orario d'ufficio o di elaborazione batch.

Perché l'ottimizzazione dei costi di Kubernetes è importante

Oltre agli evidenti vantaggi economici, l'ottimizzazione dei costi di Kubernetes porta benefici strategici. Un utilizzo efficiente riduce la contesa delle risorse e rende lo scaling più prevedibile. Può inoltre migliorare la sostenibilità grazie a un minor consumo energetico.

Anche la mitigazione del rischio è un vantaggio decisivo. Right-sizing e allocazione corretta riducono la probabilità di superare le quote o di restare a corto di risorse, soprattutto negli ambienti condivisi. Si prevengono così CPU throttling, OOMKills e pod non schedulabili dovuti all'esaurimento della capacità del cluster.

Un ambiente Kubernetes ben ottimizzato favorisce anche tempi di delivery più rapidi. Quando i team conoscono con precisione le esigenze di risorse, possono progettare pipeline CI/CD più snelle, ridurre l'incertezza e semplificare le approvazioni: tutti elementi che alimentano l'agilità del business.

Forse l'aspetto più rilevante è che mantenere sotto controllo i costi di Kubernetes migliora il forecasting. I team finance acquisiscono fiducia grazie a unit economics e a modelli di chargeback/showback prevedibili, mentre i team di engineering hanno la libertà di innovare senza generare spese impreviste.

Possibili ostacoli alla riduzione dei costi di Kubernetes

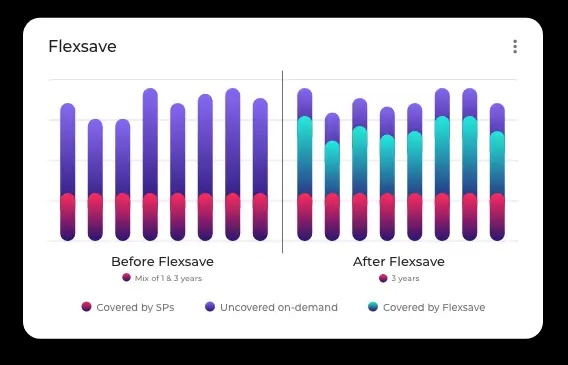

Grafici prima e dopo dell'implementazione di Flexsave

Grafici prima e dopo dell'implementazione di Flexsave

Le aziende incontrano spesso difficoltà nell'ottimizzazione dei costi di Kubernetes. La complessità tecnica può essere un primo ostacolo: servono competenze specifiche su scheduling, autoscaling e osservabilità dei costi.

Anche il coordinamento tra i team può risultare complicato. Un'ottimizzazione efficace richiede la collaborazione tra finance, engineering e operations, che spesso hanno incentivi diversi.

Può emergere resistenza al cambiamento quando i team temono che l'ottimizzazione comprometta l'affidabilità. La formazione è essenziale: una buona ottimizzazione dei costi, in realtà, migliora spesso l'affidabilità prevenendo problemi di noisy neighbor e contesa delle risorse.

La visibilità sui costi è una sfida ricorrente, perché Kubernetes non include un tracciamento dei costi integrato di default. Molte aziende mettono in produzione i cluster senza pianificare l'attribuzione dei costi e poi faticano a ricostruire a posteriori metriche, label e dati di billing. Integrare i segnali di costo nei flussi di lavoro quotidiani aiuta i team a fare scelte consapevoli sin dal primo giorno.

Infine, molte aziende fanno fatica a rendere sostenibili nel tempo i risultati. Le iniziative una tantum possono generare risparmi, ma senza governance e responsabilità continuative i costi tendono a risalire.

Strumenti per l'ottimizzazione e il monitoraggio dei costi di Kubernetes

Per ottimizzare davvero i costi di Kubernetes servono strumenti capaci di monitorare, analizzare e gestire l'utilizzo delle risorse.

1. DoiT

DoiT offre funzionalità di ottimizzazione dei costi di Kubernetes attraverso la sua piattaforma. Flexsave for Kubernetes abilita un'ottimizzazione intelligente che riduce i costi senza compromettere prestazioni e disponibilità.

La piattaforma analizza i pattern di consumo e fornisce raccomandazioni e automazioni specifiche per Kubernetes, favorendo un migliore allineamento tra i team finance ed engineering.

Trax, ad esempio, ha ridotto del 75% la spesa Kubernetes con PerfectScale by DoiT. DoiT aiuta inoltre a correlare la spesa di Kubernetes con i risultati di business e le unit economics.

2. AWS Cost Explorer

Per Kubernetes su AWS (incluso EKS), AWS Cost Explorer offre visibilità sulla spesa relativa ai container quando tagging e allocazione sono configurati correttamente.

Pur non essendo nativo per Kubernetes, Cost Explorer è in grado di evidenziare trend e anomalie nella spesa EKS. In abbinamento ad AWS Compute Optimizer, supporta il right-sizing delle istanze per i node group.

3. Azure Cost Management + Billing

Azure Cost Management consente di tracciare i costi di AKS tramite tagging, raggruppamento e budgeting. I container insight continuano a migliorare, ma raccomandazioni e allocazione richiedono spesso configurazioni aggiuntive e una disciplina rigorosa nel labeling.

4. GKE Usage Metering

Google Cloud supporta l'attribuzione a livello di namespace tramite GKE usage metering, che offre una visibilità più granulare rispetto ai report di billing standard.

In abbinamento alle raccomandazioni di Google Cloud, aiuta a individuare opportunità di ottimizzazione basate sui pattern di utilizzo.

KPI in stile FinOps per il controllo dei costi di Kubernetes

Per rendere durevole l'ottimizzazione dei costi, monitori KPI capaci di legare le decisioni tecniche alla spesa:

- Efficienza del cluster: CPU/memoria richieste vs. utilizzate nei vari namespace

- Efficienza del workload: allineamento request/limit ed eventi di throttling/OOM

- Spreco da inattività: nodi inutilizzati, namespace vuoti, PVC e load balancer orfani

- Efficacia dell'autoscaling: eventi di scaling vs. impatto sugli SLO

- Costo unitario: costo per richiesta, job, cliente o output del workload

FAQ sull'ottimizzazione dei costi di Kubernetes

Come posso ridurre i costi di Kubernetes senza penalizzare le prestazioni?

Parta dalla misurazione: right-sizing delle request sull'utilizzo reale, attivazione dell'autoscaling e rimozione delle risorse inattive. Adotti modifiche graduali (modalità raccomandazione del VPA, rollout a fasi) e monitori gli SLO per assicurare prestazioni stabili.

Qual è il modo più rapido per abbattere i costi di Kubernetes?

I risultati più veloci arrivano in genere correggendo le request gonfiate, spegnendo i cluster non di produzione inattivi, rimuovendo lo storage orfano e attivando il cluster autoscaling con vincoli sensati.

Quali strumenti aiutano nell'allocazione dei costi di Kubernetes?

Sono utili soprattutto gli strumenti Kubernetes-aware che si appoggiano a namespace e label. Gli strumenti di billing dei cloud provider danno valore solo se la strategia di tagging/labeling è coerente e integrata con i metadati del cluster.

Le Spot instances sono sicure per Kubernetes?

Sì, per i workloads tolleranti alle interruzioni. Utilizzi pod disruption budget, taint/toleration sui nodi, gestione della terminazione graceful e una baseline di nodi on-demand per i servizi critici.

Prossimi passi per una spesa Kubernetes sostenibile

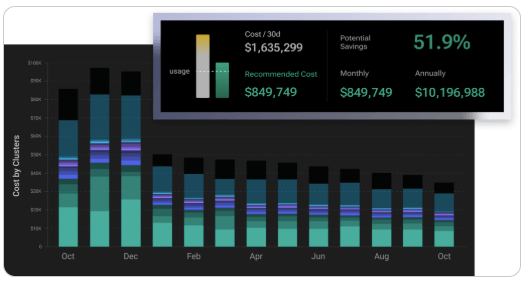

Grafico della riduzione dei costi con K8s

Grafico della riduzione dei costi con K8s

Per un'ottimizzazione sostenibile serve un approccio strutturato. Inizi definendo una baseline della spesa Kubernetes attuale per cluster, namespace e applicazione: solo così i progressi diventano misurabili.

Dia priorità ai quick win — pulizia delle risorse inattive e applicazione di policy di governance di base. Lo slancio iniziale aiuta i team ad affrontare ottimizzazioni più avanzate, come il tuning dell'autoscaling e i miglioramenti di efficienza specifici per workload.

Costituisca un gruppo di lavoro cross-funzionale sull'ottimizzazione dei costi, con stakeholder di finance, engineering e operations. La collaborazione assicura che le decisioni tecniche siano allineate agli obiettivi finanziari senza penalizzare l'affidabilità.

Definisca infine cicli di revisione ricorrenti. Gli ambienti Kubernetes evolvono di continuo, perciò l'ottimizzazione dei costi deve essere un processo continuativo e non un progetto una tantum.

Vuole approfondire? Scarichi la nostra FinOps Guide to Kubernetes Costs and Complexity per scoprire come pianificare strategicamente il budget per operazioni scalabili in Kubernetes.