Kubernetes hat sich als Standardplattform für Container-Orchestrierung durchgesetzt: Containerisierte Anwendungen lassen sich damit in der Cloud deutlich einfacher ausrollen, skalieren und betreiben. Mit dieser Power kommt allerdings auch Komplexität – und nicht selten überraschend hohe Kosten. Auslöser sind unterausgelastete Nodes, schlecht abgestimmtes Vertical Pod Autoscaling, ineffiziente Requests/Limits oder workloads, die dauerhaft im Leerlauf weiterlaufen. Die Cost Observability in Kubernetes ist fragmentiert, und ohne zusätzliche Tools fehlt es meist an nativer Kostentransparenz über Cluster oder Namespaces hinweg.

Ohne klare Optimierungsstrategie laufen die Kubernetes-Ausgaben schnell aus dem Ruder. Hohe Kubernetes-Kosten haben in der Regel konkrete architektonische und betriebliche Ursachen: überdimensionierte Node Pools, die weit über dem tatsächlichen Bedarf der workloads liegen, ineffizientes Bin-Packing der Pods, das wertvolle Compute-Kapazität brachliegen lässt, und fehlende Autoscaling-Mechanismen (Horizontal Pod Autoscaler, Vertical Pod Autoscaler oder Cluster Autoscaler), die Ressourcen dynamisch an die Last anpassen würden.

Genau deshalb lohnt es sich, die Kubernetes-Ausgaben proaktiv unter die Lupe zu nehmen, Kosten im Griff zu behalten und den ROI zu maximieren. Dieser Artikel zeigt praxisnahe Tipps und Tools, mit denen Teams ihre Kubernetes-workloads und -Ausgaben steuern, ohne den laufenden Betrieb zu gefährden.

Schnelle Antworten: Kubernetes-Kostenoptimierung

**Was ist Kubernetes-Kostenoptimierung?**Kubernetes-Kostenoptimierung bedeutet, die Cluster-Ausgaben zu senken, indem die Ressourceneffizienz verbessert, Requests und Limits sauber dimensioniert (Right-Sizing), Nodes und Pods dynamisch skaliert und ungenutzte Infrastruktur abgebaut werden.**Was verursacht hohe Kubernetes-Kosten?**Die häufigsten Ursachen sind überdimensionierte Node Pools, aufgeblähte Pod-Requests, schlechtes Bin-Packing, ungenutzter Storage, leerlaufende Cluster und unerwarteter Netzwerk-Egress.**Wie lassen sich Kubernetes-Kosten schnell senken?**Beginnen Sie mit dem Korrigieren der Requests/Limits, dem Bereinigen ungenutzter Ressourcen, dem Abschalten von Non-Prod-Clustern nach Plan, der Aktivierung von Autoscaling und dem Einsatz vergünstigter Compute-Ressourcen (Spot/Preemptible) für robuste workloads.

Warum Kubernetes-Kostenoptimierung notwendig ist

Ohne sauberes Management werden Kubernetes-Umgebungen schnell zu erheblichen Kostentreibern. Mehrere Faktoren spielen dabei zusammen:

Ineffizienz bei Compute-Ressourcen steht meist ganz oben auf der Liste. Ohne Right-Sizing dimensionieren viele Unternehmen CPU und Arbeitsspeicher großzügig, um Performance-Probleme zu vermeiden – das Ergebnis sind niedrige Auslastungsraten und vergeudete Cloud-Ressourcen. Studien belegen, dass über 65 % der Kubernetes-workloads weniger als die Hälfte der angeforderten CPU- und Speicherressourcen nutzen. Hauptgrund: Resource Requests sind im Verhältnis zu Limits und tatsächlichem Verbrauch zu hoch angesetzt. Der Kubernetes-Scheduler trifft seine Pod-Platzierungsentscheidungen anhand der Requests – nicht anhand des realen Verbrauchs. Sind die Requests aufgebläht, leiden Bin-Packing und Node-Anzahl entsprechend.

Storage-Kosten summieren sich in Kubernetes-Cloud-Umgebungen schnell. Persistent Volumes (vor allem in Premium Storage Classes) können mit wachsendem Datenvolumen erheblich ins Gewicht fallen. Hinzu kommen nach der Pod-Löschung verbliebene PVCs sowie eine zu großzügige Aufbewahrung von Snapshots und Backups. Storage zu optimieren erfordert oft eine enge Abstimmung zwischen Infrastruktur- und Anwendungsteams – insbesondere bei stateful workloads, bei denen Datenentscheidungen direkt auf Performance und Kosten durchschlagen.

Netzwerkkosten sind ein weiterer Treiber, vor allem bei Multi-Region- oder Hybrid-Deployments. Der Datenverkehr zwischen Zonen, Regionen und externen Diensten kann erhebliche Gebühren verursachen, die in der initialen Architekturplanung gerne übersehen werden.

Ungenutzte Ressourcen sind eine weitere wesentliche Quelle für Waste. Entwicklungs- und Test-Cluster, die außerhalb der Arbeitszeit weiterlaufen, übrig gebliebene Persistent Volumes und nicht genutzte Load Balancer – all das erzeugt unnötige Kosten. Ohne Governance summiert sich das schnell und treibt die gesamten Kubernetes-Ausgaben in die Höhe.

Zentrale Strategien, um Ihre Kubernetes-Kosten zu senken

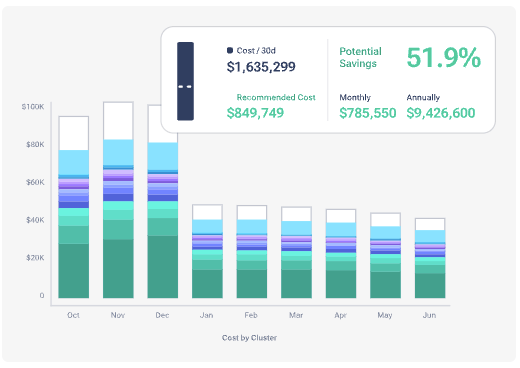

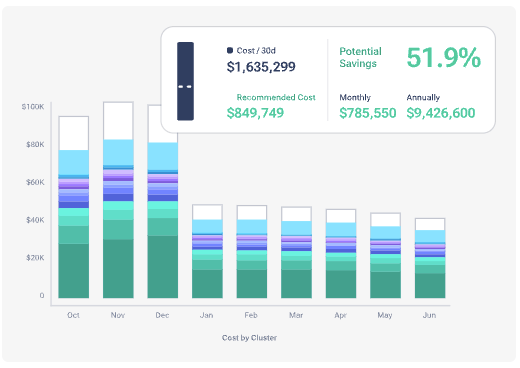

Cluster-Kosten-Diagramm mit potenziellen Einsparungen

Cluster-Kosten-Diagramm mit potenziellen Einsparungen

Wer versteht, wie diese Faktoren zusammenwirken, kann eine kosteneffiziente Kubernetes-Architektur aufsetzen und die Effizienz spürbar steigern. Die folgenden Strategien helfen dabei, Kubernetes-Kosten zu senken.

1. Node-Ressourcen richtig dimensionieren

Right-Sizing zählt zu den wirkungsvollsten Hebeln, um Kubernetes-Ausgaben zu reduzieren. Da das Scheduling sich nach den angeforderten Ressourcen richtet, treiben aufgeblähte Requests die Node-Zahl in die Höhe – selbst wenn die tatsächliche Auslastung gering ist.

Starten Sie mit der Analyse der historischen Auslastung über alle Cluster hinweg. Identifizieren Sie Pods, die durchgängig deutlich weniger CPU oder Arbeitsspeicher verbrauchen als angefordert. Häufig lassen sich Requests reduzieren, ohne die Performance zu beeinträchtigen, sodass mehr workloads auf den vorhandenen Nodes Platz finden.

Setzen Sie Resource Quotas auf Namespace-Ebene, um eine ausufernde Nutzung zu unterbinden und klare Leitplanken für die Teams zu schaffen. Quotas helfen außerdem, unerwartete Kostenspitzen zu vermeiden, die zu unnötiger Skalierung führen.

Erzwingen Sie Richtlinien für Requests und Limits. Mit Policy-Enforcement-Tools wie Gatekeeper stellen Sie sicher, dass jede Workload beides angibt. Requests steuern das Scheduling und damit die Compute-Kosten, Limits verhindern Noisy Neighbors und Workload-Instabilität. Ohne saubere Requests kann Kubernetes kein effizientes Bin-Packing leisten – die Folge sind unterausgelastete Nodes und unnötige Ausgaben.

Setzen Sie den Vertical Pod Autoscaler (VPA) zunächst im Empfehlungsmodus ein. So bekommen Sie zunächst sichere Hinweise auf Basis realer Nutzungsmuster, bevor Sie auf Automatisierung umstellen. VPA und Horizontal Pod Autoscaler (HPA) lassen sich kombinieren – können sich aber gegenseitig stören, wenn beide auf dieselben CPU- bzw. Speichersignale reagieren. Sorgfältiges Tuning ist daher Pflicht.

2. Spot Instances einsetzen

Spot Instances (oder Preemptible VMs in Google Cloud) senken die Compute-Kosten deutlich, indem sie freie Kapazitäten nutzen. Sie können kurzfristig zurückgefordert werden – die workloads müssen Unterbrechungen also verkraften.

Mit Pod Disruption Budgets, Taints/Tolerations und Node-Affinity-Regeln lassen sich geeignete workloads sicher auf Spot-Nodes betreiben. Priorisieren Sie zustandslose und fehlertolerante workloads wie Batch-Processing oder horizontal skalierbare Services.

Für die Produktion ist ein hybrider Ansatz – Spot kombiniert mit einer On-Demand-Basiskapazität – meist die beste Balance aus Einsparung und Verlässlichkeit.

3. Automatisierte Governance einführen

Automatisierte Governance sorgt für kontinuierliche Kostenkontrolle – über Policy-as-Code-Enforcement und Runtime-Kontrollen entlang des gesamten Kubernetes-Lebenszyklus.

- Requests und Limits für alle workloads verbindlich vorgeben

- Storage-Class-Nutzung anhand der Workload-Anforderungen erzwingen

- Labels für Kostenallokation und Ownership verpflichtend machen

- Entwicklungsumgebungen außerhalb der Arbeitszeit automatisch herunterfahren oder skalieren

Tools wie CloudFlow von DoiT setzen Richtlinien durch, verhindern, dass nicht konforme Ressourcen überhaupt entstehen, und sorgen teamübergreifend für Kostendisziplin.

4. Granulares Monitoring nutzen

Kostenoptimierung braucht Transparenz über die Verbrauchsmuster. Effektives Monitoring umfasst typischerweise:

- Auslastungsmetriken auf Pod-Ebene

- Effizienzkennzahlen je Node

- Kostenallokation nach Namespace und Label

- Historische Trends und Anomalieerkennung

Diese Granularität deckt Optimierungspotenziale auf und ermöglicht es, Kosten Teams, Projekten oder Anwendungen zuzuordnen. In vielen Umgebungen leidet die Genauigkeit unter unvollständigem Labeling. Native Cloud-Billing-Tools liefern oft keinen Kubernetes-spezifischen Detailgrad – Kubernetes-fähige Tools sind daher meist unverzichtbar.

Die wirkungsvollsten Monitoring-Lösungen fügen sich nahtlos in bestehende Observability-Stacks ein und liefern dabei Kubernetes-spezifische Kosten-Insights (Allokation, Effizienz, Empfehlungen).

5. Pod-Skalierungstechniken anwenden

Pod-Skalierung ergänzt das Right-Sizing und verbessert die Auslastung. Setzen Sie HPA auf Basis von Metriken ein, die den realen Workload-Bedarf abbilden – häufig Queue-Tiefe, Latenz oder Durchsatz statt allein CPU. Nicht jede Workload profitiert von HPA: Stateful Services und Anwendungen mit langer Startphase brauchen oft andere Ansätze.

Konfigurieren Sie den Cluster Autoscaler mit Bedacht, damit Scale-up und Scale-down zu den Workload-Realitäten passen (Aufwärmzeit, Scheduling-Constraints, Disruption-Anforderungen).

Bei vorhersehbaren Mustern kann eine geplante Skalierung die Kapazität präventiv anpassen, bevor sich die Last ändert – besonders bei workloads während der Geschäftszeiten oder im Batch-Processing.

Warum Kubernetes-Kostenoptimierung zählt

Über die offensichtlichen finanziellen Vorteile hinaus bringt Kubernetes-Kostenoptimierung auch strategischen Mehrwert. Eine effiziente Auslastung reduziert Ressourcenkonflikte und macht die Skalierung berechenbarer. Sie kann zudem die Nachhaltigkeit verbessern, indem sie den Energieverbrauch senkt.

Auch das Risiko sinkt: Right-Sizing und saubere Allokation reduzieren das Risiko von Quota-Überschreitungen und Ressourcenengpässen, gerade in Shared Environments. So lassen sich CPU-Throttling, OOMKills und nicht schedulebare Pods aufgrund erschöpfter Cluster-Kapazität vermeiden.

Gut optimierte Kubernetes-Umgebungen ermöglichen außerdem schnellere Releases. Wenn Teams den Ressourcenbedarf präzise kennen, gelingen sauberere CI/CD-Pipelines, weniger Unsicherheit und schlankere Freigabeprozesse – alles Faktoren, die die Business-Agilität stärken.

Vielleicht der wichtigste Punkt: Kontrollierte Kubernetes-Kosten verbessern die Forecast-Qualität. Finance-Teams gewinnen Sicherheit durch Unit Economics und verlässliche Chargeback-/Showback-Modelle, während Engineering-Teams den Freiraum behalten, zu innovieren, ohne Kostenüberraschungen auszulösen.

Mögliche Hürden bei der Senkung Ihrer Kubernetes-Kosten

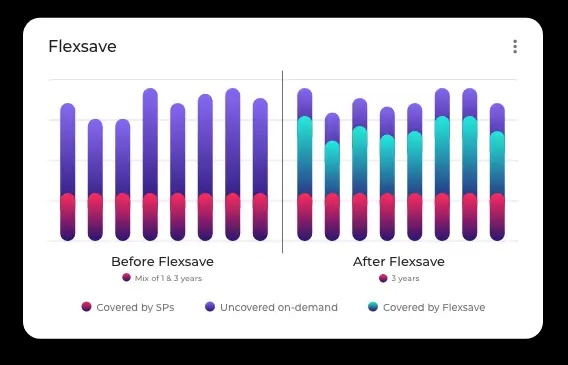

Vorher-Nachher-Diagramme zur Flexsave-Implementierung

Vorher-Nachher-Diagramme zur Flexsave-Implementierung

Bei der Optimierung von Kubernetes-Kosten stoßen Unternehmen regelmäßig auf Hürden. Die technische Komplexität ist eine davon: Kostenoptimierung verlangt fundiertes Wissen zu Scheduling-Verhalten, Autoscaling und Cost Observability.

Auch die teamübergreifende Abstimmung ist anspruchsvoll. Effektive Optimierung lebt vom Zusammenspiel zwischen Finance, Engineering und Operations – Teams, die teils sehr unterschiedliche Anreize haben.

Widerstand gegen Veränderungen entsteht oft, wenn Teams befürchten, Optimierung gehe zulasten der Verlässlichkeit. Aufklärung ist hier entscheidend: Saubere Kostenoptimierung erhöht die Verlässlichkeit häufig sogar, weil sie Noisy-Neighbor-Probleme und Ressourcenkonflikte entschärft.

Kostentransparenz bleibt ein Dauerthema, da Kubernetes von Haus aus kein integriertes Cost Tracking mitbringt. Viele Unternehmen rollen Cluster aus, ohne die Kostenzuordnung mitzudenken, und müssen Metriken, Labels und Billing-Daten nachträglich mühsam zusammenführen. Werden Kostensignale in die täglichen Workflows integriert, treffen Teams von Anfang an kostenbewusste Entscheidungen.

Und schließlich tun sich viele Organisationen mit der Nachhaltigkeit schwer. Einmalaktionen bringen kurzfristig Einsparungen – ohne kontinuierliche Governance und klare Verantwortlichkeiten klettern die Kosten allerdings schnell wieder nach oben.

Tools für Kubernetes-Kostenoptimierung und Monitoring

Effektive Kubernetes-Kostenoptimierung braucht Tools, die den Ressourcenverbrauch überwachen, analysieren und steuern helfen.

1. DoiT

DoiT bietet Funktionen zur Kubernetes-Kostenoptimierung über seine Plattform. Flexsave for Kubernetes ermöglicht eine intelligente Optimierung, die Kosten senkt und gleichzeitig Performance und Verfügbarkeit sicherstellt.

Die Plattform analysiert Verbrauchsmuster und liefert Kubernetes-spezifische Empfehlungen und Automatisierungen – für eine bessere Abstimmung zwischen Finance- und Engineering-Teams.

Trax beispielsweise hat mit PerfectScale by DoiT 75 % seiner Kubernetes-Ausgaben eingespart. DoiT hilft außerdem dabei, Kubernetes-Ausgaben mit Geschäftsergebnissen und Unit Economics in Beziehung zu setzen.

2. AWS Cost Explorer

Für Kubernetes auf AWS (inklusive EKS) liefert der AWS Cost Explorer Transparenz über containerbezogene Ausgaben – vorausgesetzt, Tagging und Allokation sind sauber konfiguriert.

Auch wenn er nicht Kubernetes-nativ ist, deckt der Cost Explorer Trends und Anomalien bei EKS-Ausgaben auf. In Kombination mit AWS Compute Optimizer unterstützt er das Right-Sizing der Instanzen für Node Groups.

3. Azure Cost Management + Billing

Azure Cost Management unterstützt das AKS-Cost-Tracking über Tagging, Gruppierung und Budgetierung. Container Insights werden laufend weiterentwickelt; Empfehlungen und Allokation erfordern jedoch oft zusätzliche Konfiguration und konsequentes Labeling.

4. GKE Usage Metering

Google Cloud unterstützt die Zuordnung auf Namespace-Ebene über das GKE Usage Metering, das eine deutlich granularere Sicht bietet als die Standard-Billing-Reports.

In Kombination mit den Empfehlungen von Google Cloud lassen sich so Optimierungspotenziale anhand der Nutzungsmuster aufdecken.

FinOps-KPIs für die Kubernetes-Kostenkontrolle

Damit Kostenoptimierung dauerhaft greift, sollten Sie KPIs verfolgen, die technische Entscheidungen mit den Ausgaben verknüpfen:

- Cluster-Effizienz: angeforderte vs. genutzte CPU/Memory über Namespaces hinweg

- Workload-Effizienz: Abstimmung von Requests/Limits sowie Throttling- und OOM-Ereignisse

- Idle Waste: ungenutzte Nodes, leere Namespaces, verwaiste PVCs und Load Balancer

- Wirksamkeit des Autoscalings: Skalierungsereignisse vs. SLO-Auswirkungen

- Stückkosten: Kosten pro Request, Job, Kunde oder Workload-Output

FAQ zur Kubernetes-Kostenoptimierung

Wie senke ich Kubernetes-Kosten, ohne die Performance zu beeinträchtigen?

Beginnen Sie mit der Messung: Right-Sizing der Requests auf Basis des realen Verbrauchs, Aktivierung von Autoscaling und Bereinigung ungenutzter Ressourcen. Gehen Sie schrittweise vor (VPA-Empfehlungsmodus, gestaffelte Rollouts) und überwachen Sie die SLOs, damit die Performance stabil bleibt.

Was ist der schnellste Weg, Kubernetes-Kosten zu senken?

Die schnellsten Erfolge bringen meist das Korrigieren überdimensionierter Requests, das Abschalten ungenutzter Non-Production-Cluster, das Entfernen verwaisten Storages und die Einführung von Cluster-Autoscaling mit sinnvollen Constraints.

Welche Tools helfen bei der Kubernetes-Kostenallokation?

Am hilfreichsten sind Kubernetes-fähige Tools, die mit Namespace- und Label-basierter Allokation arbeiten. Cloud-Billing-Tools liefern nur dann verlässliche Werte, wenn Ihre Tagging- und Labeling-Strategie konsistent ist und mit den Cluster-Metadaten verknüpft wird.

Sind Spot Instances für Kubernetes sicher?

Ja – für unterbrechungstolerante workloads. Setzen Sie Pod Disruption Budgets, Node Taints/Tolerations, ein sauberes Termination-Handling sowie eine On-Demand-Basis für kritische Services ein.

Nächste Schritte für nachhaltige Kubernetes-Ausgaben

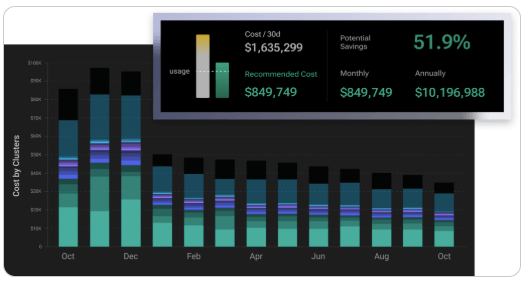

Diagramm sinkender Kosten mit K8s

Diagramm sinkender Kosten mit K8s

Eine nachhaltige Optimierung erfordert ein strukturiertes Vorgehen. Erstellen Sie zunächst eine Baseline der aktuellen Kubernetes-Ausgaben nach Cluster, Namespace und Anwendung. Erst dann werden Fortschritte messbar.

Setzen Sie zu Beginn auf schnelle Erfolge wie das Bereinigen ungenutzter Ressourcen und das Durchsetzen grundlegender Governance-Richtlinien. Frühe Erfolge motivieren die Teams, anschließend auch weiterführende Optimierungen wie Autoscaling-Tuning oder workload-spezifische Effizienzverbesserungen anzugehen.

Bilden Sie eine bereichsübergreifende Kostenoptimierungsgruppe mit Stakeholdern aus Finance, Engineering und Operations. So stellen Sie sicher, dass technische Entscheidungen den finanziellen Zielen folgen, ohne die Verlässlichkeit zu gefährden.

Etablieren Sie schließlich feste Review-Zyklen. Kubernetes-Umgebungen verändern sich ständig – Kostenoptimierung muss daher ein laufender Prozess sein und kein einmaliges Projekt.

Sie wollen tiefer einsteigen? Laden Sie unseren FinOps Guide to Kubernetes Costs and Complexity herunter und erfahren Sie, wie Sie strategisch für skalierbare Kubernetes-Operationen budgetieren.