Kubernetes se ha vuelto la plataforma de referencia para orquestar contenedores, ya que facilita desplegar, escalar y gestionar aplicaciones contenerizadas en la nube. Pero junto con esa potencia llega la complejidad y, muchas veces, costos inesperados que provienen de nodos subutilizados, un vertical pod autoscaling mal afinado, configuraciones ineficientes de requests/limits o workloads inactivos que siguen corriendo demasiado tiempo. La observabilidad de costos en Kubernetes está fragmentada, y rara vez se obtiene visibilidad nativa entre clusters o namespaces sin sumar herramientas adicionales.

Sin una estrategia clara de optimización, el gasto en Kubernetes puede dispararse. Los costos altos suelen tener su origen en problemas concretos de arquitectura y operación: node pools sobreaprovisionados que exceden la demanda real de los workloads, un bin-packing ineficiente de pods entre nodos que deja capacidad de cómputo valiosa sin usar y la falta de mecanismos de autoscaling (como Horizontal Pod Autoscaler, Vertical Pod Autoscaler o Cluster Autoscaler) que ajusten los recursos de forma dinámica según el uso.

Por eso, anticiparse y revisar a fondo el gasto en Kubernetes ayuda a controlar costos y a maximizar el ROI. Este artículo reúne consejos prácticos y herramientas para que los equipos tomen el control de sus workloads y de su gasto en Kubernetes sin afectar la operación.

Respuestas rápidas: optimización de costos en Kubernetes

**¿Qué es la optimización de costos en Kubernetes?**Es la práctica de reducir el gasto del cluster mejorando la eficiencia de los recursos, ajustando (right-sizing) requests y limits, escalando nodos y pods de forma dinámica y eliminando la infraestructura inactiva.**¿Qué causa los costos altos en Kubernetes?**Las causas más comunes son node pools sobreaprovisionados, requests de pod inflados, bin-packing deficiente, almacenamiento sin uso, clusters inactivos y egreso de red inesperado.**¿Cómo se reducen rápido los costos de Kubernetes?**Empieza por afinar requests/limits, limpiar recursos inactivos, programar el apagado de clusters no productivos, habilitar autoscaling y usar cómputo con descuento (spot/preemptible) para workloads resilientes.

¿Qué factores hacen necesaria la optimización de costos en Kubernetes?

Sin una gestión adecuada, los entornos de Kubernetes pueden convertirse en centros de costo de peso. Hay varios factores que inciden en este gasto:

La ineficiencia en los recursos de cómputo suele encabezar la lista. Sin right-sizing, muchas organizaciones sobreaprovisionan CPU y memoria para evitar problemas de rendimiento, lo que se traduce en tasas de utilización bajas y recursos de nube desaprovechados. Los estudios muestran que más del 65 % de los workloads de Kubernetes usa menos de la mitad del CPU y la memoria que solicita. Esto ocurre, sobre todo, porque los resource requests están sobreaprovisionados respecto a los limits y al uso real. Los schedulers de Kubernetes se basan en los resource requests —no en el uso real— para decidir dónde colocar los pods. Cuando los requests están inflados, el bin-packing es deficiente y la cantidad de nodos termina siendo innecesariamente alta.

Los costos de almacenamiento pueden acumularse rápido en entornos cloud de Kubernetes. Los volúmenes persistentes (sobre todo las clases de almacenamiento premium) crecen a la par de los datos de las aplicaciones. A esto se suman los PVCs que quedan retenidos tras eliminar pods y la retención excesiva de snapshots/backups. Optimizar el almacenamiento suele requerir coordinación entre los equipos de infraestructura y de aplicaciones, sobre todo en workloads con estado, donde las decisiones sobre los datos impactan en el rendimiento y en el gasto.

Los gastos de red son otro factor relevante, sobre todo en despliegues multirregión o híbridos. La transferencia de datos entre zonas, regiones y servicios externos puede generar cargos importantes que los equipos suelen pasar por alto al planificar la arquitectura inicial.

Los recursos inactivos también son una gran fuente de pérdida. Clusters de desarrollo y pruebas que siguen corriendo fuera de horario, volúmenes persistentes huérfanos y load balancers sin uso suman costos innecesarios. Sin gobernanza, esos recursos se acumulan y disparan el gasto total de Kubernetes.

Estrategias clave para reducir tus costos de Kubernetes

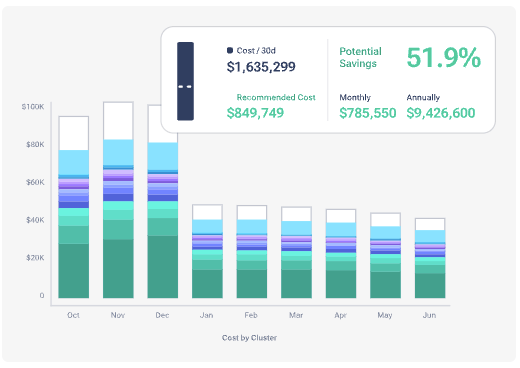

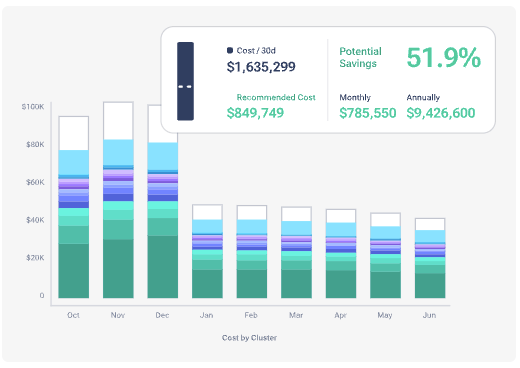

Gráfico de cluster de costos con potencial de ahorro

Gráfico de cluster de costos con potencial de ahorro

Entender cómo se relacionan estos factores es clave para diseñar una arquitectura de Kubernetes rentable y mejorar la eficiencia en costos. Estas son algunas estrategias que puedes aplicar para bajar el gasto en Kubernetes.

1. Ajusta el tamaño de los recursos de los nodos

El right-sizing es una de las estrategias de mayor impacto para reducir el gasto en Kubernetes. La planificación de Kubernetes se basa en los recursos solicitados, así que los requests inflados terminan forzando una mayor cantidad de nodos aunque el uso real sea bajo.

Empieza por analizar la utilización histórica entre clusters. Identifica los pods que usan de forma constante mucho menos CPU o memoria de la que solicitan. Muchas organizaciones pueden bajar los requests sin afectar el rendimiento, lo que permite correr más workloads sobre los nodos existentes.

Define cuotas de recursos a nivel de namespace para evitar consumos descontrolados y marcar límites claros entre equipos. Las cuotas también ayudan a reducir picos de costo inesperados que disparan escalamientos innecesarios.

Aplica políticas de requests/limits. Implementa herramientas de policy enforcement (como Gatekeeper) para asegurarte de que cada workload los especifique. Los requests determinan la planificación y afectan los costos de cómputo, mientras que los limits previenen workloads inestables y los típicos "vecinos ruidosos". Sin requests adecuados, Kubernetes no puede hacer un buen bin-packing, lo que genera nodos subutilizados y gasto perdido.

Considera usar el Vertical Pod Autoscaler (VPA) primero en modo recomendación. Esto te da una guía segura basada en los patrones de uso antes de pasar a la automatización. Combina VPA con Horizontal Pod Autoscaler (HPA) cuando tenga sentido, pero ten en cuenta que pueden entrar en conflicto si ambos apuntan a las mismas señales de CPU/memoria, así que se requiere un ajuste cuidadoso.

2. Usa instancias spot

Las instancias Spot (o las VMs preemptibles en Google Cloud) pueden bajar bastante los costos de cómputo aprovechando capacidad sobrante. Pueden reclamarse con muy poco aviso, así que los workloads tienen que tolerar interrupciones.

Usa pod disruption budgets, taints/tolerations y reglas de afinidad de nodos para correr de forma segura los workloads elegibles en nodos Spot. Prioriza workloads sin estado y tolerantes a fallos, como procesamiento por lotes y servicios escalables horizontalmente.

En producción, un enfoque híbrido (Spot más una capacidad base on-demand) ayuda a equilibrar ahorro y confiabilidad.

3. Implementa gobernanza automatizada

La gobernanza automatizada brinda un control de costos continuo mediante policy-as-code y controles en tiempo de ejecución a lo largo del ciclo de vida de Kubernetes.

- Exigir requests y limits para todos los workloads

- Forzar el uso de clases de almacenamiento según los requisitos del workload

- Imponer etiquetas para asignación de costos y propiedad

- Apagar o reducir automáticamente los entornos de desarrollo fuera de horario

Herramientas como CloudFlow de DoiT ayudan a aplicar políticas, evitar la creación de recursos no conformes y mantener la disciplina de costos en todos los equipos.

4. Aplica monitoreo granular

La optimización de costos exige visibilidad sobre los patrones de consumo. Un monitoreo eficaz suele incluir:

- Métricas de utilización a nivel de pod

- Estadísticas de eficiencia por nodo

- Asignación de costos por namespace y por etiqueta

- Tendencias históricas y detección de anomalías

Esa granularidad permite encontrar oportunidades de optimización y atribuir costos a equipos, proyectos o aplicaciones. Muchos entornos sufren de un etiquetado incompleto, lo que reduce la precisión. Las herramientas de facturación nativas de la nube suelen no contar con detalle específico de Kubernetes, así que casi siempre se necesita una herramienta Kubernetes-aware.

Las soluciones de monitoreo más efectivas se integran con los stacks de observabilidad existentes y aportan insights de costos específicos de Kubernetes (asignación, eficiencia y recomendaciones).

5. Aplica técnicas de escalado de pods

El escalado de pods complementa al right-sizing y mejora la utilización. Usa HPA con métricas que reflejen la demanda real del workload (muchas veces, profundidad de cola, latencia o throughput, más que CPU solamente). No todos los workloads se benefician del HPA: los servicios con estado y las apps de arranque lento pueden requerir enfoques alternativos.

Configura el Cluster Autoscaler con cuidado para que el comportamiento de scale-up y scale-down de los nodos coincida con la realidad de tus workloads (tiempo de calentamiento, restricciones de planificación y requisitos de disrupción).

Para patrones predecibles, el escalado programado puede ajustar la capacidad antes de que cambie la demanda, sobre todo en workloads de horario laboral o de procesamiento por lotes.

Por qué importa la optimización de costos en Kubernetes

Más allá de los beneficios financieros evidentes, la optimización de costos en Kubernetes ofrece ventajas estratégicas. Una utilización eficiente reduce la contención y favorece un escalado más predecible. Además, puede mejorar la sostenibilidad al bajar el consumo energético.

La mitigación de riesgos es otra ventaja crítica. El right-sizing y una asignación adecuada reducen la probabilidad de excederse en cuotas y de quedarse sin recursos, sobre todo en entornos compartidos. Esto ayuda a prevenir CPU throttling, OOMKills y pods que no se pueden planificar por capacidad agotada del cluster.

Los entornos de Kubernetes bien optimizados también permiten entregar más rápido. Cuando los equipos entienden con precisión las necesidades de recursos, pueden diseñar pipelines de CI/CD más limpios, reducir la incertidumbre y simplificar las aprobaciones, lo que aporta agilidad al negocio.

Y quizá lo más importante: mantener bajo control los costos de Kubernetes mejora el forecasting. Los equipos de finanzas ganan confianza con métricas de unit economics y modelos predecibles de chargeback/showback, mientras que los equipos de Engineering ganan libertad para innovar sin disparar gastos inesperados.

Posibles obstáculos para reducir los costos de Kubernetes

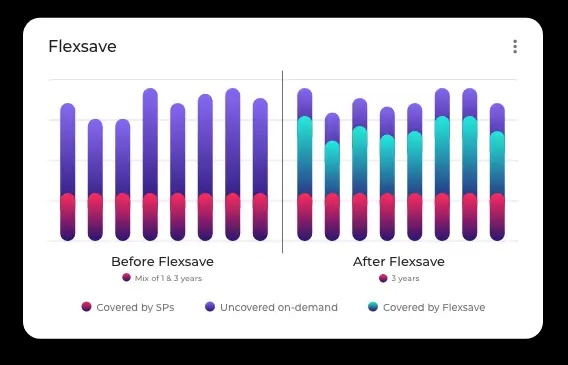

Gráficos de antes y después de la implementación de Flexsave

Gráficos de antes y después de la implementación de Flexsave

Las organizaciones suelen enfrentar varios desafíos al optimizar los costos de Kubernetes. La complejidad técnica puede ser una barrera, ya que la optimización requiere experiencia en comportamiento de scheduling, autoscaling y observabilidad de costos.

La coordinación entre equipos también puede ser difícil. Una optimización efectiva requiere colaboración entre finanzas, Engineering y operaciones, áreas que muchas veces tienen incentivos distintos.

La resistencia al cambio puede aparecer cuando los equipos temen que la optimización afecte la confiabilidad. La educación es clave: una buena optimización de costos suele mejorar la confiabilidad al evitar problemas de "vecinos ruidosos" y la contención de recursos.

La visibilidad de costos es un reto persistente, porque Kubernetes no incluye seguimiento de costos integrado por defecto. Muchas organizaciones despliegan clusters sin planificar la atribución de costos y luego luchan por unir métricas, etiquetas y datos de facturación. Integrar las señales de costo en los flujos de trabajo diarios ayuda a los equipos a tomar decisiones conscientes del costo desde el día uno.

Por último, muchas organizaciones tienen problemas con la sostenibilidad. Los esfuerzos puntuales pueden generar ahorros, pero sin gobernanza ni rendición de cuentas continuas, los costos suelen volver a subir.

Herramientas para optimizar y monitorear los costos de Kubernetes

Una optimización efectiva de costos en Kubernetes requiere herramientas que monitoreen, analicen y ayuden a gestionar el uso de los recursos.

1. DoiT

DoiT ofrece capacidades de optimización de costos de Kubernetes a través de su plataforma. Flexsave for Kubernetes ofrece una optimización inteligente que reduce costos sin sacrificar rendimiento ni disponibilidad.

La plataforma analiza los patrones de consumo y entrega recomendaciones y automatización específicas de Kubernetes, lo que favorece una mejor alineación entre los equipos de finanzas y de Engineering.

Trax, por ejemplo, ahorró un 75 % en su gasto de Kubernetes con PerfectScale by DoiT. DoiT también ayuda a correlacionar el gasto en Kubernetes con resultados de negocio y unit economics.

2. AWS Cost Explorer

Para Kubernetes en AWS (incluyendo EKS), AWS Cost Explorer brinda visibilidad sobre el gasto relacionado con contenedores cuando el etiquetado y la asignación están bien configurados.

Aunque no es nativo de Kubernetes, Cost Explorer permite identificar tendencias y anomalías en el gasto de EKS. Combinado con AWS Compute Optimizer, puede apoyar el right-sizing de instancias para los node groups.

3. Azure Cost Management + Billing

Azure Cost Management permite hacer seguimiento de costos de AKS mediante etiquetado, agrupación y presupuestos. Container insights mejora constantemente, pero las recomendaciones y la asignación a menudo requieren configuración adicional y un etiquetado disciplinado.

4. GKE Usage Metering

Google Cloud admite la atribución a nivel de namespace mediante GKE usage metering, que aporta una visibilidad más granular que los reportes de facturación estándar.

Combinado con las recomendaciones de Google Cloud, ayuda a detectar oportunidades de optimización a partir de los patrones de uso.

KPIs estilo FinOps para el control de costos en Kubernetes

Para sostener la optimización de costos, mide KPIs que conecten las decisiones técnicas con el gasto:

- Eficiencia del cluster: CPU/memoria solicitada vs. usada en los namespaces

- Eficiencia del workload: alineación de request/limit y eventos de throttling/OOM

- Pérdida por inactividad: nodos sin uso, namespaces vacíos, PVCs y load balancers huérfanos

- Efectividad del autoscaling: eventos de escalado vs. impacto en SLO

- Costo unitario: costo por request, job, cliente o salida del workload

Preguntas frecuentes sobre optimización de costos en Kubernetes

¿Cómo reduzco los costos de Kubernetes sin afectar el rendimiento?

Empieza por medir: aplica right-sizing a los requests con base en el uso real, habilita autoscaling y elimina los recursos inactivos. Aplica cambios graduales (modo recomendación de VPA, despliegues por etapas) y monitorea los SLOs para que el rendimiento se mantenga estable.

¿Cuál es la forma más rápida de bajar los costos de Kubernetes?

Las victorias rápidas suelen venir de corregir requests inflados, apagar clusters no productivos inactivos, eliminar almacenamiento huérfano e implementar cluster autoscaling con restricciones razonables.

¿Qué herramientas ayudan con la asignación de costos en Kubernetes?

Las herramientas Kubernetes-aware que aprovechan la asignación por namespace y etiquetas son las más útiles. Las herramientas de facturación de la nube solo ayudan cuando tu estrategia de tagging/labeling es consistente y está integrada con los metadatos del cluster.

¿Las instancias Spot son seguras para Kubernetes?

Sí, para workloads tolerantes a interrupciones. Usa pod disruption budgets, taints/tolerations en los nodos, manejo de terminación elegante y una base de nodos on-demand para los servicios críticos.

Próximos pasos para un gasto sostenible en Kubernetes

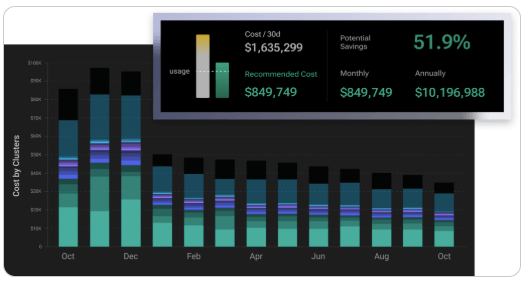

Gráfico de costos decrecientes con K8s

Gráfico de costos decrecientes con K8s

Implementar una optimización sostenible requiere un enfoque estructurado. Empieza por establecer una línea base del gasto actual de Kubernetes por cluster, namespace y aplicación. Esa línea base permite medir el avance.

Prioriza victorias rápidas, como limpiar recursos inactivos y aplicar políticas básicas de gobernanza. Esa inercia inicial ayuda a que los equipos adopten optimizaciones más avanzadas, como el ajuste del autoscaling y mejoras de eficiencia específicas por workload.

Forma un grupo multidisciplinario de optimización de costos con representantes de finanzas, Engineering y operaciones. La colaboración asegura que las decisiones técnicas se alineen con los objetivos financieros sin sacrificar la confiabilidad.

Por último, establece ciclos recurrentes de revisión. Los entornos de Kubernetes evolucionan de forma continua, así que la optimización de costos debe ser un proceso permanente, no un proyecto puntual.

¿Quieres profundizar más? Descarga nuestra FinOps Guide to Kubernetes Costs and Complexity y aprende a presupuestar de forma estratégica para operaciones escalables en Kubernetes.