O Kubernetes virou a plataforma padrão para orquestração de contêineres, facilitando o deploy, a escalabilidade e o gerenciamento de aplicações conteinerizadas na nuvem. Só que, junto com esse poder, vem a complexidade — e, muitas vezes, custos inesperados causados por nós subutilizados, vertical pod autoscaling mal ajustado, configurações ineficientes de requests/limits ou workloads ociosos rodando há tempo demais. A observabilidade de custos no Kubernetes é fragmentada, e a visibilidade entre clusters ou namespaces dificilmente vem de forma nativa sem ferramentas adicionais.

Sem uma estratégia clara de otimização, é fácil ver os gastos com Kubernetes saírem do controle. Custos altos no Kubernetes geralmente têm origem em problemas arquiteturais e operacionais bem específicos: node pools superdimensionados em relação à demanda real dos workloads, bin-packing ineficiente de pods entre nós (que deixa capacidade computacional valiosa ociosa) e a ausência de mecanismos de autoscaling (como Horizontal Pod Autoscaler, Vertical Pod Autoscaler ou Cluster Autoscaler) que ajustariam recursos dinamicamente conforme o uso.

Por isso, ser proativo e olhar de perto para os gastos com Kubernetes ajuda a controlar custos e maximizar o ROI. Este artigo traz dicas práticas e ferramentas para que as equipes assumam o controle dos workloads e dos gastos com Kubernetes sem comprometer a operação.

Respostas rápidas: otimização de custos no Kubernetes

**O que é otimização de custos no Kubernetes?**Otimização de custos no Kubernetes é a prática de reduzir o gasto com clusters por meio de mais eficiência de recursos, right-sizing de requests e limits, escalonamento dinâmico de nós e pods e eliminação de infraestrutura ociosa.**O que provoca custos altos no Kubernetes?**As causas mais comuns são node pools superdimensionados, requests de pods inflados, bin-packing ruim, armazenamento sem uso, clusters ociosos e egress de rede inesperado.**Como reduzir custos no Kubernetes rapidamente?**Comece ajustando requests/limits, limpando recursos ociosos, agendando clusters não produtivos, habilitando autoscaling e usando computação com desconto (Spot/preemptível) para workloads resilientes.

Quais fatores tornam necessária a otimização de custos no Kubernetes?

Sem uma boa gestão, ambientes Kubernetes podem se transformar em grandes centros de custo. Vários fatores contribuem para essas despesas:

A ineficiência de recursos computacionais costuma encabeçar a lista de preocupações. Sem right-sizing, muitas organizações superdimensionam CPU e memória para evitar problemas de performance, o que se traduz em baixa utilização e desperdício de recursos em nuvem. Pesquisas mostram que mais de 65% dos workloads Kubernetes usam menos da metade da CPU e memória solicitadas. Isso acontece, principalmente, porque os requests de recursos ficam superdimensionados em relação aos limits e ao uso real. O scheduler do Kubernetes se baseia nos requests — não no uso real — para decidir o posicionamento dos pods. Quando os requests estão inflados, o bin-packing fica ruim e a quantidade de nós cresce sem necessidade.

Os custos de armazenamento podem disparar rapidamente em ambientes Kubernetes na nuvem. Volumes persistentes (especialmente classes de armazenamento premium) ganham peso à medida que os dados das aplicações crescem. Outros vilões comuns são PVCs retidos após a exclusão de pods e retenção excessiva de snapshots/backups. Otimizar armazenamento normalmente exige sintonia entre as equipes de infraestrutura e de aplicação, sobretudo em workloads stateful, em que decisões sobre dados afetam performance e gastos.

As despesas de rede são outro fator de custo, especialmente em deployments multirregião ou híbridos. A transferência de dados entre zonas, regiões e serviços externos pode gerar cobranças relevantes que costumam passar despercebidas no planejamento inicial da arquitetura.

Recursos ociosos também representam uma grande fonte de desperdício. Clusters de desenvolvimento e teste rodando fora do horário, volumes persistentes esquecidos e load balancers sem uso somam custos desnecessários. Sem governança, esses recursos vão se acumulando e elevam o gasto total com Kubernetes.

Principais estratégias para reduzir seus custos no Kubernetes

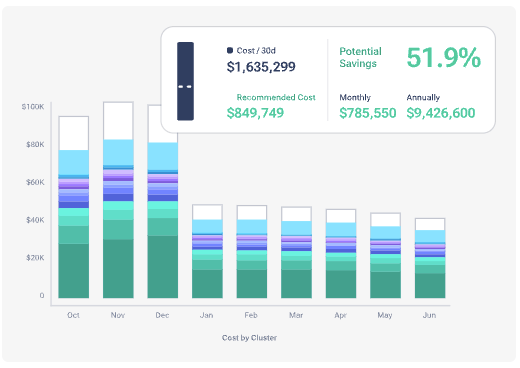

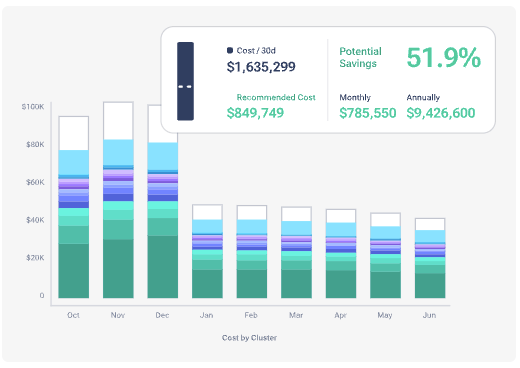

Gráfico de cluster de custos mostrando potencial de economia

Gráfico de cluster de custos mostrando potencial de economia

Entender como esses fatores se conectam é fundamental para montar uma arquitetura Kubernetes com bom custo-benefício e ganhar eficiência financeira. Veja, a seguir, estratégias que você pode aplicar para reduzir custos no Kubernetes.

1. Faça right-sizing dos recursos dos nós

O right-sizing é uma das estratégias de maior impacto para reduzir despesas com Kubernetes. O agendamento no Kubernetes é guiado pelos recursos solicitados, então requests inflados acabam forçando uma quantidade maior de nós, mesmo quando o uso real é baixo.

Comece analisando o histórico de utilização entre os clusters. Identifique pods que, de forma consistente, usam bem menos CPU ou memória do que solicitam. Muitas organizações conseguem reduzir requests sem mexer na performance, o que permite rodar mais workloads nos nós existentes.

Defina cotas de recursos no nível do namespace para evitar uso descontrolado e estabelecer limites claros para as equipes. As cotas também ajudam a conter picos inesperados de custo que disparam escalonamentos desnecessários.

Aplique políticas de requests/limits. Use ferramentas de enforcement (como o Gatekeeper) para garantir que todo workload especifique os dois. Os requests definem o agendamento e impactam os custos de computação, enquanto os limits evitam vizinhos barulhentos e instabilidade. Sem requests adequados, o Kubernetes não consegue fazer bin-packing eficiente, o que leva a nós subutilizados e desperdício.

Considere usar o Vertical Pod Autoscaler (VPA) primeiro em modo de recomendação. Ele oferece uma orientação segura, com base em padrões de uso, antes de você partir para a automação. Combine o VPA com o Horizontal Pod Autoscaler (HPA) quando fizer sentido — só fique atento: eles podem entrar em conflito quando miram os mesmos sinais de CPU/memória, então ajuste com cuidado.

2. Use Spot Instances

As Spot Instances (ou VMs preemptíveis no Google Cloud) podem reduzir bastante os custos de computação ao aproveitarem capacidade ociosa. Como podem ser recuperadas com pouco aviso, os workloads precisam tolerar interrupções.

Use pod disruption budgets, taints/tolerations e regras de node affinity para rodar com segurança workloads elegíveis em nós Spot. Priorize workloads stateless e tolerantes a falhas, como processamento em batch e serviços com escalonamento horizontal.

Em produção, uma abordagem híbrida (Spot somado a uma capacidade base on-demand) ajuda a equilibrar economia e confiabilidade.

3. Implemente governança automatizada

A governança automatizada oferece controle contínuo de custos por meio de policy-as-code e controles em runtime ao longo de todo o ciclo de vida do Kubernetes.

- Exigir requests e limits para todos os workloads

- Aplicar regras de uso de classes de armazenamento conforme os requisitos do workload

- Tornar obrigatórios os labels para alocação de custos e definição de owners

- Desligar ou reduzir automaticamente ambientes de desenvolvimento fora do horário comercial

Ferramentas como o CloudFlow da DoiT ajudam a aplicar políticas, impedir a criação de recursos não conformes e manter a disciplina de custos entre as equipes.

4. Adote monitoramento granular

A otimização de custos exige visibilidade dos padrões de consumo. Um monitoramento eficaz costuma incluir:

- Métricas de utilização no nível do pod

- Estatísticas de eficiência por nó

- Alocação de custos por namespace e por label

- Análise histórica e detecção de anomalias

Essa granularidade ajuda a identificar oportunidades de otimização e a atribuir custos a equipes, projetos ou aplicações. Muitos ambientes sofrem com labels incompletos, o que prejudica a precisão. As ferramentas nativas de billing da nuvem normalmente não trazem o detalhamento específico do Kubernetes, então é comum precisar de tooling Kubernetes-aware.

As soluções de monitoramento mais eficazes se integram às stacks de observabilidade existentes e, ao mesmo tempo, entregam insights de custo de Kubernetes (alocação, eficiência e recomendações).

5. Aplique técnicas de scaling de pods

O scaling de pods complementa o right-sizing e melhora a utilização. Use o HPA com base em métricas que reflitam a demanda real do workload (em geral, profundidade de fila, latência ou throughput, e não só CPU). Nem todo workload se beneficia do HPA — serviços stateful e apps com inicialização lenta podem precisar de outras abordagens.

Configure o Cluster Autoscaler com cuidado para que o comportamento de scale-up e scale-down dos nós condiga com a realidade dos workloads (tempo de warm-up, restrições de agendamento e requisitos de disrupção).

Para padrões previsíveis, o scaling agendado pode ajustar a capacidade de forma preventiva, antes das mudanças de demanda — algo útil principalmente para workloads de horário comercial ou processamento em batch.

Por que a otimização de custos no Kubernetes importa

Além dos benefícios financeiros mais óbvios, a otimização de custos no Kubernetes traz vantagens estratégicas. Uma utilização eficiente reduz contenção e dá suporte a um escalonamento mais previsível. E ainda pode contribuir para a sustentabilidade ao reduzir o consumo de energia.

A mitigação de risco é outra vantagem importante. Right-sizing e alocação adequada reduzem a chance de estouro de cotas e de starvation de recursos, principalmente em ambientes compartilhados. Isso ajuda a prevenir CPU throttling, OOMKills e pods que ficam sem agendamento por capacidade esgotada do cluster.

Ambientes Kubernetes bem otimizados também sustentam entregas mais rápidas. Quando as equipes entendem com precisão suas necessidades de recursos, conseguem desenhar pipelines de CI/CD mais limpos, reduzir incertezas e simplificar aprovações — tudo isso favorece a agilidade do negócio.

E talvez o mais importante: manter os custos de Kubernetes sob controle melhora a previsibilidade. As equipes de finanças ganham confiança com unit economics e modelos previsíveis de chargeback/showback, enquanto a engenharia ganha liberdade para inovar sem disparar gastos inesperados.

Possíveis obstáculos para reduzir seus custos no Kubernetes

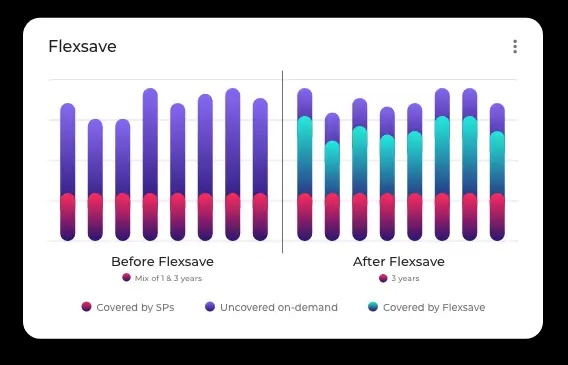

Gráficos de antes e depois da implementação do Flexsave

Gráficos de antes e depois da implementação do Flexsave

As organizações costumam esbarrar em desafios ao otimizar custos no Kubernetes. A complexidade técnica é uma barreira: a otimização exige expertise em comportamento do scheduler, autoscaling e observabilidade de custos.

A coordenação entre equipes também pode ser difícil. Uma otimização eficaz exige colaboração entre finanças, engenharia e operações — áreas que muitas vezes têm incentivos diferentes.

Pode surgir resistência à mudança quando as equipes temem que a otimização afete a confiabilidade. A educação é essencial: uma boa otimização de custos costuma melhorar a confiabilidade, evitando problemas de vizinho barulhento e contenção de recursos.

A visibilidade de custos é um desafio recorrente, já que o Kubernetes não traz rastreamento de custos por padrão. Muitas organizações criam clusters sem planejar a atribuição de custos e depois penam para juntar métricas, labels e dados de billing. Integrar sinais de custo aos fluxos de trabalho diários ajuda as equipes a tomarem decisões com consciência de custo desde o primeiro dia.

Por fim, muitas organizações têm dificuldade em sustentar os ganhos. Esforços pontuais geram economia, mas, sem governança e accountability contínuos, os custos tendem a voltar a subir.

Ferramentas para otimização e monitoramento de custos no Kubernetes

Uma otimização eficaz de custos no Kubernetes exige ferramentas que monitorem, analisem e ajudem a gerenciar o uso de recursos.

1. DoiT

A DoiT oferece recursos de otimização de custos no Kubernetes pela sua plataforma. O Flexsave for Kubernetes sustenta uma otimização inteligente, que reduz custos sem abrir mão de performance e disponibilidade.

A plataforma analisa padrões de consumo e entrega recomendações e automações específicas para Kubernetes, favorecendo o alinhamento entre as equipes de finanças e engenharia.

A Trax, por exemplo, economizou 75% no gasto com Kubernetes usando o PerfectScale by DoiT. A DoiT também ajuda a correlacionar gastos com Kubernetes a resultados de negócio e unit economics.

2. AWS Cost Explorer

Para Kubernetes na AWS (incluindo o EKS), o AWS Cost Explorer oferece visibilidade dos gastos relacionados a contêineres quando o tagging e a alocação estão configurados corretamente.

Embora não seja cloud-native para Kubernetes, o Cost Explorer consegue identificar tendências e anomalias no gasto com EKS. Combinado com o AWS Compute Optimizer, ajuda no right-sizing de instâncias dos node groups.

3. Azure Cost Management + Billing

O Azure Cost Management dá suporte ao acompanhamento de custos no AKS via tagging, agrupamento e budgets. Os container insights vêm evoluindo, mas recomendações e alocação muitas vezes exigem configuração extra e disciplina nos labels.

4. GKE Usage Metering

O Google Cloud oferece atribuição no nível de namespace via GKE usage metering, com uma visibilidade mais granular do que a dos relatórios de billing padrão.

Combinado com as recomendações do Google Cloud, ajuda a identificar oportunidades de otimização com base nos padrões de uso.

KPIs no estilo FinOps para controle de custos no Kubernetes

Para sustentar a otimização de custos, acompanhe KPIs que conectam decisões técnicas ao gasto:

- Eficiência do cluster: CPU/memória solicitados vs. usados entre namespaces

- Eficiência do workload: alinhamento entre request/limit e eventos de throttling/OOM

- Desperdício ocioso: nós sem uso, namespaces vazios, PVCs órfãos e load balancers

- Eficácia do autoscaling: eventos de scaling vs. impacto em SLO

- Custo unitário: custo por requisição, job, cliente ou saída de workload

FAQ sobre otimização de custos no Kubernetes

Como reduzir custos no Kubernetes sem prejudicar a performance?

Comece pela mensuração: faça right-sizing dos requests com base no uso real, habilite autoscaling e remova recursos ociosos. Adote mudanças graduais (modo de recomendação do VPA, rollouts em estágios) e acompanhe os SLOs para garantir que a performance se mantenha estável.

Qual é a forma mais rápida de reduzir custos no Kubernetes?

Os ganhos mais rápidos costumam vir de ajustar requests inflados, desligar clusters não produtivos ociosos, remover armazenamento órfão e implementar cluster autoscaling com restrições adequadas.

Quais ferramentas ajudam na alocação de custos no Kubernetes?

As que mais ajudam são as ferramentas Kubernetes-aware que usam alocação por namespace e label. As ferramentas de billing da nuvem só ajudam quando sua estratégia de tagging/labeling é consistente e está integrada aos metadados do cluster.

Spot Instances são seguras para Kubernetes?

Sim, para workloads tolerantes a interrupções. Use pod disruption budgets, taints/tolerations nos nós, tratamento de terminação graciosa e uma base de nós on-demand para serviços críticos.

Próximos passos para um gasto sustentável com Kubernetes

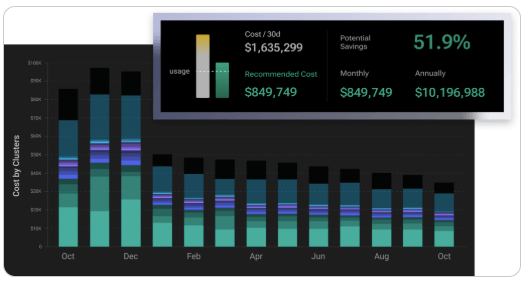

Gráfico mostrando redução de custos com K8s

Gráfico mostrando redução de custos com K8s

Implementar uma otimização sustentável exige uma abordagem estruturada. Comece definindo um baseline do gasto atual com Kubernetes por cluster, namespace e aplicação. Esse baseline torna o progresso mensurável.

Priorize ganhos rápidos, como limpar recursos ociosos e aplicar políticas básicas de governança. Esse impulso inicial ajuda as equipes a adotarem otimizações mais avançadas, como ajuste fino de autoscaling e melhorias de eficiência específicas por workload.

Forme um grupo multidisciplinar de otimização de custos com stakeholders de finanças, engenharia e operações. A colaboração garante que as decisões técnicas se alinhem aos objetivos financeiros sem sacrificar a confiabilidade.

Por fim, estabeleça ciclos recorrentes de revisão. Ambientes Kubernetes evoluem o tempo todo, então a otimização de custos precisa ser contínua — e não um projeto pontual.

Quer se aprofundar? Baixe nosso FinOps Guide to Kubernetes Costs and Complexity e descubra como orçar de forma estratégica para operações escaláveis em Kubernetes.