L'optimisation des coûts cloud va aujourd'hui bien au-delà de simples recommandations de rightsizing. À mesure que les organisations étoffent leurs déploiements Google Cloud, l'enjeu se déplace : il ne s'agit plus seulement de repérer les inefficacités évidentes, mais de comprendre comment les objectifs des workloads, la conception de l'infrastructure et les coûts s'articulent. Les approches FinOps traditionnelles tombent souvent dans ce que nous appelons l'illusion d'efficacité : des métriques de surface comme l'utilisation CPU laissent croire à des performances optimales tout en masquant un gaspillage architectural plus profond.

Cette illusion vient du fait que la supervision traditionnelle se concentre sur les métriques d'infrastructure plutôt que sur les résultats des workloads. Prenons un job BigQuery affichant 90 % d'utilisation des slots : il semble efficace, jusqu'à ce que l'on découvre qu'il scanne des tables entières faute de partitionnement, consommant inutilement du compute. Autre cas : un cluster Kubernetes avec une utilisation CPU élevée peut paraître bien optimisé alors que ses pods s'accumulent en file d'attente à cause de contraintes mémoire ou d'une mauvaise allocation des ressources.

Ces scénarios (parmi d'autres) créent un faux sentiment d'efficacité, où une infrastructure très sollicitée masque des problèmes de conception qui pèsent réellement sur les coûts.

Contrairement au FinOps classique qui s'appuie sur des métriques d'utilisation génériques, l'optimisation guidée par l'intention prend en compte la finalité de chaque workload. Un job d'entraînement de machine learning peut par exemple sembler sous-utilisé durant la phase de prétraitement des données alors qu'il fonctionne en réalité de manière optimale pour cette étape du pipeline.

Que vous gériez des applications sensibles à la latence nécessitant une capacité supplémentaire pour respecter vos SLA, que vous garantissiez des mécanismes de failover via une infrastructure redondante ou que vous privilégiiez la vélocité des développeurs aux économies, vos opérations cloud doivent s'adapter à chaque contexte. Les stratégies qui suivent vous aideront à bâtir une approche durable de la gestion des coûts cloud sur Google Cloud, capable d'évoluer avec votre organisation.

Réponses rapides : FinOps Google Cloud

**Qu'est-ce que le FinOps Google Cloud ?**Le FinOps Google Cloud est un modèle opérationnel qui aide les équipes finance, engineering et métier à partager la responsabilité des dépenses Google Cloud, via la visibilité, l'optimisation et une gouvernance continue.**Quel est le moyen le plus rapide d'identifier le gaspillage sur Google Cloud ?**Commencez par une allocation des coûts précise (labels/projets), puis examinez les commitments et les ressources inactives. Ciblez ensuite les sources de gaspillage propres à chaque service : BigQuery, GKE, Cloud Run et l'ingestion logs/monitoring.**Qu'est-ce que l'illusion d'efficacité en FinOps ?**C'est lorsque l'utilisation paraît bonne (compute sollicité, slots élevés, CPU élevé) alors que le workload continue de gaspiller des ressources à cause de problèmes architecturaux : scans BigQuery non partitionnés, requests/limits GKE mal réglés ou concurrence mal calibrée.

Qu'est-ce que le FinOps Google Cloud ?

Le FinOps Google Cloud est un cadre opérationnel qui instaure une responsabilité financière sur les dépenses cloud, grâce à une collaboration transverse entre les équipes engineering, finance et métier. Au lieu de subir et de traiter l'optimisation des coûts après coup, le FinOps mise sur des pratiques proactives pour comprendre, suivre et optimiser les dépenses cloud en continu.

Selon la FinOps Foundation, la discipline s'articule autour de trois phases clés :

- Inform : visibilité sur les schémas de dépense

- Optimize : réduction des coûts et améliorations de conception concrètes

- Operate : gouvernance et responsabilité dans la durée

Dans l'écosystème Google Cloud, cela passe par les outils natifs comme Cloud Billing, Cloud Asset Inventory et la Recommender API, en complément de plateformes spécialisées comme DoiT pour des analyses plus fines, propres à chaque workload.

Qu'est-ce que le FinOps Score sur Google Cloud ?

Le FinOps score de Google Cloud permet d'évaluer la maturité de votre organisation en matière d'optimisation des coûts sur différents axes. Il reflète l'adoption des bonnes pratiques recommandées (couverture des commitments, nettoyage des ressources inactives, complétude de la configuration des alertes budgétaires, etc.). Vous pouvez l'utiliser comme référence pour vos revues d'optimisation trimestrielles.

Cela dit, le score natif s'appuie sur des bonnes pratiques généralisées et passe parfois à côté de l'intention du workload. Un job d'entraînement de machine learning peut sembler sous-utilisé pendant le prétraitement, tout en fonctionnant de manière optimale pour cette étape du pipeline. D'où l'importance de l'analyse guidée par l'intention pour juger de l'efficacité réelle.

Pourquoi le FinOps est essentiel sur Google Cloud

Le modèle tarifaire de Google Cloud récompense la planification stratégique grâce aux committed use discounts, sustained use discounts et instances préemptibles. Mais pour en tirer pleinement parti, il faut anticiper la demande et analyser ses workloads. Les organisations qui mettent en place des pratiques FinOps structurées constatent souvent des réductions de coûts dès la première année, non seulement par redimensionnement, mais aussi grâce à des améliorations architecturales qui éliminent le gaspillage à la racine.

Les services Google Cloud présentent des défis d'optimisation bien spécifiques. La tarification au slot de BigQuery rend le coût très dépendant de la structure des données et de la stratégie de partitionnement. La facturation à la requête de Cloud Run transforme la concurrence et les instances minimales en exercice d'arbitrage coût/performance, où les démarrages à froid peuvent affecter à la fois l'expérience utilisateur et la facture.

Ces modèles tarifaires font passer l'optimisation du dimensionner la machine au concevoir le workload. Sans processus FinOps solides, les équipes engineering surdimensionnent souvent les ressources pour réduire le risque de performance, tandis que les équipes finance manquent du contexte technique nécessaire pour identifier les leviers à plus fort impact.

Principes essentiels du FinOps Google Cloud

Un FinOps Google Cloud réussi repose sur des principes qui distinguent les pratiques matures des coupes budgétaires improvisées.

Les insights de coûts en temps réel constituent l'épine dorsale de tout programme efficace. En pratique, le temps réel correspond souvent à une attribution horaire ou quotidienne, car les données de facturation arrivent avec un délai inhérent. L'essentiel est une collecte automatisée qui relie les dépenses à la finalité des workloads et aux résultats métier — pas seulement à l'utilisation.

La responsabilisation des parties prenantes fait de l'optimisation des coûts une affaire collective. Les équipes engineering doivent voir l'impact de leurs choix d'architecture sur les coûts, tandis que les unités métier doivent relier les dépenses aux revenus, aux clients ou aux initiatives stratégiques.

La collaboration transverse brise les silos. Lorsque les ingénieurs storage comprennent comment la rétention pèse sur les coûts d'analytics, et que les développeurs saisissent l'impact de leurs choix de code sur la facturation Cloud Functions ou Cloud Run, l'optimisation devient le résultat naturel de décisions éclairées.

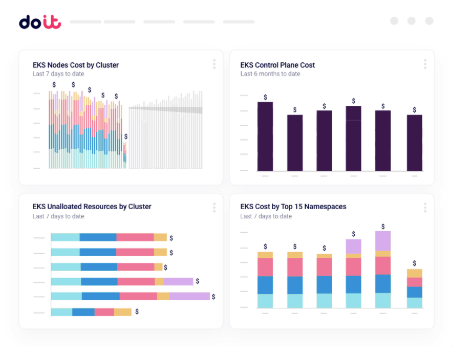

Quelles métriques FinOps suivre ?

Suivre les bonnes métriques permet de gagner en visibilité sur les dépenses Google Cloud et de piloter une optimisation pertinente.

Précision de l'allocation des coûts

Une allocation des coûts précise est le socle d'une gouvernance efficace. Le système de labels et la structure de projets Google Cloud doivent refléter fidèlement votre organisation pour permettre le showback/chargeback et la responsabilisation.

Mettez en place des labels obligatoires (environnement, équipe, application, centre de coûts) sur l'ensemble des ressources. Exploitez des rapports automatisés dans BigQuery pour suivre les dépenses par label et vérifier la complétude chaque mois. Utilisez Cloud Asset Inventory pour valider la couverture des labels à grande échelle et publiez chaque semaine un taux de ressources non taguées par service, en visant 95 % et plus de ressources taguées.

Sans précision d'allocation, les dépenses cloud se résument à une seule ligne opaque, ce qui empêche l'optimisation et fragilise la responsabilisation.

Taux d'utilisation et métriques d'efficacité

L'utilisation CPU, mémoire et stockage ne sont que des signaux d'efficacité de surface. L'optimisation guidée par l'intention évalue si les workloads atteignent leurs objectifs de performance au juste coût, en tenant compte d'exigences comme la latence, le failover ou les fenêtres de batch.

Un cluster Kubernetes à 40 % de CPU moyen, par exemple, peut sembler inefficace jusqu'à ce que l'on confirme qu'il s'agit d'une marge de manœuvre intentionnelle pour absorber les pics et tenir les engagements SLA. Dans ce cas, la capacité inutilisée est un choix de conception — pas du gaspillage.

Couverture des commitments et optimisation des remises

Les committed use discounts (CUDs) et les sustained use discounts exigent un travail de prévision. Suivez la couverture et l'utilisation par type de ressource, région et période, et démarrez prudemment (souvent 70 %–80 % du baseline) dans les environnements dynamiques pour limiter le risque de surengagement.

Utilisez Active Assist et la Recommender API pour identifier les VM systématiquement sous-utilisées et examinez-les avec l'engineering en vue d'un right-sizing ou d'un décommissionnement. Si l'utilisation des commitments tombe sous ~85 % pendant plusieurs semaines, réévaluez les achats à venir et redéployez des workloads pour mieux exploiter les commitments existants.

Coût par unité métier et par application

Reliez les dépenses aux résultats métier en suivant le coût par client, par transaction, par requête ou par dollar de revenu. C'est ce qui permet de justifier l'investissement cloud et d'arbitrer entre développement de fonctionnalités et évolutions d'infrastructure.

Automatisez le reporting qui relie les signaux de performance applicative aux coûts cloud, afin que les équipes identifient les applications qui délivrent le plus de valeur tout en maintenant la discipline financière.

Détection des anomalies et écarts budgétaires

La détection automatisée des anomalies signale les pics de coûts inattendus avant qu'ils n'impactent les budgets mensuels. Les alertes budgétaires Google Cloud sont utiles, mais un FinOps mature y ajoute un contexte prédictif : saisonnalité, lancements planifiés, workloads batch attendus.

Définissez des règles d'escalade : alerte immédiate pour tout pic non planifié dépassant 20 % de la moyenne quotidienne, ou toute hausse sans activité métier correspondante. Traitez les pics liés à un scaling normal comme des cas à surveiller et confirmer, pas nécessairement à annuler, et recoupez toujours avec votre calendrier de changements.

Configurez des alertes dans Google Cloud Billing et désignez un analyste finance et un responsable engineering pour examiner et répondre conjointement.

5 clés pour réussir votre FinOps Google Cloud

Réussir son FinOps Google Cloud demande une stratégie qui combine pilotage financier et opérations techniques.

1. Taguez vos ressources efficacement

Un tagging des ressources exhaustif permet une analyse granulaire et une optimisation automatisée. Adoptez un labeling hiérarchique aligné sur la structure organisationnelle et la taxonomie applicative. Les catégories de labels courantes incluent l'environnement, l'équipe, l'ID applicatif et le centre de coûts.

Utilisez Organization Policy lorsque c'est possible pour bloquer la création de ressources non taguées, sachant que l'application varie selon le service. Pour les services sans application stricte, configurez des alertes Cloud Asset Inventory pour les ressources nouvellement créées sans tag et menez des audits mensuels pour les corriger.

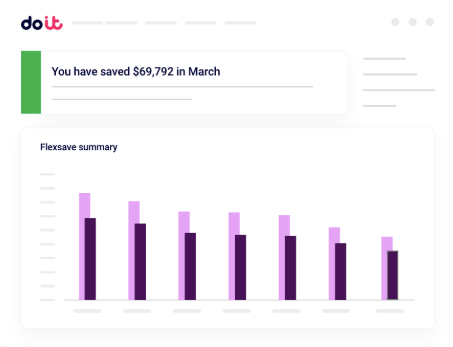

2. Adoptez les commitments et les remises

Les committed use discounts peuvent générer d'importantes économies sur les workloads prévisibles, mais ils exigent une bonne prévision pour éviter les pénalités de surengagement.

Analysez l'usage par type de ressource, région et période. Surveillez les indicateurs de risque : usage tombant sous 80 % de la capacité engagée pendant deux mois consécutifs, projets en fin de vie, ou changements architecturaux majeurs. Commencez par des commitments de courte durée et allongez-les à mesure que la prévision s'affine. Réévaluez vos commitments chaque trimestre pour vous adapter aux évolutions de la demande.

Faire les premiers pas vers les économies cloud implique de trouver l'équilibre entre réductions immédiates et flexibilité opérationnelle.

3. Organisez des revues transverses régulières

Tenez des revues mensuelles avec les équipes engineering, finance et métier. Concentrez-vous sur l'analyse des tendances, l'utilisation des commitments et les actions d'optimisation qui exigent une coordination transverse.

Créez des dashboards standardisés (Looker ou FinOps Hub par exemple) pour traduire les métriques techniques en termes métier. Mobiliser des Engineers déjà très sollicités est plus simple lorsque l'optimisation est présentée comme un levier de fiabilité et de performance — et pas seulement comme une réduction de coûts.

4. Automatisez le nettoyage des ressources inactives

Mettez en place une automatisation du cycle de vie pour arrêter les workloads non productifs en dehors des heures ouvrées et supprimer les ressources qui dépassent les politiques de rétention. Des outils comme Cloud Scheduler et Cloud Functions peuvent appliquer des règles telles que la suppression des VM de test de plus de 30 jours, sauf si elles sont taguées pour conservation.

Une automatisation plus avancée doit tenir compte des dépendances (par exemple, sauvegardes avant arrêt d'une base de données) et appliquer des règles différentes selon qu'il s'agit de dev/test ou de production.

5. Comparez-vous à vos pairs du secteur

Utilisez le peer benchmark score du FinOps Hub pour comparer votre efficacité de coûts, votre utilisation des remises et votre efficacité opérationnelle à celles de vos pairs. Évitez les comparaisons simplistes qui ignorent l'architecture et les exigences métier.

Si votre coût par workload se situe au-dessus de la médiane, vérifiez s'il est justifié par des exigences plus élevées de performance ou de fiabilité, puis attribuez des responsables et des objectifs pour combler les véritables écarts d'efficacité. Instaurer une culture d'optimisation des coûts cloud repose sur la capacité à communiquer cette nuance.

Faites de votre initiative FinOps un succès

Construire un FinOps Google Cloud durable demande plus qu'une checklist. Cela suppose un changement culturel où la conscience des coûts s'intègre naturellement aux décisions engineering et métier, soutenu par une gouvernance qui clarifie les rôles, les responsabilités et les chemins d'escalade.

Investissez dans des outils spécialisés de gestion des coûts qui apportent une analyse guidée par l'intention, au-delà de l'utilisation de surface. Les organisations les plus matures dépassent le rightsizing générique pour comprendre comment leurs choix d'architecture impactent à la fois les coûts et les performances.

Au final, un bon FinOps ne bride pas l'innovation — il la soutient. Lorsque les équipes voient comment leurs choix techniques se traduisent en résultats métier, l'optimisation devient un défi créatif qui améliore à la fois l'efficacité et la fiabilité.

Découvrez comment révéler des opportunités d'économies cachées et réduire vos dépenses Google Cloud.

FAQ FinOps Google Cloud

Comment démarrer le FinOps sur Google Cloud ?

Commencez par l'allocation des coûts : définissez vos projets/comptes, imposez les labels et exportez la facturation vers BigQuery. Mettez ensuite en place des budgets et des alertes d'anomalies, et organisez une revue transverse mensuelle pour prioriser les actions d'optimisation.

Quels sont les leviers FinOps Google Cloud les plus importants ?

Les leviers à plus fort impact sont une allocation des coûts précise, l'optimisation des commitments (CUDs et sustained use), l'efficacité propre à chaque service (partitionnement et conception des requêtes BigQuery, requests/limits et autoscaling GKE, concurrence et instances minimales Cloud Run) et le nettoyage automatisé des ressources non productives inactives.

Qu'est-ce que l'optimisation guidée par l'intention ?

L'optimisation guidée par l'intention évalue les coûts au regard des objectifs des workloads (latence, fiabilité, fenêtres de batch, vélocité des développeurs) plutôt que de juger l'efficacité uniquement sur des pourcentages d'utilisation.

À quelle fréquence revoir les commitments et la couverture des remises ?

Suivez l'utilisation des commitments chaque semaine et réévaluez votre stratégie au moins chaque trimestre, en particulier si vous anticipez de la saisonnalité, des lancements majeurs ou des changements architecturaux susceptibles de modifier l'usage de référence.