L'ottimizzazione dei costi cloud va ormai ben oltre i semplici suggerimenti di rightsizing. Man mano che le aziende ampliano i propri deployment su Google Cloud, l'attenzione si sposta dall'individuazione delle inefficienze più evidenti alla comprensione di come obiettivi dei workloads, design dell'infrastruttura e costi siano strettamente collegati. Gli approcci FinOps tradizionali cadono spesso in quella che chiamiamo "illusione dell'efficienza": metriche di superficie come l'utilizzo della CPU lasciano intendere prestazioni ottimali, mascherando in realtà sprechi architetturali ben più profondi.

Questa illusione nasce dal fatto che il monitoraggio tradizionale guarda alle metriche dell'infrastruttura anziché ai risultati dei workloads. Un job BigQuery con il 90% di utilizzo degli slot, ad esempio, sembra efficiente finché non si scopre che, in assenza di partizioni, sta scansionando intere tabelle e consumando risorse di calcolo senza necessità. Allo stesso modo, un cluster Kubernetes con un elevato utilizzo di CPU può apparire ben ottimizzato anche quando i pod restano in coda per vincoli di memoria o per una cattiva allocazione delle risorse.

Questi (e altri) scenari generano un falso senso di efficienza, in cui un'infrastruttura apparentemente operativa nasconde problemi di design strutturali che si traducono in costi reali.

A differenza del FinOps standard, che ottimizza in base a metriche di utilizzo generiche, l'ottimizzazione intent-aware tiene conto dello scopo di ciascun workload. Un job di training di machine learning, per esempio, può sembrare "sottoutilizzato" durante il pre-processing dei dati pur operando in modo perfettamente ottimale per quella fase della pipeline.

Che si tratti di applicazioni latency-sensitive che richiedono capacità extra per rispettare gli SLA, di garantire il failover con un'infrastruttura ridondante o di privilegiare la velocità di sviluppo rispetto al risparmio, le sue cloud operations devono adattarsi a ogni scenario. Le strategie che seguono possono aiutarla a costruire un approccio più sostenibile alla gestione dei costi cloud per le financial operations su Google Cloud, capace di crescere insieme alla sua organizzazione.

Risposte rapide: FinOps su Google Cloud

**Cos'è il FinOps su Google Cloud?** Il FinOps su Google Cloud è un modello operativo che permette ai team finance, engineering e business di condividere la responsabilità della spesa Google Cloud attraverso visibilità, ottimizzazione e governance continua. **Qual è il modo più rapido per individuare gli sprechi su Google Cloud?** Parta da un'allocazione accurata dei costi (label/progetti), poi riveda commitments e risorse inattive. Quindi intervenga sugli sprechi specifici dei singoli servizi: BigQuery, GKE, Cloud Run e ingestion di logging/monitoring. **Cos'è l'"illusione dell'efficienza" nel FinOps?** Si verifica quando l'utilizzo sembra "buono" (compute attivo, slot e CPU ai massimi) ma il workload continua a sprecare denaro per problemi architetturali, come scansioni BigQuery non partizionate, requests/limits GKE inadeguati o concorrenza mal calibrata.

Cos'è il FinOps su Google Cloud?

Il FinOps su Google Cloud è un framework operativo che porta la responsabilità finanziaria all'interno della spesa cloud grazie alla collaborazione interfunzionale fra i team engineering, finance e business. Anziché agire in modo reattivo, trattando l'ottimizzazione dei costi come un'attività secondaria, il FinOps adotta pratiche proattive per comprendere, monitorare e ottimizzare in modo continuo la spesa cloud.

Secondo la FinOps Foundation, la disciplina si articola in tre fasi fondamentali:

- Inform: visibilità sui pattern di spesa

- Optimize: riduzione dei costi concreta e miglioramenti del design

- Operate: governance e responsabilità continue

Nell'ecosistema Google Cloud, questo si traduce nell'utilizzo di strumenti nativi come Cloud Billing, Cloud Asset Inventory e Recommender API, integrati con piattaforme specializzate come DoiT per ottenere insight più approfonditi sui singoli workloads.

Cos'è il FinOps Score su Google Cloud?

Il FinOps score di Google Cloud aiuta a misurare quanto la sua organizzazione stia gestendo bene l'ottimizzazione dei costi nelle diverse aree. Riflette il grado di adozione delle pratiche raccomandate (per esempio, copertura dei commitments, pulizia delle risorse inattive e completezza nella configurazione degli alert di budget). Può usarlo come baseline per le revisioni trimestrali di ottimizzazione.

Lo score nativo, però, si concentra su best practice generiche e rischia di non cogliere l'intento del workload. Un job di training di machine learning può apparire "sottoutilizzato" durante il preprocessing pur funzionando in modo ottimale per quella fase della pipeline. Ecco perché, quando si valuta l'efficienza, l'analisi intent-aware fa la differenza.

Perché il FinOps è importante per Google Cloud

Il modello di pricing di Google Cloud premia la pianificazione strategica con committed use discounts, sustained use discounts e istanze preemptible. Per coglierne appieno il valore servono però forecasting e analisi dei workloads. Le organizzazioni che adottano pratiche FinOps strutturate registrano spesso riduzioni dei costi già nel primo anno, non solo grazie al downsizing ma anche tramite miglioramenti architetturali che eliminano gli sprechi a livello di design.

I servizi di Google Cloud presentano sfide di ottimizzazione peculiari. Il pricing slot-based di BigQuery rende il costo strettamente legato alla struttura dei dati e alla strategia di partizionamento. Il billing per richiesta di Cloud Run trasforma concorrenza e numero minimo di istanze in un esercizio di tuning fra costi e prestazioni, in cui i cold start possono incidere sia sulla user experience sia sulla spesa.

Questi modelli di pricing spostano l'ottimizzazione dal "dimensionare la macchina" al "progettare il workload". Senza processi FinOps solidi, i team engineering tendono a sovradimensionare le risorse per ridurre il rischio prestazionale, mentre i team finance non hanno il contesto tecnico per individuare le opportunità a maggiore impatto.

Principi essenziali del FinOps su Google Cloud

Un FinOps di successo su Google Cloud poggia su principi che distinguono le pratiche mature dal taglio dei costi improvvisato.

Gli insight sui costi in tempo reale sono la spina dorsale di qualsiasi programma efficace. Nella pratica, "tempo reale" significa spesso un'attribuzione oraria o giornaliera, perché i dati di billing presentano ritardi intrinseci. Il punto chiave è una raccolta automatizzata che colleghi la spesa allo scopo del workload e ai risultati di business, non al solo utilizzo.

La responsabilità degli stakeholder trasforma l'ottimizzazione dei costi in un impegno condiviso. I team engineering devono vedere come le decisioni architetturali influiscono sui costi, mentre le business unit devono collegare la spesa a ricavi, clienti o iniziative strategiche.

La collaborazione interfunzionale abbatte i silos. Quando gli storage engineer comprendono in che modo la retention incide sui costi di analytics e gli sviluppatori capiscono come i pattern di codice si riflettono sui costi di Cloud Functions o Cloud Run, l'ottimizzazione diventa la conseguenza naturale di scelte consapevoli.

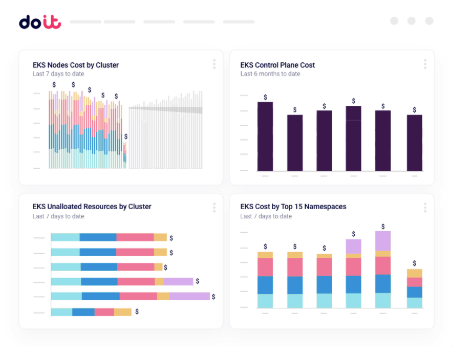

Quali metriche FinOps deve monitorare?

Monitorare le metriche giuste consente di avere visibilità sulla spesa Google Cloud e di guidare un'ottimizzazione realmente efficace.

Accuratezza dell'allocazione dei costi

Un'allocazione precisa dei costi è il fondamento di una governance efficace. La struttura di label e progetti di Google Cloud deve rispecchiare con chiarezza la sua organizzazione, in modo da supportare showback/chargeback e responsabilità.

Renda obbligatorie alcune label (environment, team, application, cost center) per tutte le risorse. Utilizzi report automatizzati in BigQuery per tracciare la spesa per label e li riveda mensilmente per verificarne la completezza. Si appoggi a Cloud Asset Inventory per validare la copertura delle label su larga scala e pubblichi un "untagged resource rate" settimanale per servizio, puntando a una copertura superiore al 95%.

Senza un'allocazione accurata, la spesa cloud si riduce a un'unica voce opaca, che impedisce l'ottimizzazione e indebolisce la responsabilità.

Tassi di utilizzo e metriche di efficienza

L'utilizzo di CPU, memoria e storage offre solo segnali di efficienza superficiali. L'ottimizzazione intent-aware valuta se i workloads raggiungono gli obiettivi di prestazioni al costo giusto, tenendo conto di requisiti come latenza, failover o finestre batch.

Un cluster Kubernetes al 40% di CPU media, per esempio, può sembrare inefficiente finché non si verifica che si tratta di headroom progettato per assorbire i picchi e rispettare gli SLA. In quel caso, la capacità "inutilizzata" è una scelta di design, non uno spreco.

Copertura dei commitments e ottimizzazione degli sconti

I committed use discounts (CUD) e i sustained use discounts richiedono forecasting. Monitori copertura e utilizzo per tipo di risorsa, regione e periodo, e adotti un approccio prudente (in genere il 70%–80% della baseline) negli ambienti dinamici, per ridurre il rischio di overcommit.

Sfrutti Active Assist e la Recommender API per identificare le VM costantemente sottoutilizzate e le valuti insieme all'engineering per il rightsizing o il decommissioning. Se l'utilizzo dei commitments scende sotto l'~85% per più settimane consecutive, riconsideri gli acquisti futuri e ridistribuisca i workloads per sfruttare meglio i commitments esistenti.

Costo per business unit e applicazione

Colleghi la spesa ai risultati di business monitorando il costo per cliente, per transazione, per richiesta o per dollaro di ricavo. Questo aiuta a giustificare l'investimento cloud e orienta la scelta tra sviluppo di nuove feature e interventi sull'infrastruttura.

Automatizzi il reporting che mette in relazione i segnali di performance applicativa con il costo cloud, così che i team possano riconoscere quali applicazioni generano più valore mantenendo la disciplina sui costi.

Anomaly detection e scostamenti di budget

L'anomaly detection automatizzata segnala picchi di costo inattesi prima che intacchino i budget mensili. Gli alert di budget di Google Cloud sono utili, ma un FinOps maturo aggiunge un contesto predittivo che tiene conto di stagionalità, lanci pianificati e workloads batch attesi.

Definisca regole di escalation chiare: alert immediato per picchi non pianificati che superano il 20% della media giornaliera o per qualsiasi aumento privo di una corrispondente attività di business. Tratti i picchi durante lo scaling normale come eventi "da monitorare e confermare", non necessariamente come situazioni "da annullare", e li confronti sempre con il suo change calendar.

Configuri gli alert in Google Cloud Billing e affidi a un analista finance e a un lead engineering la revisione e la risposta congiunta.

5 chiavi per il successo del FinOps su Google Cloud

Avere successo nel FinOps su Google Cloud richiede una strategia capace di unire gestione finanziaria e operations tecniche.

1. Tagghi le risorse in modo efficace

Un tagging delle risorse capillare abilita analisi granulari e ottimizzazione automatizzata. Adotti un labeling gerarchico, allineato alla struttura organizzativa e alla tassonomia applicativa. Le categorie di label più comuni sono environment, team, application ID e cost center.

Quando possibile, ricorra alle Organization Policy per impedire la creazione di risorse non taggate, ricordando che il livello di enforcement varia a seconda del servizio. Per i servizi privi di un enforcement robusto, attivi gli alert di Cloud Asset Inventory sulle nuove risorse non taggate ed esegua audit mensili per la remediation.

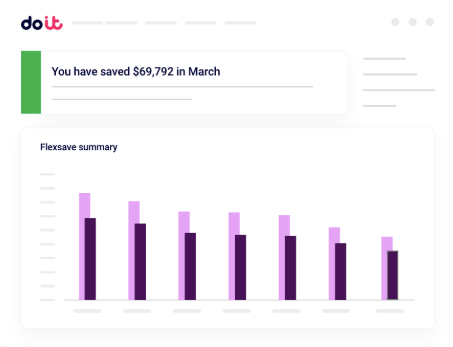

2. Adotti commitments e sconti

I committed use discounts possono garantire risparmi consistenti sui workloads prevedibili, ma richiedono un forecasting accurato per evitare le penali da overcommitment.

Analizzi l'utilizzo per tipo di risorsa, regione e periodo. Tenga d'occhio gli indicatori di rischio: utilizzo che scende sotto l'80% della capacità impegnata per due mesi consecutivi, sunset di progetti imminenti o cambiamenti architetturali rilevanti. Inizi con commitments a breve termine ed estenda la durata man mano che il forecasting migliora. Riveda i commitments ogni trimestre per adattarsi all'andamento della domanda.

Muovere il primo passo verso il risparmio sul cloud significa bilanciare riduzioni immediate dei costi e flessibilità operativa.

3. Pianifichi revisioni cross-team regolari

Organizzi revisioni mensili con stakeholder di engineering, finance e business. Si concentri sull'analisi dei trend, sull'utilizzo dei commitments e sulle azioni di ottimizzazione che richiedono coordinamento interfunzionale.

Crei dashboard standardizzate (per esempio in Looker o FinOps Hub) per tradurre le metriche tecniche in linguaggio di business. Motivare engineer molto impegnati diventa più semplice quando l'ottimizzazione viene presentata come un modo per migliorare affidabilità e prestazioni, non solo per ridurre la spesa.

4. Automatizzi la pulizia delle risorse inattive

Si affidi all'automazione del lifecycle per spegnere i workloads non di produzione fuori orario ed eliminare le risorse che superano le politiche di retention. Strumenti come Cloud Scheduler e Cloud Functions consentono di applicare policy come l'eliminazione delle VM di test più vecchie di 30 giorni, salvo quelle taggate per la conservazione.

Un'automazione più avanzata deve tener conto delle dipendenze (per esempio, il backup prima dello shutdown del database) e applicare regole differenti per dev/test e produzione.

5. Faccia benchmarking rispetto ai peer del settore

Utilizzi il peer benchmark score di FinOps Hub per confrontare efficienza dei costi, utilizzo degli sconti ed efficienza operativa con quelli dei peer. Eviti confronti semplicistici che ignorano architettura e requisiti di business.

Se il suo costo per workload è sopra la mediana, verifichi se sia giustificato da requisiti più elevati di prestazioni o affidabilità, quindi assegni owner e obiettivi per colmare i veri gap di efficienza. Costruire una cultura di ottimizzazione dei costi cloud dipende proprio dalla capacità di trasmettere questa sfumatura.

Trasformi la sua iniziativa FinOps in un successo

Costruire un FinOps su Google Cloud sostenibile richiede ben più di una checklist. Serve un cambiamento culturale, in cui la consapevolezza dei costi diventi parte integrante delle decisioni di engineering e di business, sostenuto da una governance che chiarisca ruoli, responsabilità e percorsi di escalation.

Investa in strumenti specializzati di gestione dei costi capaci di offrire un'analisi intent-aware che vada oltre l'utilizzo di superficie. Le organizzazioni più mature superano il rightsizing generico per capire come le scelte architetturali si riflettano sia sui costi sia sulle prestazioni.

In definitiva, un buon FinOps non frena l'innovazione: la sostiene. Quando i team comprendono come le scelte tecniche si traducano in risultati di business, l'ottimizzazione diventa una sfida creativa che migliora insieme efficienza e affidabilità.

Scopra come individuare opportunità di risparmio nascoste e ridurre la sua spesa Google Cloud.

FAQ FinOps su Google Cloud

Come si parte con il FinOps su Google Cloud?

Inizi dall'allocazione dei costi: definisca progetti/account, applichi le label ed esporti il billing su BigQuery. Quindi imposti budget e alert sulle anomalie e introduca una revisione mensile cross-team per dare priorità alle azioni di ottimizzazione.

Quali sono le leve FinOps più importanti su Google Cloud?

Le leve a maggiore impatto sono un'allocazione accurata dei costi, l'ottimizzazione dei commitments (CUD e sustained use), l'efficienza specifica dei singoli servizi (partizionamento e progettazione delle query in BigQuery, requests/limits e autoscaling in GKE, concorrenza/min instances in Cloud Run) e la pulizia automatizzata delle risorse inattive non di produzione.

Cos'è l'ottimizzazione "intent-aware"?

L'ottimizzazione intent-aware valuta i costi rispetto agli obiettivi del workload (latenza, affidabilità, finestre batch, velocità di sviluppo) anziché giudicare l'efficienza solo in base alle percentuali di utilizzo.

Con quale frequenza occorre rivedere commitments e copertura degli sconti?

Riveda l'utilizzo dei commitments con cadenza settimanale e ripensi la strategia complessiva almeno ogni trimestre, soprattutto se prevede stagionalità, lanci importanti o cambiamenti architetturali in grado di modificare la baseline di utilizzo.