Cloud-Kostenoptimierung ist längst mehr als simple Right-Sizing-Empfehlungen. Mit wachsenden Google-Cloud-Umgebungen verschiebt sich der Fokus: Statt offensichtliche Ineffizienzen aufzuspüren, geht es darum zu verstehen, wie Workload-Ziele, Infrastrukturdesign und Kosten zusammenspielen. Klassische FinOps-Ansätze tappen oft in die sogenannte "Effizienzillusion": Oberflächenkennzahlen wie die CPU-Auslastung suggerieren optimale Performance, während tieferliegende architektonische Verschwendung im Verborgenen bleibt.

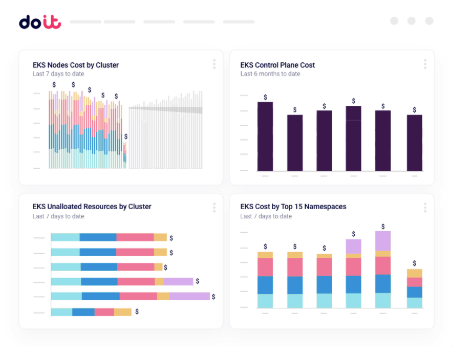

Diese Illusion entsteht, weil klassisches Monitoring auf Infrastrukturmetriken schaut statt auf Workload-Ergebnisse. Ein Beispiel: Ein BigQuery-Job mit 90 % Slot-Auslastung wirkt effizient – bis sich zeigt, dass er mangels Partitionen ganze Tabellen scannt und unnötig Compute verbrennt. Ähnlich kann ein Kubernetes-Cluster mit hoher CPU-Auslastung gut optimiert wirken, während Pods in Wahrheit wegen Speicherengpässen oder schlecht gesetzter Ressourcenzuteilung in der Warteschlange hängen.

Solche und ähnliche Szenarien erzeugen ein trügerisches Effizienzgefühl: Ausgelastete Infrastruktur kaschiert grundlegende Designprobleme, die die eigentlichen Kosten treiben.

Anders als klassisches FinOps, das anhand generischer Auslastungsmetriken optimiert, berücksichtigt intent-basierte Optimierung den Zweck jedes einzelnen Workloads. Ein Machine-Learning-Trainingsjob etwa kann während der Datenvorverarbeitung "unterausgelastet" wirken – und arbeitet für seine Pipeline-Phase trotzdem optimal.

Ob Sie latenzkritische Anwendungen mit zusätzlicher Kapazität für SLAs betreiben, Failover-Garantien über redundante Infrastruktur absichern oder Entwicklungsgeschwindigkeit über Kosteneinsparungen stellen – Ihr Cloud-Betrieb muss sich auf jedes Szenario einstellen. Die folgenden Strategien helfen Ihnen, einen nachhaltigen Ansatz für das Kostenmanagement in Google Cloud aufzubauen, der mit Ihrer Organisation mitwächst.

Kurz beantwortet: Google Cloud FinOps

**Was ist Google Cloud FinOps?** Google Cloud FinOps ist ein Betriebsmodell, das Finance-, Engineering- und Business-Teams gemeinsame Verantwortung für die Google-Cloud-Ausgaben übertragen lässt – über Transparenz, Optimierung und kontinuierliche Governance. **Wie findet man Waste in Google Cloud am schnellsten?** Beginnen Sie mit einer sauberen Kostenzuordnung (Labels/Projekte) und prüfen Sie anschließend Commitments und ungenutzte Ressourcen. Nehmen Sie danach servicespezifischen Waste in BigQuery, GKE, Cloud Run sowie Logging- und Monitoring-Ingestion ins Visier. **Was ist die "Effizienzillusion" im FinOps-Kontext?** Sie tritt auf, wenn die Auslastung "gut" aussieht (ausgelastete Compute-Ressourcen, hohe Slot-Nutzung, hohe CPU-Werte), der Workload aber dennoch Geld verbrennt – etwa durch unpartitionierte BigQuery-Scans, schlecht gesetzte GKE-Requests/-Limits oder falsch abgestimmte Concurrency.

Was ist Google Cloud FinOps?

Google Cloud FinOps ist ein Betriebsframework, das finanzielle Verantwortung für Cloud-Ausgaben durch funktionsübergreifende Zusammenarbeit zwischen Engineering-, Finance- und Business-Teams verankert. Statt reaktiv zu agieren und Kostenoptimierung als Nebensache zu behandeln, setzt FinOps auf proaktive Praktiken, um Cloud-Ausgaben kontinuierlich zu verstehen, nachzuvollziehen und zu optimieren.

Laut FinOps Foundation umfasst die Disziplin drei Kernphasen:

- Inform: Transparenz über Ausgabenmuster

- Optimize: umsetzbare Kostensenkung und Designverbesserungen

- Operate: kontinuierliche Governance und Verantwortung

Im Google-Cloud-Ökosystem heißt das: native Werkzeuge wie Cloud Billing, Cloud Asset Inventory und die Recommender API einsetzen – ergänzt um spezialisierte Plattformen wie DoiT für tiefere, workload-spezifische Einblicke.

Was ist der FinOps-Score in Google Cloud?

Der FinOps-Score von Google Cloud zeigt, wie gut Ihre Organisation Kostenoptimierung in den verschiedenen Bereichen umsetzt. Er bildet die Anwendung empfohlener Praktiken ab (z. B. Commitment-Abdeckung, Bereinigung ungenutzter Ressourcen, Vollständigkeit der Budget-Alerts) und eignet sich gut als Ausgangspunkt für vierteljährliche Optimierungs-Reviews.

Der native Score konzentriert sich allerdings auf allgemeine Best Practices und übersieht den Workload-Intent womöglich. Ein Machine-Learning-Trainingsjob kann während der Vorverarbeitung "unterausgelastet" wirken und in seiner Pipeline-Phase trotzdem optimal laufen. Genau deshalb ist intent-basierte Analyse entscheidend, wenn es um die Bewertung von Effizienz geht.

Warum FinOps für Google Cloud entscheidend ist

Das Preismodell von Google Cloud belohnt strategische Planung – über Committed Use Discounts, Sustained Use Discounts und Preemptible Instances. Diese Vorteile setzen jedoch Forecasting und Workload-Analyse voraus, um den vollen Nutzen abzuschöpfen. Organisationen, die strukturierte FinOps-Praktiken einführen, erzielen oft bereits im ersten Jahr Kostensenkungen – nicht nur durch Downsizing, sondern auch durch architektonische Verbesserungen, die Verschwendung auf Designebene beseitigen.

Google-Cloud-Dienste bringen eigene Optimierungsherausforderungen mit. Das slot-basierte Pricing von BigQuery macht die Kosten stark abhängig von Datenstruktur und Partitionierungsstrategie. Die Pro-Anfrage-Abrechnung von Cloud Run macht Concurrency und Mindestinstanzen zu einer Tuning-Aufgabe zwischen Kosten und Performance, bei der Cold Starts sowohl die User Experience als auch die Ausgaben beeinflussen.

Diese Preismodelle verlagern den Fokus der Optimierung von "Maschine richtig dimensionieren" auf "Workload richtig designen". Ohne solide FinOps-Prozesse überdimensionieren Engineering-Teams Ressourcen häufig, um Performance-Risiken zu minimieren – während Finance-Teams der technische Kontext fehlt, um die wirkungsvollsten Hebel zu identifizieren.

Grundprinzipien von Google Cloud FinOps

Erfolgreiches Google Cloud FinOps basiert auf Prinzipien, die ausgereifte Praktiken von kurzfristigen Sparmaßnahmen unterscheiden.

Echtzeit-Kosteneinblicke bilden das Rückgrat jedes wirksamen Programms. In der Praxis bedeutet "Echtzeit" meist eine stündliche oder tägliche Zuordnung, da Abrechnungsdaten systembedingt verzögert sind. Entscheidend ist eine automatisierte Erfassung, die Ausgaben mit dem Zweck der Workloads und den Geschäftsergebnissen verknüpft – und nicht nur mit der Auslastung.

Verantwortung der Stakeholder macht Kostenoptimierung zur gemeinsamen Aufgabe. Engineering-Teams müssen sehen, wie Architekturentscheidungen die Kosten beeinflussen, und Geschäftsbereiche müssen Ausgaben mit Umsatz, Kunden oder strategischen Initiativen in Beziehung setzen können.

Funktionsübergreifende Zusammenarbeit bricht Silos auf. Wenn Storage-Engineers verstehen, wie Aufbewahrungsfristen die Analytics-Kosten treiben, und Entwickler nachvollziehen können, wie Code-Muster die Cloud-Functions- oder Cloud-Run-Gebühren beeinflussen, wird Optimierung zur natürlichen Folge fundierter Entscheidungen.

Welche FinOps-Metriken sollten Sie tracken?

Die richtigen Metriken verschaffen Ihnen Transparenz über Ihre Google-Cloud-Ausgaben und treiben sinnvolle Optimierungen voran.

Genauigkeit der Kostenzuordnung

Eine präzise Kostenzuordnung ist das Fundament wirksamer Governance. Labels und Projektstruktur in Google Cloud sollten sauber zu Ihrer Organisation passen, damit Showback/Chargeback und klare Verantwortlichkeiten möglich sind.

Setzen Sie verpflichtende Labels (Umgebung, Team, Anwendung, Kostenstelle) für alle Ressourcen durch. Nutzen Sie automatisierte Reports in BigQuery, um Ausgaben nach Label nachzuverfolgen, und prüfen Sie die Vollständigkeit monatlich. Mit Cloud Asset Inventory validieren Sie die Label-Abdeckung im großen Maßstab und veröffentlichen wöchentlich eine Quote "nicht getaggter Ressourcen" je Service – Zielwert: 95 % oder mehr getaggte Ressourcen.

Ohne saubere Zuordnung werden Cloud-Ausgaben zu einer einzigen, undurchsichtigen Position – Optimierung wird verhindert und Verantwortung verwässert.

Auslastung und Effizienzkennzahlen

CPU-, Speicher- und Storage-Auslastung sind oberflächliche Effizienzsignale. Intent-basierte Optimierung bewertet, ob Workloads ihre Performance-Ziele zu angemessenen Kosten erreichen – unter Berücksichtigung von Anforderungen wie Latenz, Failover oder Batch-Fenstern.

Ein Beispiel: Ein Kubernetes-Cluster mit 40 % durchschnittlicher CPU-Auslastung mag ineffizient wirken – bis Sie bestätigen, dass es sich um bewusst eingeplante Reserven für Lastspitzen und SLA-Verpflichtungen handelt. Dann ist die "ungenutzte" Kapazität ein Designmerkmal, kein Waste.

Commitment-Abdeckung und Rabattoptimierung

Committed Use Discounts (CUDs) und Sustained Use Discounts erfordern Forecasting. Verfolgen Sie Abdeckung und Auslastung über Ressourcentypen, Regionen und Zeiträume hinweg und starten Sie in dynamischen Umgebungen konservativ (häufig 70–80 % der Baseline), um Overcommit-Risiken zu reduzieren.

Mit Active Assist und der Recommender API identifizieren Sie dauerhaft unterausgelastete VMs und besprechen sie mit dem Engineering – für Right-Sizing oder Stilllegung. Fällt die Commitment-Auslastung über mehrere Wochen unter ca. 85 %, bewerten Sie zukünftige Käufe neu und verlagern Sie Workloads, um bestehende Commitments besser auszunutzen.

Kosten pro Geschäftsbereich und Anwendung

Verknüpfen Sie Ausgaben mit Geschäftsergebnissen, indem Sie Kosten pro Kunde, pro Transaktion, pro Request oder pro Umsatz-Euro nachverfolgen. Das hilft, Cloud-Investitionen zu rechtfertigen, und gibt Orientierung bei der Priorisierung von Feature-Entwicklung gegenüber Infrastrukturanpassungen.

Automatisieren Sie Reports, die Performance-Signale von Anwendungen mit den Cloud-Kosten verknüpfen. So erkennen Teams, welche Anwendungen hohen Wert liefern und gleichzeitig die Kostendisziplin wahren.

Anomalie-Erkennung und Budgetabweichungen

Automatisierte Anomalie-Erkennung meldet unerwartete Kostenspitzen, bevor sie das Monatsbudget belasten. Budget-Alerts in Google Cloud sind hilfreich, doch ausgereiftes FinOps ergänzt prädiktiven Kontext wie Saisonalität, geplante Launches und erwartete Batch-Workloads.

Definieren Sie Eskalationsregeln: Sofortiger Alert bei ungeplanten Spitzen, die 20 % über dem Tagesdurchschnitt liegen, oder bei jeder Steigerung ohne entsprechende Geschäftsaktivität. Spitzen während normaler Skalierung behandeln Sie als "beobachten und bestätigen" – nicht zwingend als "zurückrollen" – und gleichen sie stets mit Ihrem Change-Kalender ab.

Richten Sie Alerts in Google Cloud Billing ein und benennen Sie eine Finance-Analystin oder einen Finance-Analysten sowie einen Engineering-Lead, die gemeinsam prüfen und reagieren.

5 Schlüsselfaktoren für erfolgreiches Google Cloud FinOps

Erfolg im Google Cloud FinOps verlangt eine Strategie, die Finanzmanagement und technischen Betrieb verzahnt.

1. Ressourcen wirksam taggen

Ein umfassendes Resource-Tagging ermöglicht granulare Analysen und automatisierte Optimierung. Verwenden Sie hierarchische Labels, die sich an Organisationsstruktur und Anwendungstaxonomie orientieren. Übliche Label-Kategorien sind Umgebung, Team, Anwendungs-ID und Kostenstelle.

Nutzen Sie nach Möglichkeit die Organization Policy, um die Erstellung nicht getaggter Ressourcen zu blockieren – die Durchsetzung variiert allerdings je nach Service. Für Services ohne strikte Durchsetzung empfehlen sich Cloud-Asset-Inventory-Alerts für neu erstellte, nicht getaggte Ressourcen sowie monatliche Audits zur Nachbesserung.

2. Commitments und Rabatte nutzen

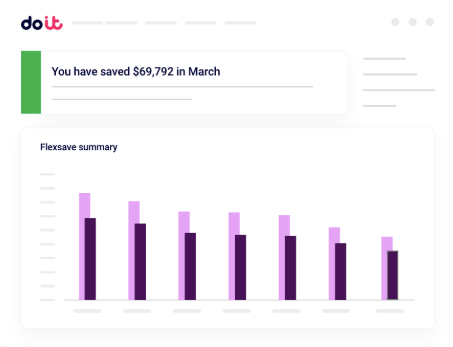

Committed Use Discounts können bei vorhersehbaren Workloads erhebliche Einsparungen bringen, erfordern aber Forecasting, um Strafen wegen Overcommitment zu vermeiden.

Analysieren Sie Ihre Nutzung über Ressourcentypen, Regionen und Zeiträume hinweg. Achten Sie auf Risikoindikatoren wie eine Nutzung unter 80 % der zugesagten Kapazität über zwei aufeinanderfolgende Monate, anstehende Projektabschaltungen oder größere Architekturänderungen. Beginnen Sie mit kürzeren Laufzeiten und verlängern Sie diese, sobald sich Ihr Forecasting verbessert. Bewerten Sie Commitments quartalsweise neu, um auf Bedarfsänderungen zu reagieren.

Der erste Schritt zu Cloud-Einsparungen verlangt eine Balance zwischen sofortiger Kostensenkung und operativer Flexibilität.

3. Regelmäßige teamübergreifende Reviews etablieren

Halten Sie monatliche Reviews mit Engineering-, Finance- und Business-Stakeholdern ab. Konzentrieren Sie sich auf Trendanalysen, Commitment-Auslastung und Optimierungsmaßnahmen, die funktionsübergreifende Abstimmung erfordern.

Erstellen Sie standardisierte Dashboards (z. B. mit Looker oder dem FinOps Hub), um technische Kennzahlen in die Sprache des Geschäfts zu übersetzen. Vielbeschäftigte Engineers für FinOps zu gewinnen fällt leichter, wenn Optimierung als Verbesserung von Zuverlässigkeit und Performance verstanden wird – und nicht nur als Sparmaßnahme.

4. Bereinigung ungenutzter Ressourcen automatisieren

Setzen Sie Lifecycle-Automatisierung ein, um Non-Production-Workloads außerhalb der Geschäftszeiten herunterzufahren und Ressourcen, die Aufbewahrungsrichtlinien überschreiten, zu löschen. Tools wie Cloud Scheduler und Cloud Functions können Richtlinien durchsetzen – etwa das Löschen von Test-VMs, die älter als 30 Tage sind, sofern sie nicht zur Aufbewahrung markiert sind.

Fortgeschrittene Automatisierung sollte Abhängigkeiten berücksichtigen (z. B. Backups vor dem Herunterfahren einer Datenbank) und unterschiedliche Regeln für Dev/Test gegenüber Produktion anwenden.

5. Sich an Branchen-Benchmarks messen

Nutzen Sie den Peer-Benchmark-Score des FinOps Hub, um Kosteneffizienz, Rabattnutzung und operative Effizienz mit anderen Unternehmen zu vergleichen. Vermeiden Sie vereinfachte Vergleiche, die Architektur und geschäftliche Anforderungen ausblenden.

Liegen Ihre Kosten pro Workload über dem Median, prüfen Sie, ob höhere Performance- oder Zuverlässigkeitsanforderungen das rechtfertigen, und benennen Sie anschließend Verantwortliche und Zielwerte, um echte Effizienzlücken zu schließen. Eine Kultur der Cloud-Kostenoptimierung aufzubauen, hängt davon ab, diese Differenzierung klar zu kommunizieren.

So machen Sie Ihre FinOps-Initiative zum Erfolg

Nachhaltiges Google Cloud FinOps aufzubauen, ist mehr als das Abarbeiten einer Checkliste. Es braucht einen Kulturwandel, in dem Kostenbewusstsein zu einem selbstverständlichen Teil von Engineering- und Geschäftsentscheidungen wird – getragen von einer Governance, die Rollen, Verantwortlichkeiten und Eskalationswege klar regelt.

Investieren Sie in spezialisierte Kostenmanagement-Tools, die intent-basierte Analysen jenseits oberflächlicher Auslastung liefern. Die fortschrittlichsten Organisationen lassen generisches Right-Sizing hinter sich und verstehen, wie Architekturentscheidungen sowohl Kosten als auch Performance beeinflussen.

Letztlich bremst gutes FinOps Innovation nicht – es ermöglicht sie. Wenn Teams verstehen, wie technische Entscheidungen auf Geschäftsergebnisse einzahlen, wird Optimierung zur kreativen Aufgabe, die Effizienz und Zuverlässigkeit zugleich steigert.

Erfahren Sie, wie Sie verborgene Einsparpotenziale aufdecken und Ihre Google-Cloud-Ausgaben senken.

Google Cloud FinOps – FAQ

Wie starte ich mit FinOps in Google Cloud?

Beginnen Sie mit der Kostenzuordnung: Definieren Sie Projekte/Konten, setzen Sie Labels durch und exportieren Sie die Abrechnungsdaten nach BigQuery. Richten Sie anschließend Budgets und Anomalie-Alerts ein und führen Sie monatlich ein teamübergreifendes Review durch, um Optimierungsmaßnahmen zu priorisieren.

Welche FinOps-Hebel sind in Google Cloud am wichtigsten?

Die wirkungsvollsten Hebel sind eine genaue Kostenzuordnung, Commitment-Optimierung (CUDs und Sustained Use), servicespezifische Effizienz (BigQuery-Partitionierung/Query-Design, GKE-Requests/-Limits und Autoscaling, Cloud-Run-Concurrency/Mindestinstanzen) sowie automatisierte Bereinigung ungenutzter Non-Production-Ressourcen.

Was bedeutet "intent-basierte" Optimierung?

Intent-basierte Optimierung bewertet Kosten anhand der Workload-Ziele (Latenz, Zuverlässigkeit, Batch-Fenster, Entwicklungsgeschwindigkeit), statt Effizienz allein an Auslastungsprozenten festzumachen.

Wie oft sollten wir Commitments und Rabattabdeckung überprüfen?

Prüfen Sie die Commitment-Auslastung wöchentlich und überdenken Sie die Commitment-Strategie mindestens vierteljährlich – insbesondere bei zu erwartender Saisonalität, größeren Launches oder Architekturänderungen, die die Baseline-Nutzung verschieben können.