Nueva integración de Databricks para DoiT Cloud Intelligence. Gestiona tus costos de Databricks junto con tu infraestructura cloud y otros gastos de SaaS. Lleva el control del gasto, detecta anomalías en lo que inviertes en Databricks y optimiza todo tu portfolio tecnológico.

¿Usas Databricks para análisis de datos? Ya puedes conectar Databricks con DoiT Cloud Intelligence y dar seguimiento detallado a los costos y al uso de Databricks junto con los datos de costo y uso de tu infraestructura cloud.

Tras conectar tu(s) cuenta(s) de Databricks, podrás explorar los costos y el uso de Databricks en DoiT Cloud Intelligence™ de varias formas.

Veamos las principales maneras de sacarle provecho a esta integración.

Databricks Lens

Databricks Lens es un dashboard listo para usar que se crea apenas integras Databricks. Te entrega una vista general de los costos y el uso de Databricks, con visualizaciones del uso de DBU, la utilización de clusters, los costos diarios por job y mucho más.

Es un buen punto de partida para analizar Databricks, pero apenas roza la superficie. La parte realmente interesante llega cuando combinas tus datos de Databricks con otras capacidades de DoiT como Allocations, reportes personalizados, Anomaly Detection y más.

Databricks Lens en DoiT Cloud Intelligence

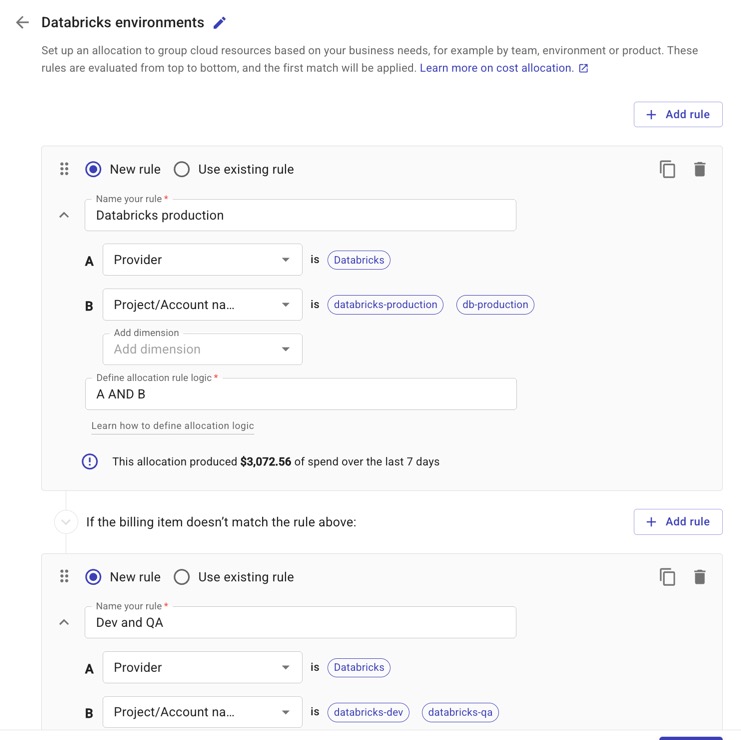

Crea Allocations con datos de costo y uso de Databricks

Las Allocations son clave para lograr una verdadera responsabilidad sobre los costos y habilitar un showback/chargeback preciso entre equipos, proyectos y unidades de negocio.

Con la integración configurada, podrás incorporar datos detallados de costo y uso de Databricks —mediante dimensiones estándar y/o system labels— en tus Allocations.

Pueden ser Allocations exclusivas de Databricks o Allocations existentes que ya incluyen datos de otra(s) nube(s) como AWS y/o servicios integrados como Datadog.

Mientras más elementos de costo incluyas en tus allocations —desde la infraestructura cloud principal hasta plataformas SaaS como Datadog y OpenAI—, más completa y accionable será tu visibilidad de costos y mejor entenderás el impacto económico real de tus inversiones tecnológicas.

En el siguiente ejemplo creamos una Allocation ("Databricks environments") que define varios entornos de Databricks —producción y dev/QA— a partir de los datos ingeridos mediante la integración con Databricks.

Allocations en DoiT Cloud Intelligence que representan distintos entornos de Databricks

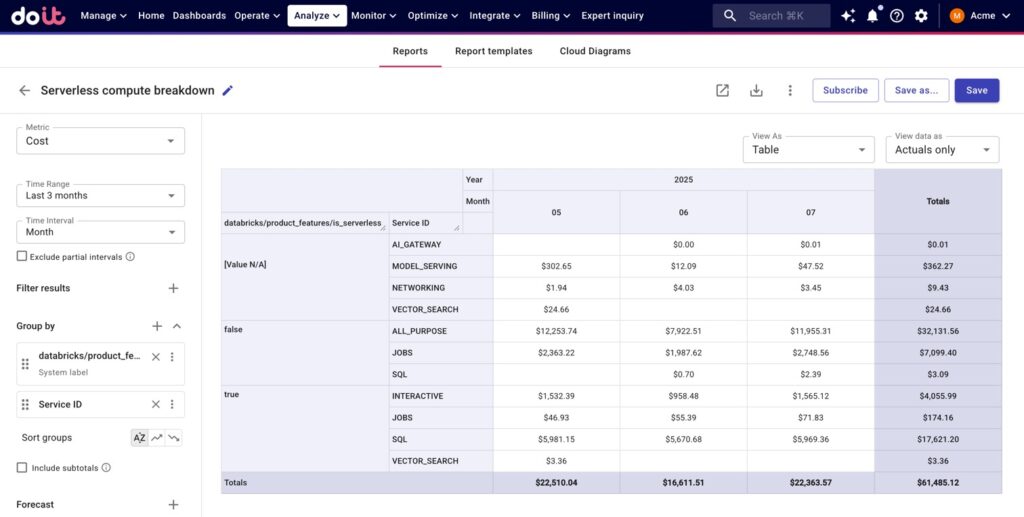

Crea reportes de costo y uso con datos de Databricks

Con los mismos datos mencionados arriba, también puedes armar reportes que te ayuden a entender tu gasto y uso de Databricks.

Por ejemplo, la mejor práctica para ejecutar workloads de SQL en Databricks es usar serverless compute.

En el siguiente reporte podemos ver —usando la system label databricks/product_features/is_serverless— si hay workloads de SQL ejecutándose en compute no serverless (valor "False" en la primera columna).

Reporte que desglosa los workloads que se ejecutan en compute serverless y no serverless por tipo de workload

Si ves un costo importante junto a "SQL" en la segunda columna, puedes analizar qué clusters están corriendo en compute no serverless agregando databricks/cluster_name en la sección Group by para identificar qué clusters conviene reemplazar por serverless compute.

Monitorea y controla tu gasto en Databricks

Al igual que con otras integraciones que hemos lanzado (por ejemplo, Datadog u OpenAI), si hay un pico anómalo de costos en Databricks, Anomaly Detection lo detectará y te avisará, de modo que puedas actuar antes de que afecte tu factura y tus operaciones.

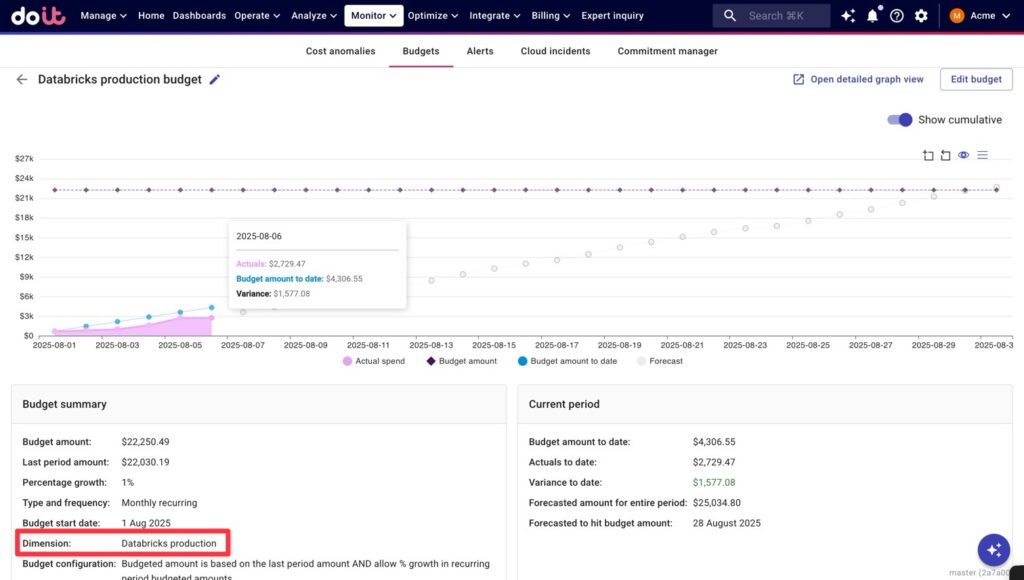

Además, puedes crear Budgets usando Allocations que incorporen datos de Databricks.

¿Recuerdas las Allocations para los dos tipos de entornos de Databricks que armamos antes?

A continuación creamos un budget que monitorea el gasto de producción de Databricks —definido por nuestra regla de Allocation "Databricks production"— frente a distintos umbrales de gasto.

Budget en DoiT Cloud Intelligence que monitorea los costos de producción de Databricks

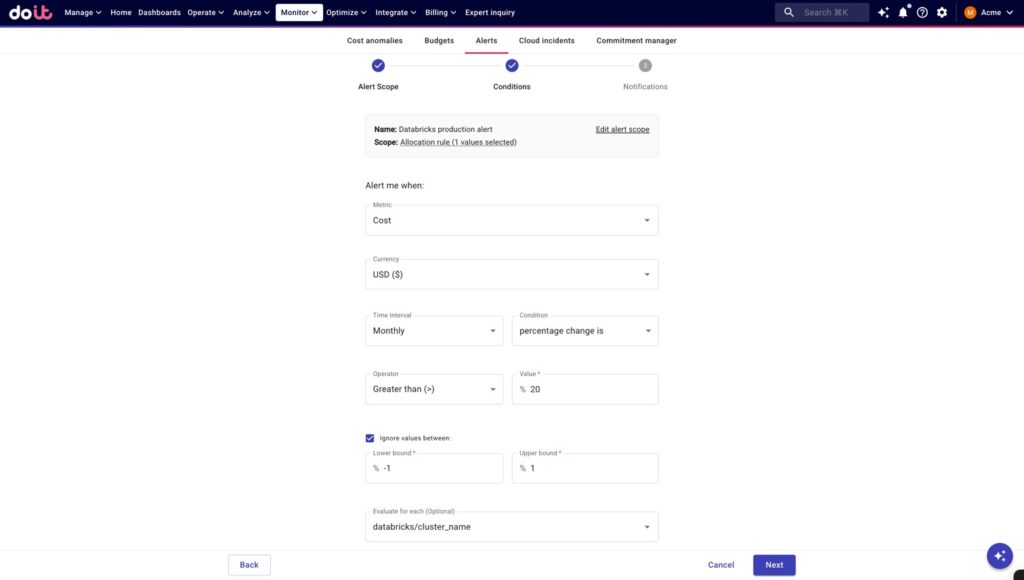

Otro caso de uso muy útil (y complemento de los Budgets) es configurar Alerts que monitoreen el uso de Databricks. Igual que en el caso anterior, acotamos esta alerta a nuestra regla de Allocation "Databricks production".

Esta alerta nos avisa cuando los costos mes a mes suben más del 20%, pero como incluimos la system label databricks/cluster_name en el desplegable Evaluate for each, la alerta se dispara cuando el costo de cualquier cluster de producción sube más del 20%.

Mientras los Budgets te ayudan a vigilar elementos de gasto a alto nivel, las Alerts te permiten monitorear múltiples instancias de una misma dimensión. En este caso, en lugar de crear un Budget para cada cluster de producción, basta con configurar una sola Alert.

Alerta que avisa cuando el costo de cualquier cluster de producción aumenta más del 20% mes a mes

Con tu gasto de Databricks junto a tu infraestructura cloud, otros costos integrados de SaaS como Datadog y cualquier otro costo que hayas incorporado mediante DataHub, obtienes una visión mucho más completa.

Y como tus métricas de unit economics se calculan a partir de las Allocations, incorporar los datos de Databricks en ellas significa que tu costo por cliente, costo por transacción y otras métricas de negocio reflejarán el costo real y completo de tus operaciones.

¿Listo para empezar? Si usas Databricks, configura hoy mismo la integración y gana mejor visibilidad sobre los costos de tu plataforma de datos. ¿Aún no eres cliente de DoiT? Contáctanos para conocer cómo DoiT Cloud Intelligence puede ayudarte a generar el máximo valor de tus inversiones en la nube, y no solo a reducir costos.

La integración con Databricks está disponible para los clientes elegibles de DoiT Cloud Intelligence. Consulta nuestra página de Precios para ver los detalles actuales de cada plan.

Para conocer más sobre la integración con Databricks, revisa nuestra documentación en el DoiT Help Center o haz el recorrido paso a paso para configurar la integración con Databricks.