Nova integração do Databricks com o DoiT Cloud Intelligence. Gerencie os custos do Databricks junto com sua infraestrutura de nuvem e os demais custos de SaaS. Acompanhe gastos, detecte anomalias no consumo do Databricks e otimize todo o seu portfólio de tecnologia.

Usa o Databricks para análise de dados? Agora dá para conectar o Databricks ao DoiT Cloud Intelligence e acompanhar em detalhes os custos e o uso do Databricks lado a lado com os dados de custo e uso da sua infraestrutura de nuvem.

Depois de conectar suas contas do Databricks, você poderá explorar os custos e o uso do Databricks no DoiT Cloud Intelligence™ de várias formas.

Confira as principais maneiras de tirar proveito dessa integração.

Databricks Lens

O Databricks Lens é um dashboard pronto para uso, criado assim que você integra o Databricks. Ele traz uma visão geral dos seus custos e do uso do Databricks, com visualizações de consumo de DBU, utilização de clusters, custos diários por job e muito mais.

Embora seja um ótimo ponto de partida para analisar seu Databricks, isso é só a ponta do iceberg. O verdadeiro potencial aparece quando você cruza os dados do Databricks com outros recursos da DoiT, como Allocations, relatórios personalizados, Anomaly Detection e mais.

Databricks Lens no DoiT Cloud Intelligence

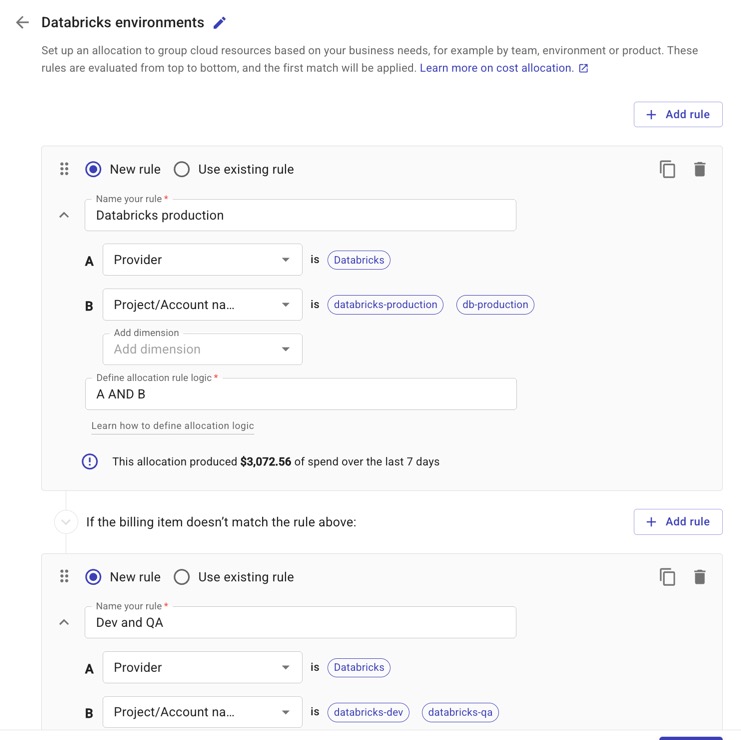

Crie Allocations com dados de custo e uso do Databricks

As Allocations são essenciais para garantir uma verdadeira responsabilização sobre os custos e viabilizar showback/chargeback precisos entre times, projetos e unidades de negócio.

Com a integração configurada, você poderá incorporar dados detalhados de custo e uso do Databricks — via standard dimensions e/ou system labels — nas suas Allocations.

Elas podem ser Allocations exclusivas do Databricks ou Allocations já existentes que incluam dados de outras nuvens, como AWS, e/ou serviços integrados, como o Datadog.

Quanto mais elementos de custo entrarem nas suas allocations — da infraestrutura de nuvem básica a plataformas SaaS como Datadog e OpenAI — mais completa e acionável fica a sua visibilidade de custos, e melhor você entende o real impacto econômico dos seus investimentos em tecnologia.

No exemplo abaixo, criamos uma Allocation ("Databricks environments") que define vários ambientes Databricks — produção e dev/QA — usando dados ingeridos pela integração com o Databricks.

Allocations no DoiT Cloud Intelligence representando diferentes ambientes Databricks

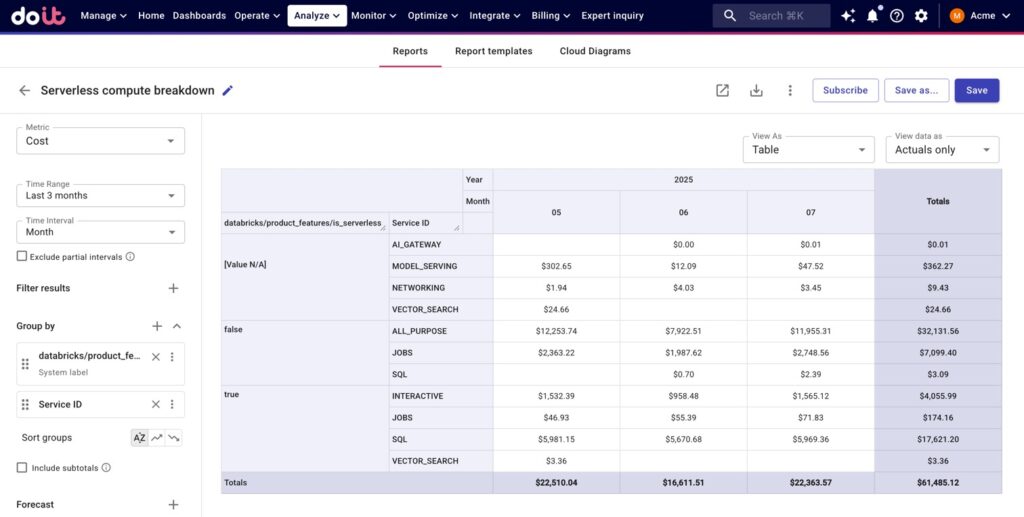

Gere relatórios de custo e uso com dados do Databricks

Com os mesmos dados citados na seção anterior, você também pode montar relatórios para entender melhor seus gastos e o uso do Databricks.

Por exemplo, a boa prática para rodar workloads SQL no Databricks é usar compute serverless.

No relatório abaixo, dá para ver — usando a system label databricks/product_features/is_serverless — se há workloads SQL rodando em compute não serverless (valor "False" na primeira coluna).

Relatório detalhando workloads em compute serverless e não serverless, por tipo de workload

Se aparecer um valor expressivo ao lado de "SQL" na segunda coluna, basta analisar quais clusters estão rodando em compute não serverless: adicione databricks/cluster_name na seção Group by para identificar quais precisam migrar para compute serverless.

Monitore e controle os gastos com o Databricks

Assim como acontece em outras integrações que lançamos (por exemplo, Datadog e OpenAI), se houver um pico de custo anômalo no Databricks, o Anomaly Detection identifica e avisa você, para agir antes que isso afete ainda mais a sua fatura e as suas operações.

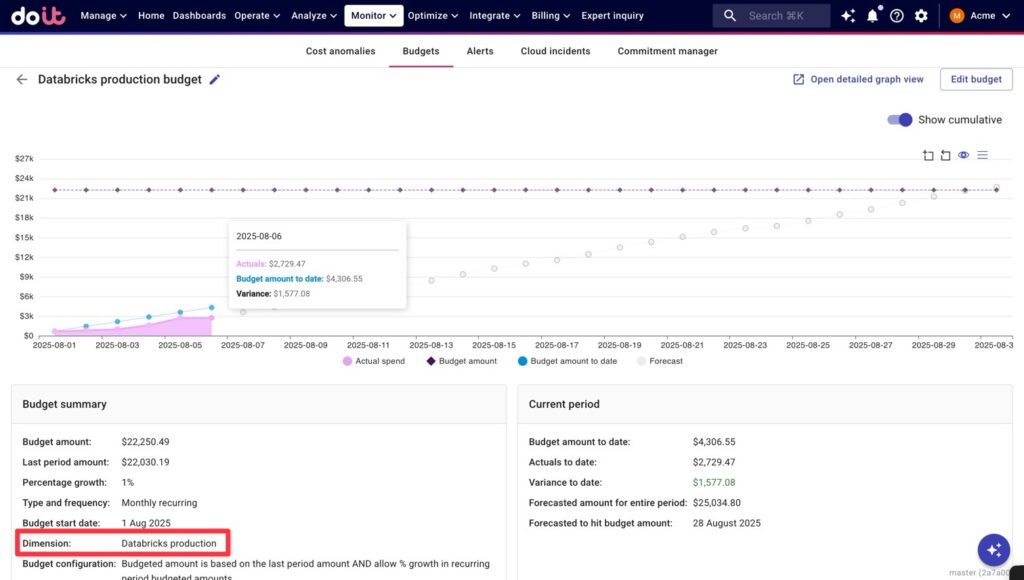

Você também pode criar Budgets usando Allocations que incorporam dados do Databricks.

Lembra das Allocations dos dois tipos de ambiente Databricks que montamos acima?

Abaixo, criamos um budget que monitora os gastos de produção do Databricks — definidos pela regra de Allocation "Databricks production" — frente a diferentes limites de gasto.

Budget no DoiT Cloud Intelligence monitorando os custos de produção do Databricks

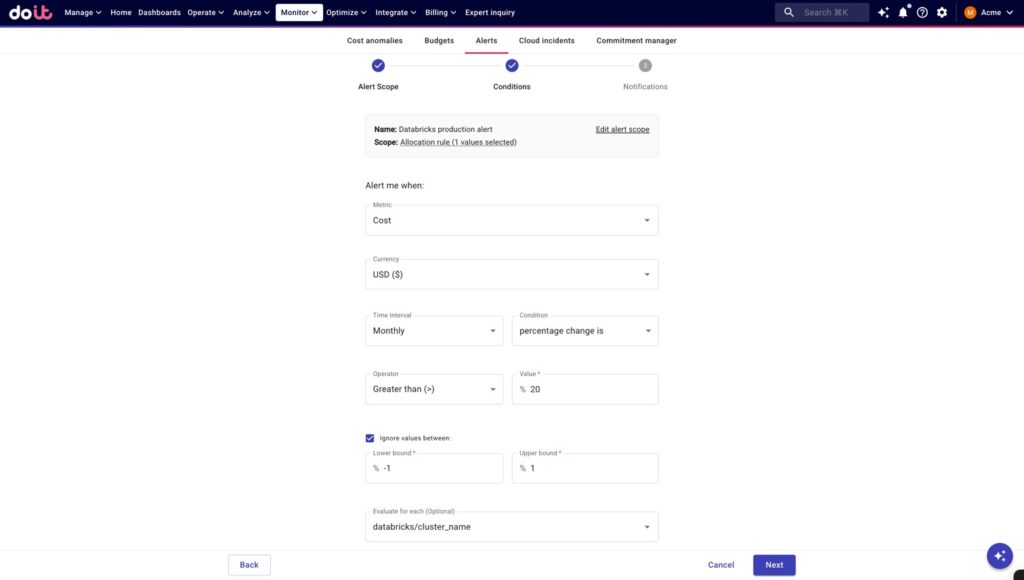

Outro ótimo caso de uso (e complemento aos Budgets) é configurar Alerts para monitorar o consumo do Databricks. Assim como antes, limitamos o escopo desse alerta à regra de Allocation "Databricks production".

Esse alerta nos avisa quando os custos sobem mais de 20% em relação ao mês anterior — mas, como incluímos a system label databricks/cluster_name no menu Evaluate for each, ele dispara sempre que o custo de qualquer cluster de produção aumenta mais de 20%.

Os Budgets ajudam a acompanhar os elementos de gasto em alto nível; já os Alerts permitem monitorar várias instâncias de uma mesma dimensão. Nesse caso, em vez de criar um Budget para cada cluster de produção, basta um único Alert.

Alerta que dispara quando o custo de qualquer cluster de produção sobe mais de 20% em relação ao mês anterior

Com seus gastos do Databricks lado a lado com a infraestrutura de nuvem, com outros custos de SaaS integrados (como o Datadog) e com quaisquer outros custos trazidos via DataHub, você tem uma visão de custos muito mais completa.

E, como suas métricas de unit economics são calculadas a partir das Allocations, incluir dados do Databricks nelas significa que o seu custo por cliente, custo por transação e demais métricas de negócio vão refletir o custo real e completo das suas operações.

Tudo pronto para começar? Se você usa Databricks, configure a integração hoje mesmo e ganhe muito mais visibilidade sobre os custos da sua plataforma de dados. Ainda não é cliente da DoiT? Fale com a gente para saber como o DoiT Cloud Intelligence pode ajudar você a extrair o máximo dos seus investimentos em nuvem — e não apenas a reduzir custos.

A integração com o Databricks está disponível para clientes elegíveis do DoiT Cloud Intelligence. Confira nossa página de preços para os detalhes atualizados de cada plano.

Para saber mais sobre a integração com o Databricks, consulte a documentação na Central de Ajuda da DoiT ou faça o tour passo a passo da configuração da integração com o Databricks.