La référence des équipes data qui exploitent Databricks à grande échelle

Connexion en quelques minutes

Un seul token. Une visibilité totale sur Databricks.

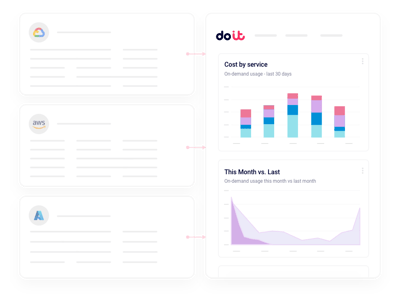

Connectez chaque workspace Databricks via un service principal ou un access token, puis pointez DoiT vers vos system tables. Nous ingérons automatiquement la consommation de DBU, l'exécution des jobs et les métadonnées des clusters, puis nous les rapprochons de votre facture cloud AWS ou Azure — sans exporters ni pipelines de warehouse à maintenir.

Ce que vous obtenez

Pensé pour la réalité d'une exploitation sur Databricks

Les besoins concrets que les responsables data et FinOps nous remontent dès qu'ils connectent leurs workspaces Databricks.

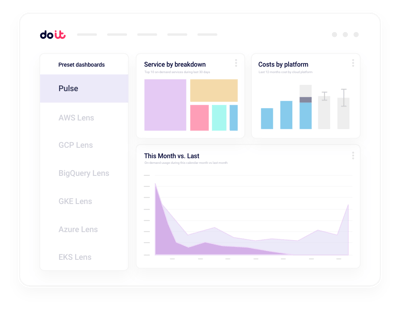

Reporting unifié des DBU et du cloud

Ventilez la dépense par workspace, cluster, job ou tag, et visualisez les DBU ainsi que le compute et le stockage sous-jacents dans un même rapport.

Anomalies en temps réel

Soyez alerté en quelques minutes — et non en quelques heures — sur les pics de DBU et les jobs hors de contrôle.

Right-sizing des clusters

Identifiez les clusters all-purpose et job surdimensionnés grâce à des recommandations concrètes d'instances et d'autoscaling.

Attribution par job et notebook

Imputez chaque DBU au job, au pipeline ou à l'utilisateur précis qui l'a déclenché.

TCO serverless face au compute classique

Comparez côte à côte serverless SQL, DLT et compute classique pour identifier où chaque workload a réellement sa place.

Gouvernance et budgets

Définissez des budgets DBU par équipe ou par workspace et détectez les dérives avant la finance.

Les system tables vous disent ce qui s'est exécuté. Cloud Intelligence™ vous aide à passer à l'action.

Au-delà des system tables Databricks

Consolidation multi-workspaces

Vues consolidées sur l'ensemble des workspaces et comptes Databricks, avec drilldown jusqu'à n'importe quel cluster ou job.

Alertes d'anomalies en temps réel

Détection par machine learning sur les dimensions workspace, cluster et job, avec routage vers Slack ou e-mail.

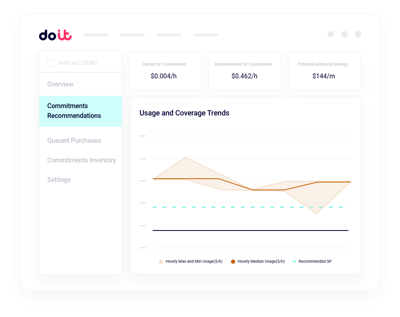

Planification des commitments DBU

Modélisez les paliers de commit Databricks et les Savings Plans cloud face à votre usage réel avant de signer un contrat.

Hygiène des tags et de l'allocation

Repérez les clusters non taggés, appliquez des règles d'allocation et répartissez les DBU partagés selon les attentes de la finance.

Allocation des coûts au niveau du job

Ventilez la dépense DBU par pipeline, notebook et utilisateur, sans avoir à construire votre propre lineage.

Forward Deployed Engineers

Des architectes cloud d'exception qui interviennent en extension de vos équipes pour mettre en œuvre les optimisations.

Les entreprises en forte croissance s'appuient sur DoiT Cloud Intelligence™

D'économies moyennes durant les 90 premiers jours

Délai moyen de mise en œuvre

“L'attention que DoiT porte à la fiabilité, combinée à la flexibilité de la plateforme, nous permet d'optimiser nos workloads Amazon EKS en toute sécurité, sans aucune intervention de nos Engineers.”

Oren Ashkenazy

Director of DevOps and Cloud chez Fiverr

Prêt à connecter vos workspaces Databricks ?

Réunissez DBU et dépense cloud sur une seule interface.

Frequently asked

questions

Comment obtenir une visibilité sur les coûts Databricks à travers plusieurs workspaces ?

Connectez chaque workspace une seule fois via un service principal. Cloud Intelligence™ ingère l'usage depuis les system tables Databricks et le rapproche de votre facture cloud, pour vous permettre de ventiler DBU, jobs et clusters par workspace, équipe ou tag depuis une vue unique.

Quelle est la meilleure façon d'intégrer les données de facturation Databricks à Cloud Intelligence™ ?

Accordez un accès en lecture seule à votre schéma system.billing et connectez votre compte AWS ou Azure sous-jacent. DoiT prend en charge l'ingestion, la normalisation et le reporting horaire. La plupart des équipes sont opérationnelles en moins d'une journée.

Puis-je voir quels jobs, notebooks ou utilisateurs génèrent l'essentiel de ma dépense DBU ?

Oui. Vous pouvez descendre du total d'un workspace jusqu'à l'exécution précise d'un job, d'un pipeline DLT, d'un SQL Warehouse ou d'un utilisateur. Filtrez par tags de cluster, par workspace ou par type de compute, sans écrire la moindre requête SQL sur les system tables.

Comment surveiller les anomalies de coûts Databricks en temps réel ?

La détection d'anomalies fonctionne en continu sur les dimensions workspace, cluster et job. Dès qu'un pic de consommation DBU se produit, vous recevez une alerte Slack ou e-mail avec la cause probable, avant que le dépassement n'apparaisse sur votre facture.

Qu'apporte cette solution comparée aux dashboards d'usage et aux system tables natifs de Databricks ?

Les system tables fournissent des données d'usage brutes. Cloud Intelligence™ les transforme en plateforme : reporting unifié des DBU et de l'infra cloud, right-sizing proactif, détection d'anomalies en temps réel, budgets et logique d'allocation auxquels la finance et l'engineering peuvent se fier.

Puis-je comparer les coûts du compute serverless et du compute classique ?

Oui. Les rapports détaillent côte à côte serverless SQL, DLT, model serving, ainsi que les clusters all-purpose et job classiques, coût des instances cloud sous-jacentes inclus — de quoi décider où placer chaque workload.

La solution fonctionne-t-elle avec Databricks sur AWS, Azure et GCP ?

Oui. Cloud Intelligence™ prend en charge Databricks sur les trois hyperscalers et corrèle l'usage des DBU avec la facture AWS, Azure ou Google Cloud correspondante, pour un véritable coût total de possession.

Mes données sont-elles sécurisées lorsque je connecte Databricks ?

Cloud Intelligence™ utilise des identifiants en lecture seule, avec des permissions de moindre privilège sur vos workspaces et system tables. Nous ne modifions jamais les jobs, les clusters ni les données, et la plateforme est certifiée SOC 2 Type II.