Teams, die Kubernetes in großem Maßstab betreiben, vertrauen auf uns

In wenigen Minuten angebunden

Ein schlanker Agent. Jeder Namespace abgedeckt.

Rollen Sie den DoiT-Collector mit einem einzigen Helm-Chart auf Ihren EKS-, GKE- oder AKS-Clustern aus. Wir verknüpfen die Auslastung auf Pod-Ebene mit Ihren Cloud-Abrechnungsdaten – so erscheinen Kosten nach Namespace, Label und Workload direkt neben Ihren übrigen Cloud-Ausgaben. Keine Custom-Exporter, keine weitergeleiteten Metriken.

Das ist drin

Gebaut für den Alltag mit Kubernetes

Genau die Funktionen, nach denen FinOps- und Plattform-Teams fragen, sobald sie ihre Cluster anbinden.

Allokation nach Namespace und Workload

Ordnen Sie Cluster-Kosten dem Namespace, Deployment oder Label zu, das sie tatsächlich verursacht hat. Ohne SQL, ohne Rebuilds.

Cluster-Anomalien

Sie werden alarmiert, sobald ein Namespace oder Workload unerwartet Ressourcen verbrennt.

Container-Right-Sizing

CPU- und Memory-Empfehlungen pro Workload – auf Basis realer Request- und Nutzungsmuster.

Idle-Pod-Erkennung

Spüren Sie Deployments und Jobs auf, die zwar provisioniert sind, aber nichts Sinnvolles leisten.

Einblick in Nodes und Autoscaler

Verstehen Sie die Effizienz Ihrer Node Pools, Bin-Packing-Verschwendung und wo Spot oder Autoscaling Ihre Rechnung senken können, ohne die Zuverlässigkeit zu gefährden.

Team-Chargeback und Budgets

Verteilen Sie geteilte Cluster-Kosten auf Teams und legen Sie Budgets pro Namespace fest – ohne der Label-Hygiene hinterherzulaufen.

Native Tools zeigen, was ein Pod verbraucht. Cloud Intelligence™ macht daraus konkrete Kostenmaßnahmen.

Mehr als kubectl top und Cloud-Rechnungen

Multi-Cluster-Rollups

Konsolidierte Sicht auf alle EKS-, GKE- und AKS-Cluster, mit Drilldown in jeden Namespace und Workload.

Workload-Anomalien in Echtzeit

Machine-Learning-Erkennung auf Namespace-, Workload- und Label-Ebene – direkt in Slack oder per E-Mail.

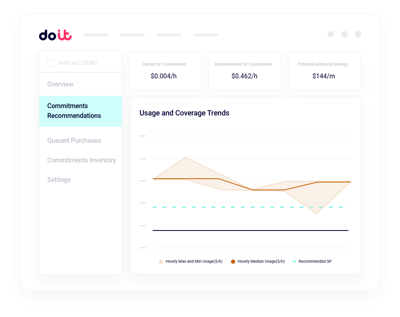

Right-Sizing und Kapazitätsplanung

Simulieren Sie Änderungen an CPU, Memory und Replicas anhand des realen Traffics, bevor Sie sie in Produktion bringen.

Saubere Labels und Allokation

Finden Sie Kosten ohne Label, setzen Sie Allokationsregeln durch und verteilen Sie Shared Services so, wie Finance es erwartet.

cloud-native Kostenzuordnung

Verknüpfen Sie Pod-Auslastung mit den dahinterliegenden EC2-, GCE- oder Azure-VM-Kosten – so steht hinter jedem Container ein echter Eurobetrag.

Forward Deployed Engineers

Erstklassige Cloud-Architekten, die als verlängerter Arm Ihres Teams arbeiten und Optimierungen direkt umsetzen.

Schnell wachsende Unternehmen setzen auf DoiT Cloud Intelligence™

Durchschnittliche Einsparung in den ersten 90 Tagen

Durchschnittliche Implementierungsdauer

“Der Fokus von DoiT auf Zuverlässigkeit in Kombination mit der Flexibilität des Systems erlaubt uns, unsere Amazon-EKS-Workloads sicher zu optimieren – ganz ohne Aufwand für unsere Engineers.”

Oren Ashkenazy

Director of DevOps and Cloud bei Fiverr

Bereit fürs Right-Sizing Ihrer Cluster?

Aus Auslastung auf Pod-Ebene werden Einsparungen auf Workload-Ebene.

Frequently asked

questions

Wie ordne ich Kubernetes-Kosten Namespaces und Teams zu?

Cloud Intelligence™ verknüpft die Auslastung auf Pod-Ebene mit Ihrer Cloud-Rechnung. So sehen Sie die exakten Kosten pro Namespace, Deployment, Label oder Team. Geteilte Cluster-Kosten (Control Plane, System-Pods, Idle-Kapazität) werden über Regeln verteilt, die Ihr Finance-Team auch wirklich vertreten kann.

Wie verbinde ich meine Kubernetes-Cluster mit Cloud Intelligence™?

Installieren Sie unser Helm-Chart in jedem Cluster. Der Collector streamt Pod-, Node- und PV-Auslastung an DoiT, wo sie mit Ihrer bestehenden Cloud-Billing-Integration zusammengeführt wird. Die meisten Teams sehen ihren ersten Report auf Namespace-Ebene noch am selben Tag.

Kann ich Pods right-sizen, ohne Workloads abzuschießen?

Ja. Empfehlungen basieren auf realen CPU- und Memory-Mustern über die Zeit, nicht auf einer einzelnen Momentaufnahme. Sie können Vorschläge pro Workload prüfen, zunächst in Non-Production testen und nur das ausrollen, was sicher ist.

Wie erkenne ich Kubernetes-Kostenanomalien, bevor die Rechnung kommt?

Die Anomalieerkennung läuft kontinuierlich auf Namespace-, Workload- und Label-Ebene. Verdoppelt ein Deployment plötzlich seinen Node-Verbrauch oder läuft ein Job aus dem Ruder, erhalten Sie eine Slack- oder E-Mail-Benachrichtigung mit der wahrscheinlichen Ursache.

Was unterscheidet das von kubectl top, Prometheus oder den eingebauten Cloud-Kostentools?

Diese Tools zeigen Auslastung oder Rohrechnungen, aber keine Kosten pro Workload. Cloud Intelligence™ verbindet Nutzung mit Preisen, Commitments und Regeln für geteilte Kosten – und liefert so eurogenaue Allokation, Right-Sizing und Governance an einem Ort.

Funktioniert das mit EKS, GKE und AKS?

Ja. Derselbe Collector und dieselben Reports funktionieren für managed Kubernetes auf AWS, Google Cloud und Azure ebenso wie für selbstverwaltete Cluster. Sie erhalten eine einheitliche Sicht – auch wenn Workloads über mehrere Clouds verteilt sind.

Kann ich Spot, Autoscaling und Commitments offensiver nutzen?

Cloud Intelligence™ zeigt, welche Workloads Spot-tauglich sind, wo Node Pools überdimensioniert sind und wie Savings Plans, CUDs oder Reservations auf Ihre Kubernetes-Nodes wirken. So committen und skalieren Sie mit voller Sicherheit.

Sind meine Cluster-Daten sicher?

Der Collector arbeitet mit Least-Privilege-RBAC und liest ausschließlich Metadaten und Nutzungsmetriken – niemals Ihre Anwendungsdaten. Die Plattform ist SOC 2 Type II zertifiziert, und wir nehmen keine Änderungen an Ihren Clustern vor, ohne dass Sie zustimmen.