Datenteams, die Databricks im großen Maßstab betreiben, vertrauen auf uns

In wenigen Minuten verbunden

Ein Token. Volle Transparenz über Databricks.

Verbinden Sie jeden Databricks-Workspace per Service Principal oder Access Token und richten Sie DoiT auf Ihre System Tables aus. Wir erfassen DBU-Verbrauch, Job-Runs und Cluster-Metadaten automatisch und führen sie mit Ihrer AWS- oder Azure-Cloud-Rechnung zusammen – ohne Exporter oder Warehouse-Pipelines, die Sie pflegen müssten.

Was Sie bekommen

Gemacht für die Realität des Databricks-Betriebs

Genau das, wonach Daten- und FinOps-Verantwortliche uns fragen, sobald sie ihre Databricks-Workspaces anbinden.

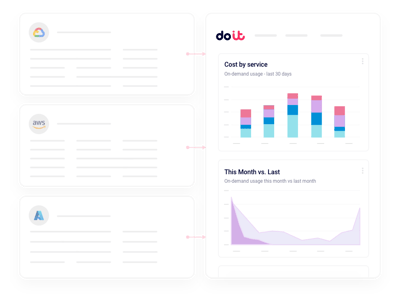

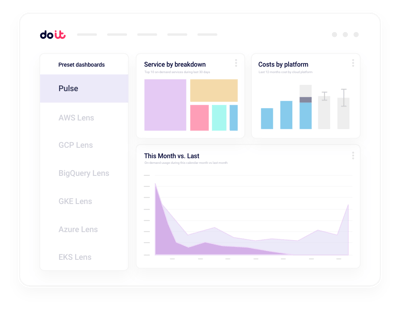

DBU- und Cloud-Reporting in einer Ansicht

Schlüsseln Sie Kosten nach Workspace, Cluster, Job oder Tag auf und sehen Sie DBUs zusammen mit der zugrunde liegenden Compute- und Storage-Nutzung in einem einzigen Bericht.

Anomalien in Echtzeit

Bei DBU-Spitzen und entgleisten Jobs werden Sie in Minuten alarmiert – nicht erst nach Stunden.

Cluster-Right-Sizing

Erkennen Sie überdimensionierte All Purpose- und Job-Cluster mit konkreten Empfehlungen zu Instanztypen und Autoscaling.

Zuordnung auf Job- und Notebook-Ebene

Ordnen Sie DBUs dem konkreten Job, der Pipeline oder dem User zu, der sie ausgelöst hat.

Serverless vs. Classic – die echten TCO

Vergleichen Sie Serverless SQL, DLT und Classic Compute direkt nebeneinander und erkennen Sie, wo welcher Workload wirklich hingehört.

Governance und Budgets

Setzen Sie DBU-Budgets pro Team oder Workspace und erkennen Sie Abweichungen, bevor das Finance-Team es tut.

System Tables zeigen, was gelaufen ist. Cloud Intelligence™ hilft Ihnen, daraus etwas zu machen.

Mehr als Databricks System Tables

Roll-ups über mehrere Workspaces

Konsolidierte Sicht über alle Databricks-Workspaces und -Accounts hinweg – mit Drilldown in jeden Cluster und jeden Job.

Anomalie-Alerts in Echtzeit

Machine-Learning-basierte Erkennung auf Workspace-, Cluster- und Job-Ebene, direkt nach Slack oder per E-Mail.

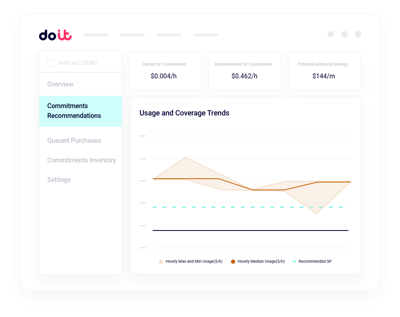

DBU-Commitment-Planung

Simulieren Sie Databricks-Commit-Stufen und Cloud Savings Plans gegen die tatsächliche Nutzung – bevor Sie unterschreiben.

Saubere Tags und Allokation

Finden Sie ungetaggte Cluster, setzen Sie Allokationsregeln durch und teilen Sie gemeinsam genutzte DBUs so auf, wie es das Finance-Team erwartet.

Kostenallokation auf Job-Ebene

Schlüsseln Sie DBU-Kosten nach Pipeline, Notebook und User auf – ganz ohne eigenes Lineage-System.

Forward Deployed Engineers

Erstklassige Cloud-Architekten, die als Erweiterung Ihres Teams arbeiten und Optimierungen direkt umsetzen.

Schnell wachsende Unternehmen setzen auf DoiT Cloud Intelligence™

Ø Einsparungen in den ersten 90 Tagen

Ø Implementierungszeit

“Die Verlässlichkeit von DoiT, kombiniert mit der Flexibilität des Systems, hilft uns, unsere Amazon EKS workloads sicher zu optimieren – ganz ohne Eingriffe unserer Engineers.”

Oren Ashkenazy

Director of DevOps and Cloud bei Fiverr

Bereit, Ihre Databricks-Workspaces anzubinden?

DBUs und Cloud-Kosten auf einer einzigen Oberfläche.

Frequently asked

questions

Wie bekomme ich Transparenz über Databricks-Kosten in mehreren Workspaces?

Verbinden Sie jeden Workspace einmalig per Service Principal. Cloud Intelligence™ liest die Nutzung aus den Databricks System Tables ein und führt sie mit Ihrer Cloud-Rechnung zusammen – so schlüsseln Sie DBUs, Jobs und Cluster nach Workspace, Team oder Tag in einer einzigen Ansicht auf.

Wie integriere ich Databricks-Abrechnungsdaten am besten in Cloud Intelligence™?

Geben Sie Lesezugriff auf Ihr system.billing-Schema frei und verbinden Sie Ihren AWS- oder Azure-Account. DoiT übernimmt Ingest, Normalisierung und stündliches Reporting. Die meisten Teams sind innerhalb eines Tages live.

Kann ich sehen, welche Jobs, Notebooks oder User den Großteil meiner DBU-Kosten verursachen?

Ja. Sie können von Workspace-Summen bis zu einem konkreten Job-Run, einer DLT-Pipeline, einem SQL Warehouse oder einem einzelnen User durchklicken. Filtern Sie nach Cluster-Tags, Workspace oder Compute-Typ – ohne SQL gegen System Tables zu schreiben.

Wie überwache ich Anomalien bei Databricks-Kosten in Echtzeit?

Die Anomalie-Erkennung läuft kontinuierlich über Workspaces, Cluster und Job-Dimensionen. Bei DBU-Spitzen erhalten Sie einen Slack- oder E-Mail-Alert mit der wahrscheinlichen Ursache – bevor die Überschreitung auf Ihrer Rechnung landet.

Wie verhält sich das zu den hauseigenen Usage-Dashboards und System Tables von Databricks?

System Tables liefern Rohdaten zur Nutzung. Cloud Intelligence™ macht daraus eine Plattform: einheitliches Reporting für DBUs und Cloud-Infrastruktur, proaktives Right-Sizing, Anomalie-Erkennung in Echtzeit, Budgets und eine Allokationslogik, der Finance und Engineering gleichermaßen vertrauen.

Kann ich Kosten von Serverless und Classic Compute vergleichen?

Ja. Reports stellen Serverless SQL, DLT, Model Serving sowie Classic All Purpose Compute und Job-Cluster direkt nebeneinander – inklusive der zugrunde liegenden Cloud-Instanzkosten. So entscheiden Sie fundiert, wo welcher Workload hingehört.

Funktioniert das mit Databricks auf AWS, Azure und GCP?

Ja. Cloud Intelligence™ unterstützt Databricks bei allen drei Hyperscalern und korreliert die DBU-Nutzung mit der jeweiligen AWS-, Azure- oder Google-Cloud-Rechnung – für eine belastbare Total Cost of Ownership.

Sind meine Daten sicher, wenn ich Databricks anbinde?

Cloud Intelligence™ nutzt ausschließlich Lesezugriffe mit minimalen Rechten auf Ihre Workspaces und System Tables. Wir verändern weder Jobs noch Cluster oder Daten, und die Plattform ist SOC 2 Type II zertifiziert.