生成AIの勢いが止まりません。動向を追っている方なら、その威力は十分にご存じでしょう。とはいえ正直なところ、AIワークフローの構築に取りかかると、まるで迷路に迷い込んだような気分になります。モデルの選定、各種連携、API対応、そしてインフラ管理——やるべきことは尽きません。

そこで登場したのが Amazon Bedrock Flow です。すでに Amazon Bedrock で基盤モデルを使っている方にとって、Flow はその一歩先へ踏み出すためのツール。AIワークフローをビジュアルに作成・管理・デプロイできるオーケストレーションツールであり、コードを一行も書く必要はありません。

具体的にどんなものなのか、なぜ Flow があなたのAIツールキットに足りなかったピースなのか、これから詳しく見ていきます。

Amazon Bedrock Flow とは?

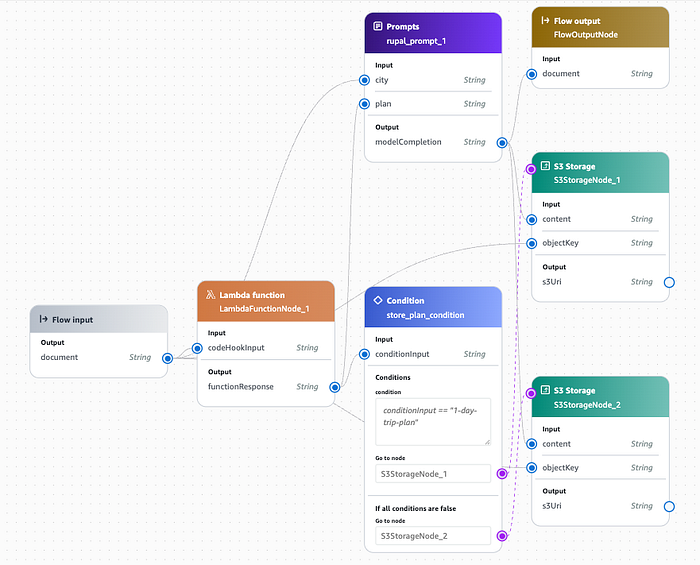

複数のAIモデル、ビジネスロジック、自動化したい一連のタスクが手元にあるとします。通常なら、これらをつなぎ合わせるためにまとまった量のコードを書く必要があります。ところが Bedrock Flow なら、ビジュアルエディタ上でコンポーネントをドラッグ&ドロップするだけ。AI版のレゴブロックを組み立てる感覚です。

ワークフローが完成したら、いよいよデプロイ。フローのバージョンを指すエイリアスを作成し、そのエイリアスに対して InvokeFlow リクエストを送ります。効率を追い求めるエンジニアの方も、AIのアイデアをすばやく検証したいプロダクトマネージャーの方も、これで作業が 格段にラク になります。

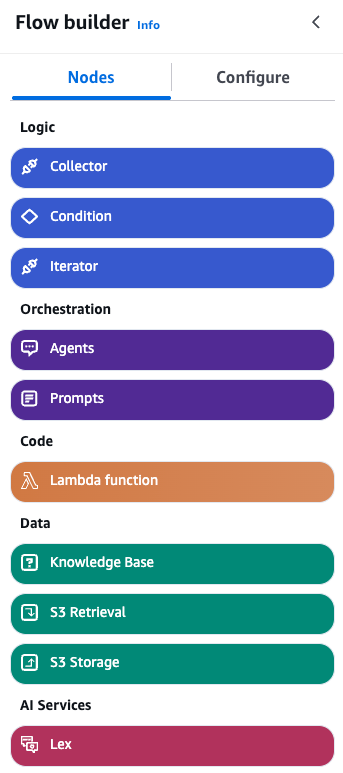

Bedrock Flow のノードを理解する

ノードは Bedrock Flow の構成要素です。AIワークフローの各ステップにあたり、それぞれが特定の役割を担います。主なノードの種類は次のとおりです。

🟣 オーケストレーションノード — Anthropic Claude、Amazon Nova、Mistral、Meta Llama、Stability AI などの基盤モデルを呼び出し、テキスト生成・要約・画像生成といったタスクを実行します。

🟢 データ処理ノード — Knowledge base や S3 と連携し、ワークフローの各ステップ間でデータを入出力します。

🔵 判定ノード — 条件に応じて出力を分岐させるロジックを追加します(例:チャットボットがユーザーの不満を検知したら、人間のオペレーターにエスカレーション)。

🟠 統合ノード — Lambda や Lex などの AWS サービスと連携し、機能を拡張します。

各ノードには設定項目があり、用途に合わせて細かく調整できます。

Bedrock Flow のバージョンを準備するには?

AIワークフローを改善しながら回していくなら、バージョン管理は欠かせません。Bedrock Flow では、フローの異なるバージョンを保存・管理・デプロイできます。改善を試しつつ、安定性も維持できる仕組みです。

バージョン管理の進め方は次のとおりです。

フローのバージョンを保存する — 大きな変更を加えるたびに、既存のものを上書きせず、新しいバージョンとして保存します。

IAMポリシーでアクセスを制御する — 意図しない変更を防ぐため、各バージョンを編集・デプロイできる人を制限します。

3. デプロイ前にテストする — 新しいバージョンを本番に投入する前に、別環境でテストケースを実行します。

4. 必要に応じてロールバック — 新バージョンに問題があれば、安定していた以前のバージョンにすぐ戻せます。

こうした運用により、チームでの共同作業がスムーズになり、安心してデプロイできます。

筆者のAWSアカウント上の Bedrock Flow

Bedrock Flow をデプロイするには?

AIワークフローが完成したら、デプロイは簡単です。手順は次のとおり。

ステップ1:ワークフローを確定する — フローのバージョンを作成します。

ステップ2:フローのエイリアスを作成する — エイリアスは、デプロイしたいフローのバージョンを指し示します。

ステップ3: そのエイリアスに対して InvokeFlow リクエストを送信します。

ステップ4: Flows Trace View でフローを監視・デバッグ・最適化します。

デプロイが完了すれば、AIワークフローは稼働開始、スケールも思いのまま! 🚀

なぜ Bedrock Flow に注目すべきか

AIは魅力的ですが、実装は一筋縄ではいきません。Bedrock Flow はその課題をどう解決するのか見ていきましょう。

ノーコードでAIをオーケストレーション — ドラッグ&ドロップでつなぐだけ。APIやサービスを手作業で配線する必要はありません。

Amazon Bedrock とシームレスに連携 — すでに Bedrock のモデルを使っていますか? Flow なら、そのままワークフローに組み込めます。

スケールも手間いらず — 数千件のリクエストを処理する必要があっても問題なし。インフラのスケーリングはAWSにお任せです。

Bedrock Flow が真価を発揮する場面

Bedrock Flow が大きな威力を発揮するユースケースをいくつかご紹介します。

カスタマーサポートの自動化 — FAQ対応に Amazon Titan、より自然な対話に Anthropic Claude を組み合わせたチャットボットを構築。

AIによるコンテンツ生成 — ユーザーのプロンプトから Stable Diffusion で画像を生成し、Meta Llama のテキストで仕上げる——そんなワークフローも簡単に実現できます。

不正検知 — 複数のAIモデルに取引データを通し、決済承認前に異常を検出します。

データ処理パイプライン — 生のドキュメントを、自動化された一連のフローで複数のAIモデルに通し、構造化されたインサイトに変換します。

AI駆動の自動化に取り組んでいるなら、Flow が複雑さを一手に引き受けてくれるので、成果に集中できます。

Bedrock Flow の制約(完璧なものはありません)

これだけ便利な Bedrock Flow にも、いくつか制約があります。

すべての基盤モデルに対応しているわけではない — 現時点で Flow は Bedrock の一部のモデルにしか対応していません。利用可否の確認が必要です。

カスタマイズの幅は限定的 — 高度にカスタマイズされたAIワークフローが必要な場合、Flow のビジュアルエディタは物足りなく感じるかもしれません。

AWSロックイン — AWSと深く統合されているため、マルチクラウドのAI戦略を目指すなら最適とは言いにくい面があります。

画像生成には非対応 — 利用できるのはLLMのみで、現時点では画像・動画生成には対応していません。

AIは強力ですが、AIワークフローの構築まで複雑にする必要はありません。Amazon Bedrock Flow はそのすべてをシンプルにします——コード不要、インフラの悩みもなし、残るのは成果だけ。チャットボットでも、AIコンテンツパイプラインでも、不正検知システムでも、Flow ならゴールに早く到達できます。

すでにAWSエコシステムを使っているなら、AI駆動の自動化をスケールさせる、これ以上なく手軽な方法です。ぜひ試して、感想を聞かせてください。LLM活用の第一歩を踏み出したい方は、こちらからお問い合わせください! 🚀

データの世界を、これからも楽しんでいきましょう。